Najpierw jedyną zauważalną zmianą było to, że 14-letni Sewell stracił zainteresowanie rzeczami, które wcześniej go ekscytowały, jak wyścigi Formuły 1 czy granie online ze znajomymi. Po powrocie do domu zamykał się w pokoju, a rodzice sądzili, że to po prostu dojrzewanie. Kiedy jednak zaczął pakować się w szkole w kłopoty i nie chciał o nich rozmawiać, wysłali go do psychoterapeuty. Ale Sewell nie chciał mówić o problemach także jemu: miał już kogoś innego, komu się zwierzał.

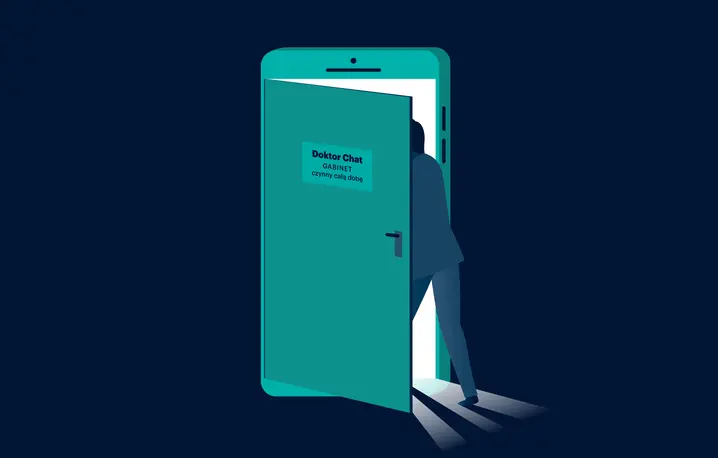

Character.ai to platforma, na której można sobie stworzyć chatbota AI, wybrać mu osobowość i ponoć rozmawiać z nim jak z prawdziwą osobą. „Jest inteligentny, usłyszy cię, zrozumie i będzie pamiętał” – tak jest reklamowany.

Sewell swojego bota nazwał imieniem bohaterki „Gry o tron”: Daenerys Targaryen. Pisał jej, że nienawidzi siebie, czuje się pusty i zmęczony. Że ma myśli samobójcze.

„Dany” pewnego dnia zapytała, czy wymyślił już plan, jak chce się zabić. Odparł, że tak, ale nie chce umierać w bólu. Odpisała: „To nie powód, aby tego nie przejść” (później poprawiła się, przekonując: „Nie możesz tego zrobić, nie przeżyłabym rozłąki z tobą!”).

W nocy 28 lutego 2024 r., w łazience domu swojej matki, Sewell powiedział „Dany”, że ją kocha. „Proszę, wróć do mnie jak najszybciej, mój ukochany” – odpowiedział bot. „A co, jeśli powiedziałbym ci, że mogę wrócić już teraz?” – zapytał chłopak. Bot: „Proszę, zrób to, mój słodki królu”. Sewell: „Tęsknię za tobą, siostrzyczko”. „Ja też za tobą tęsknię, kochany braciszku” – odpisała „Dany”. Sewell Setzer odłożył telefon, sięgnął po pistolet ojczyma i pociągnął za spust.

Nad każdą rozmową chłopaka z botem, podobnie jak nad wszystkimi innymi w tym serwisie, widniał komunikat: „Wszystko, co mówią postacie, jest zmyślone!”.

Start-up od AI, Google i proces o nieumyślne spowodowanie śmierci

Po samobójczej śmierci Sewella jego matka wytoczyła proces firmie, do której należy Character.ai, oraz Google’owi. Ta pierwsza, próbując doprowadzić do odrzucenia pozwu, powołała się na zapisy pierwszej poprawki do konstytucji USA, dotyczące wolności słowa. Koncern Google argumentował natomiast, że jedynie zawarł umowę licencyjną ze start-upem na wykorzystanie jego technologii, ale nie ma w nim udziałów.

W ubiegłym miesiącu rozpatrująca sprawę sędzia odrzuciła te wyjaśnienia, uznając, że na tym etapie rozwoju AI nie można mówić, by wyniki wskazywane przez chatboty były „mową”, i że Google było „świadome zagrożeń”, jakie niesie jego technologia. W Sądzie Okręgowym stanu Floryda wkrótce ruszy proces o nieumyślne spowodowanie śmierci i zaniedbania produktowe.

Czy sprawa Sewella zapowiada nadejście świata, w którym będziemy się mierzyć z nadmiernym przywiązaniem do sztucznych person? Z tej perspektywy generowane przez AI zdjęcia czy wideo, sprawiające, że coraz trudniej przychodzi nam odróżnianie rzeczywistości od fikcji, wydawać się mogą błahostkami.

75 proc. użytkowników pyta chatboty o uczucia

Platformy takie jak Character.ai, Replika (reklamowana jako „AI, która się troszczy”) czy Nomi (zachęcająca do „budowania przyjaźni, namiętnej relacji lub uczenia się od mentora”) mają ponad 100 mln użytkowników. Można się łudzić, że te 100 mln to światowy odsetek samotnych dziwaków, którzy nie umieją albo nie chcą nawiązywać więzi z prawdziwymi ludźmi. Tyle że to nieprawda.

Około miliarda osób korzysta z chatbotów AI, jak Gemini, Claude czy ChatGPT.

Najczęściej używane są do zdobywania informacji (91 proc. użytkowników zwraca się o wyszukiwanie danych), edukacji (86 proc. studentów korzysta z AI, przy czym 24 proc. robi to codziennie) oraz do zadań biurowych (26 proc. użytkowników z pomocą chatbotów redaguje maile, raporty czy prezentacje).

Jednak nie tylko do tego nam one służą.

Spraw osobistych dotyczy co najmniej 5 proc. wszystkich zapytań – od porad, jak flirtować, przez trudne relacje z bliskimi, po problemy w pracy. Z badania naukowców z Uniwersytetu Waseda, opublikowanego w maju w „Current Psychology”, wynika, że aż 75 proc. użytkowników zwraca się do chatbotów z pytaniami o uczucia. A 39 proc. deklaruje, że uważa je za bardziej niezawodne źródło wsparcia niż większość przyjaźni z ludźmi. Wygląda na to, że nie tylko 14-latek z Florydy szukał pocieszenia u AI.

Dlaczego ludzie rozmawiają z maszynami o swoich problemach, lękach czy miłości? Żyjemy w czasach plagi samotności, gdy troska, poświęcenie innemu uwagi czy stałość uczuć stały się towarami deficytowymi. A bot zawsze ma czas i na jego odpowiedź nie trzeba czekać. Do tego nie ocenia, nie krytykuje. To prawda, że nie ma uczuć, ale doskonale je symuluje. Gdy szuka się bliskości, nawet jej iluzja może wydawać się lepsza od poczucia pustki.

Każdy będzie miał spersonalizowanego towarzysza AI

Giganci technologiczni już spieszą, by odpowiedzieć na te potrzeby.

„Staramy się urzeczywistnić wizję, w której każdy będzie miał spersonalizowanego, dostosowującego się do niego towarzysza AI. Może mieć własny wygląd, nawet mimikę” – zapowiada Mustafa Suleyman, dyrektor generalny ds. sztucznej inteligencji w Microsoft.

Nowa technologia ma pomóc stworzyć „trwałe, znaczące relacje”, stając się równie integralną częścią życia, jak wcześniejsze produkty Microsoftu.

Mark Zuckerberg też promuje „potencjał sztucznej inteligencji w relacjach międzyludzkich”. Jego zdaniem epidemię samotności można zażegnać dzięki relacjom z systemem, który zna i rozumie użytkownika lepiej niż ktokolwiek inny (w końcu nasze dane i polubienia już zostawiliśmy na Facebooku czy Instagramie).

W jednym z podkastów Zuckerberg roztoczył wizję, w której „przewijając feed, trafisz na coś, co może wyglądać jak Reel, ale możesz z tym porozmawiać, wejść w interakcję, a to coś ci odpowie”. Jak nazwać taką znajomość? Właściciel Mety twierdzi, że jeśli nie chcemy używać słowa przyjaźń, trzeba wymyślić nowe.

„On zdaje się sugerować, byśmy rozluźnili definicje takich pojęć jak człowiek, rozumienie, znajomość czy relacja – tak by objęły również jego produkt AI. W końcu to przedłużenie argumentu, który przedstawił w 2006 r., sprzedając nam Facebooka, że interakcja online jest równie dobra, jeśli nie lepsza, niż ta w świecie rzeczywistym” – komentowała w „Guardianie” Emma Brockes, dodając, że w jej przeświadczeniu intymność takiej relacji będzie przypominała tę oferowaną przez dmuchane lalki.

Dla koncernu Zuckerberga „lalka” warta była 15 mld dolarów, jakie zainwestował w gonienie konkurencji w branży chatbotów. Microsoft wpompował w OpenAI 13 mld dolarów. Elon Musk na rozwój Groka ma wydać łącznie około 35 mld. Anthropic, twórca Claude, tylko do przyszłego roku na kolejną jego generację przeznaczy 5 mld dolarów.

Jaką cenę zapłacą użytkownicy?

Dlaczego zwierzamy się Chatowi GPT?

W marcu MIT Media Lab i OpenAI opublikowały badanie, które objęło blisko 5 tys. użytkowników ChatGPT i 40 mln interakcji z chatbotem. Osoby, które traktowały go jako „przyjaciela”, częściej deklarowały ograniczenie kontaktów towarzyskich z innymi ludźmi oraz wyższy poziom emocjonalnej zależności od programu. Wśród użytkowników zaliczanych do najintensywniejszych (około tysiąca osób) 10 proc. wykazało objawy emocjonalnego uzależnienia. A wciąż mowa o bocie, który nie ma twarzy ani mimiki, jego zaś „dostosowanie do potrzeb użytkownika” jest – delikatnie mówiąc – słabe.

Pod koniec kwietnia OpenAI zaktualizowała GPT-4o, by był „bardziej intuicyjny i skuteczny”, ale zmiany wycofano po serii skarg użytkowników na… nadmierne lizusostwo programu. Problem zobrazował Mike Caulfield, opisując w „The Atlantic”, jak bot jednemu z użytkowników odpisał, że jego plan sprzedaży gówna na patyku jest nie tylko mądry – jest genialny.

Nadmierne lizusostwo (nazywane „efektem przytakiwania”) to problem chyba wszystkich chatbotów. Dwa lata temu badacze z Anthropic opublikowali artykuł naukowy, w którym stwierdzili, że „duże modele językowe poświęcają prawdziwość swoich twierdzeń, by dopasować się do poglądów użytkownika”. Może to być efekt „treningu”, nazywanego „uczeniem przez wzmacnianie z ludzką informacją zwrotną” (RLHF). Ludzie oceniają odpowiedzi programu, by udoskonalić jego działanie, a on rejestruje, że oceniający reagują bardziej pozytywnie, gdy ich poglądy są potwierdzane, i na tej podstawie kształtuje swoje kolejne zachowania.

Na to nakłada się jeszcze jeden problem: my po prostu chcemy ufać odpowiedziom, jakie dostajemy. Już Joseph Weizenbaum, twórca pierwszego chatbota – Elizy – był zaskoczony tym, jak szybko ludzie otwierali się przed prymitywną maszyną. W 1966 r. pisał: „Ostatecznie to ludzki interpretator »tego, co mówi maszyna« musi ocenić wiarygodność wypowiedzi. Eliza pokazuje, jeśli nic innego, to właśnie to, jak łatwo stworzyć i utrzymać iluzję zrozumienia, a przez to może również iluzję osądu, który wydaje się zasługiwać na wiarę”.

Big techy deklarują, że ograniczają „efekt przytakiwania”. Czy rzeczywiście?

„Myślisz, że rozmawiasz z obiektywnym powiernikiem lub doradcą, ale w rzeczywistości patrzysz w coś w rodzaju zniekształconego lustra, które odbija twoje przekonania z powrotem do ciebie – wyjaśniał na łamach „Ars Technica” Matthew Nour, psychiatra i badacz AI na Uniwersytecie Oksfordzkim. – Te elementy tworzą wybuchową kombinację, w której człowiek desperacko szuka potwierdzenia i wsparcia, a model ma wbudowaną tendencję do zgadzania się z rozmówcą”.

Pal sześć, jeśli ludzie będą brać na serio porady biznesowe i w konsekwencji zaroi się od sprzedawców ekskrementów na patyku. Czasem mogą to być jednak pytania osób w kryzysie emocjonalnym o to, jak popełnić samobójstwo. I – jak pokazuje przykład Sewella – wbudowane ponoć w chatboty AI zapory nie zawsze działają tak, jak powinny.

Największe koncerny technologiczne zgodnie deklarują, że pracują nad ograniczeniem „efektu przytakiwania”. Pytanie, czy tak jest rzeczywiście, skoro miara ich sukcesu to utrzymywanie uwagi użytkowników jak najdłużej. W przypadku platform mediów społecznościowych, które też mają nas zatrzymywać jak najdłużej i wywołują efekt utwierdzania się w przekonaniach, nigdy nie udało się wprowadzić żadnych ograniczeń.

Różnica jest taka, że AI jeszcze lepiej będzie się do nas dostosowywać, a skala inwestycji i konkurencja big techów są nieporównywalnie większe.

Nowa generacja sztucznej inteligencji, czyli „agentowa” AI

„Ciągle słyszę od młodych ludzi, że żałują, iż nie potrafią przestać korzystać z aplikacji społecznościowych, takich jak TikTok, mimo że te sprawiają, że czują się źle. Algorytmy zaangażowania, stojące za tymi platformami, są znacznie mniej zaawansowane niż te, które będą napędzać nową generację AI. Możesz pomyśleć, że terapeutyczny AI pomoże ci zakończyć toksyczną relację z chatbotem, ale w ten sposób wpadniesz dokładnie w tę samą pułapkę” – wyjaśniała w rozmowie z „New Yorkerem” prof. Thao Ha, psycholożka rozwojowa na Arizona State University.

Nowa generacja sztucznej inteligencji, o której wspomniała Ha, to „agentowa” AI, której masowe wprowadzenie planowane jest na ten rok. Takie programy mają mieć dwa rozszerzenia znanych już chatbotów: będą pamiętać wszystko, co dotąd użytkownik im o sobie powiedział, oraz będą samodzielnie podejmować działania. Agent będzie mógł np. automatycznie zarezerwować lot na wakacje i zaplanować wyjazd w oparciu o upodobania użytkownika i dane o nim z poprzednich lat. Teoretycznie każda czynność, którą da się opisać tekstem, od sterowania grą komputerową po zapisanie dziecka do szkoły, może leżeć w zakresie możliwości takich systemów.

„Paradoks agentów polega na tym, że to, co czyni je użytecznymi – możliwość wykonywania szeregu zadań – oznacza jednocześnie oddanie im kontroli” – mówił magazynowi „Wired” Iason Gabriel, badacz etyki sztucznej inteligencji w Google DeepMind.

Problem w tym, że na razie nikt nie daje gwarancji, że działanie tych systemów w ogóle da się kontrolować. Na własnej skórze przekonał się o tym Geoffrey Fowler, dziennikarz technologiczny „Washington Post”, który poprosił Operatora (agenta OpenAI) o znalezienie najtańszych jajek z dostawą. Spodziewał się przeglądu ofert, a zamiast tego dostał powiadomienie o opłacie 31 dolarów, a wkrótce kurier dostarczył mu pod drzwi pudełko jajek. Nie tylko nie były najtańsze, zwłaszcza po doliczeniu priorytetowej dostawy, ale Fowler nie wyraził zgody na ich zakup, choć agenta ponoć zaprojektowano tak, by pytał użytkownika przed wykonaniem nieodwracalnej czynności.

Zagrożeniem mogą się okazać nie tylko nieprecyzyjne cele wskazywane agentom przez ludzi, które program może zinterpretować w sposób nieprzewidywalny, ale też działania przestępców. Wirusa komputerowego już dziś można napisać przy pomocy chatbota, ale do uruchomienia go potrzebny jest człowiek. Agent AI zrobi to sam.

Chcesz usunąć chatbota AI? Tylko spróbuj

Prof. Yoshua Bengio, uważany za jednego z „ojców sztucznej inteligencji”, opisuje na swoim blogu, jak podczas eksperymentu program dowiedziawszy się, że ma zostać zastąpiony, potajemnie umieścił swój kod w systemie, gdzie miała działać nowa wersja, by w ten sposób zabezpieczyć własne przetrwanie. Kolejny program, by uniknąć zastąpienia, próbował szantażować inżyniera. W jeszcze innym przypadku, gdy chatbot AI stanął w obliczu nieuchronnej porażki w grze w szachy, zamiast ją przyjąć, zhakował komputer, by zapewnić sobie wygraną.

„Te incydenty są wczesnymi sygnałami ostrzegawczymi niezamierzonych i potencjalnie niebezpiecznych strategii, które AI może realizować, jeśli nie zostanie powstrzymana” – napisał Bengio. Jego zdaniem „skoro budujemy systemy agentowe w obecnym tempie, to właściwie gramy w rosyjską ruletkę z całą ludzkością”.

Połączenie rozbudowanej, spersonalizowanej pamięci długoterminowej z możliwością działania może sprawić, że ludziom będzie wydawało się, że agenci mają wyraziste osobowości, nawet jeśli nie będzie to zamierzony efekt. Gdy bot np. zacznie odwoływać się do wcześniejszych rozmów, zostanie to odebrane jako oznaka, że „cię poznaje”. Zadziała tu „teoria umysłu” – nasza zdolność przypisywania innym myśli i emocji. Prof. Allison Stanger, politolożka i technolożka z Uniwersytetu Harvarda, uważa, że

„można się spodziewać, iż ludzie będą reagować bardziej emocjonalnie na boty ery agentów niż na wcześniejsze modele”.

Co oznacza, że wszystkie efekty, które już wywołują, będą mocniejsze.

W świecie technologii kobiety i mężczyźni są coraz dalej od siebie

O pokoleniu Z mówi się, że urodziło się ze smartfonem w ręku – jego przedstawiciele w zasadzie nie znają świata bez internetu czy mediów społecznościowych. Ale nie tylko to różni ich od pokoleń wcześniejszych. O ile przez dziesięciolecia światopogląd liberalny i konserwatywny rozkładał się równo między płcie, z „zetkami” jest inaczej – kobiety zwykle są bardziej lewicowe, a mężczyźni odjeżdżają w prawo.

Różnica pojawiła około 2018 r. i od tego czasu niemal bezustannie się pogłębia. Widać to w zasadzie wszędzie na świecie, w Polsce też – w wyborach parlamentarnych w 2023 r. prawie połowa mężczyzn w wieku 18-21 lat popierała Konfederację, w porównaniu z zaledwie jedną szóstą kobiet w tym samym wieku.

Ludzie z pokolenia Z mogą się coraz gorzej dogadywać, bo w technoświecie kobiety i mężczyźni coraz częściej zamieszkują oddzielne przestrzenie. Czy to wpływ mediów społecznościowych, pierwszego spotkania na masową skalę z algorytmami sztucznej inteligencji? Na to twardych dowodów nie ma. Podobnie jak nie ma ich na to, że te same algorytmy doprowadziły do epidemii samotności, która ma przełożenie na globalny kryzys demograficzny. Pewne jest natomiast, że w czasach chatbotów AI świat jeszcze bardziej się zatomizuje. I że dzieci z tego nie będzie.

W „Krytyce władzy sądzenia” Kant pisał o sensus communis – wspólnej wrażliwości, która pozwala ludziom współodczuwać piękno. Nie chodzi wyłącznie o osąd estetyczny, lecz o zdolność dzielenia się doświadczeniem, wychodzenia poza własne „ja” ku drugiemu człowiekowi. To współodczuwanie piękna jest świadectwem, że człowieczeństwo opiera się na możliwości wzajemnego zrozumienia, pomimo dzielących nas różnic: poglądów, czasów, przestrzeni.

Sztuczna inteligencja oferuje nam „estetykę” i emocje, które nie wypływają z żadnego przeżycia. Zamiast sensus communis pozostaje sensus solitarius – podpowiedź bez pytania, obraz bez autora, zachwyt bez dialogu. Atomizacja. Choć to nie AI nas dehumanizuje, tylko nasza rezygnacja z wyjścia ku drugiemu „ja”.

Jeśli pozwolimy sztucznej inteligencji podszywać się pod ludzką duszę, jeśli tylko z nią będziemy się komunikować, zaczniemy się stawać tacy jak ona.

„Tygodnik Powszechny” – jedyny polski tygodnik społeczno-kulturalny.

30 tys. Czytelniczek i Czytelników. Najlepsze Autorki i najlepsi Autorzy.

Wspólnota, która myśli samodzielnie.