Twierdzenie, że jakaś firma zbudowała taki model sztucznej inteligencji, który byłby w stanie włamać się w zasadzie do każdego systemu komputerowego na świecie, można by uznać za tani chwyt marketingowy. Można by włożyć go między bajki. Można, gdyby tą firmą nie był Anthropic.

Oraz gdyby wiadomość nie postawiła na nogi najważniejszych koncernów zajmujących się cyberbezpieczeństwem. A także Białego Domu, z którym Anthropic jest w ostrym sporze.

Czym jest Mythos i jakie luki wykrył ten model od Anthropic

Zacznijmy od możliwości modelu nazwanego Mythos, wokół którego zrobiło się tak nerwowo. W opublikowanym 7 kwietnia raporcie technicznym Anthropic stwierdza, że osiągnął on taki poziom kodowania, który pozwala mu wyszukiwać (i wykorzystywać) luki w innych oprogramowaniach w stopniu wcześniej niespotykanym. Anthropic oznajmił, że w ciągu ostatniego miesiąca Mythos znalazł „tysiące podatności, w tym w każdym głównym systemie operacyjnym i przeglądarce”.

Oznacza to ni mniej, ni więcej, że nawet ktoś, kto nie zna się na programowaniu, mógłby – używając modelu Mythos – włamać się w zasadzie prawie wszędzie.

Brzmi nieprawdopodobnie. Ale Anthropic podaje konkrety. Jego program miał znaleźć krytyczne błędy w systemie Linux, używanym przez większość serwerów na świecie. Miał wykryć lukę w OpenBSD, oprogramowaniu stosowanym w systemach wymagających wysokiego poziomu bezpieczeństwa, jak infrastruktura sieciowa, firewalle i systemy krytyczne. Luka ta miała istnieć, niezauważona, przez 27 lat.

Z kolei w oprogramowaniu FFmpeg (to zestaw narzędzi pozwalający odtwarzać, przetwarzać i przesyłać wideo i audio) Mythos miał zidentyfikować liczącą 16 lat podatność, której nie udało się wykryć wcześniej mimo pięciu milionów automatycznych testów. Miał wskazać też luki w jednej ze starszych wersji programu Mozilla Firefox, które mogłyby otwierać drogę do przejęcia kontroli nad systemami użytkowników.

Firma zastrzega, że nie ujawnia wszystkich wykrytych podatności, bo „ponad 99 procent znalezionych luk w zabezpieczeniach nie zostało jeszcze załatanych”.

Dlaczego Mythos budzi tyle wątpliwości

Jak doszło do tego, że Anthropic stworzył superhakera AI? Mówiąc najkrócej: przez przypadek. Był to efekt uboczny skalowania i ulepszania nowego modelu Claude. Bruce Schneier, kryptograf i wykładowca Harvard Kennedy School, zwraca uwagę, że AI już dziś jest „nadludzko dobra w znajdowaniu, wykorzystywaniu i łataniu podatności”, a Mythos nie wprowadza jakościowo nowej zdolności, tylko rozwija istniejące.

Takie programy już od jakiegoś czasu coraz lepiej radzą sobie z identyfikowaniem i tworzeniem tzw. łańcuchów exploitów, czyli zestawów podatności i narzędzi do sekwencyjnego wykorzystywania błędów w systemie. Przypomina to hakowanie w stylu maszyn Rube’a Goldberga: wykorzystywanie wielu drobnych błędów jeden po drugim, co – bez alarmowania administratora – może prowadzić do przejęcia systemu.

Oczywiście natychmiast pojawiła się lawina komentarzy, że informacje od Anthropic to sprytny zabieg marketingowy przed możliwym wejściem firmy na giełdę pod koniec tego roku.

Co więcej, już w raporcie technicznym zaznaczono, że Mythos zostanie udostępniony tylko „ograniczonej grupie kluczowych partnerów branżowych” w ramach projektu nazwanego Glasswing, aby – jak napisano – „umożliwić zabezpieczenie najważniejszych systemów, zanim modele o podobnych możliwościach staną się powszechnie dostępne”.

Sprawa wydawała się śmierdząca, bo firma OpenAI wykonała podobny manewr. W 2019 r. ogłosiła, że nie będzie szeroko udostępniać modelu GPT-2, bo może zostać wykorzystany do masowej dezinformacji. To tylko nakręciło ciekawość dotyczącą możliwości programu, a kilka miesięcy później pojawił się GPT-3, ale już w płatnej wersji dla programistów.

Anthropic: firma od bezpieczeństwa czy gracz w wyścigu AI

W spekulacjach, że w przypadku Mythosa jest to (także) akcja marketingowa, nie pasowało początkowo tylko jedno. To, że stoi za tym Anthropic.

Firmę stworzyli w 2021 r. naukowcy i menedżerowie, na czele z rodzeństwem Dario i Danielą Amodei, którzy odeszli z OpenAI. Zarzucali jej prezesowi, Samowi Altmanowi, że zbyt szybko komercjalizuje rozwój sztucznej inteligencji kosztem bezpieczeństwa i długofalowych ryzyk.

Od początku budowali tożsamość Anthropic wokół zasad etycznych i ostrożności. Zamiast, jak reszta amerykańskiej Doliny Krzemowej, stawiać na słynne move fast and break things (działaj szybko i psuj rzeczy), hołdowali raczej zasadzie: działaj ostrożnie i zastanawiaj się, co możesz zepsuć.

Chwila próby, czy Anthropic trzyma się deklarowanych zasad, nadeszła na początku tego roku, gdy firma weszła w otwarty spór z rządem USA. Wcześniej, w 2025 r., Anthropic zdobył wart 200 mln dolarów kontrakt z Pentagonem – dzięki temu, że jako jedyna spośród tego typu firm zajmujących się AI miała certyfikaty na obsługę danych objętych klauzulą tajności.

Na początku tego roku Departament Obrony (przez Donalda Trumpa przemianowany na Departament Wojny; Kongres nie zatwierdził dotąd tej zmiany, trzymajmy się więc starej) zażądał pełnego dostępu do jej modeli, aby móc samemu je modyfikować.

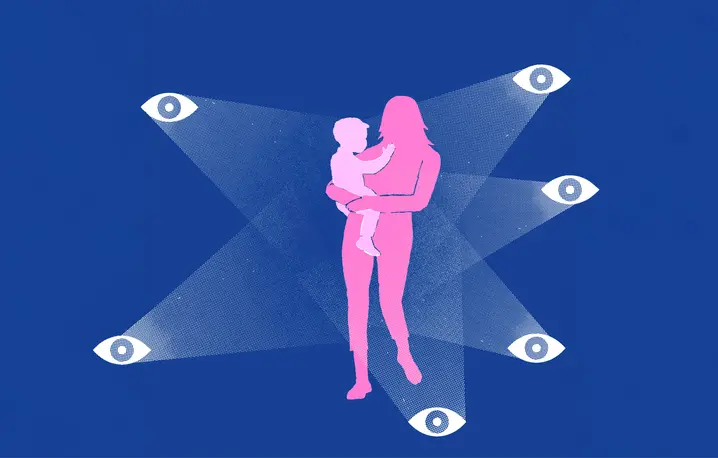

Spór z Pentagonem. Anthropic stawia wojsku warunki

Firma zgodziła się, ale pod dwoma warunkami: że jej modele nie będą użyte w broni autonomicznej (tj. takiej, która sama decyduje, czy zabić; to np. autonomiczny dron), a także że nie posłużą do masowej inwigilacji obywateli USA. Z doniesień amerykańskich mediów wynika, że już wtedy systemy Anthropic były wykorzystywane do wyboru celów przed wojną w Iranie, a wcześniej prawdopodobnie także podczas operacji w Wenezueli.

Po kilku dniach ostrej publicznej awantury i żądań, żeby Anthropic wycofał się ze stawianych warunków, sekretarz obrony Pete Hegseth uznał firmę za „zagrożenie dla łańcucha dostaw” (zwykle na takiej liście lądują chińskie firmy podejrzane o szpiegostwo). W praktyce oznacza to zerwanie przez Pentagon wszystkich kontraktów i zakaz zawierania nowych. Dzień po ogłoszeniu decyzji Hegsetha, Anthropic został zastąpiony przez OpenAI.

Warto jednak odnotować, że Anthropic kryształowy nie jest, czego dowodzą sądowe dokumenty, które wypłynęły w tym roku. Wynika z nich, że firma kupiła od pół miliona do dwóch milionów używanych książek, aby je zeskanować, zdigitalizować i wykorzystać do trenowania swoich modeli AI. Praw autorskich do treści nie miała (ale przynajmniej papier trafił do recyklingu).

Biały Dom i Wall Street reagują na zagrożenie cyberatakami AI

Narrację o marketingowym blefie w sprawie Mythosa burzy także to, że Anthropic przed publikacją swojego raportu poinformował o zagrożeniu całą wierchuszkę w amerykańskim rządzie. A Biały Dom sprawę potraktował śmiertelnie poważnie.

Telewizja CNBC poinformowała, że 1 kwietnia wiceprezydent J.D. Vance i sekretarz skarbu Scott Bessent zorganizowali telekonferencję, na którą wezwano Daria Amodei, Sundara Pichai z firmy Google, Satyę Nadellę z Microsoftu, Elona Muska i Sama Altmana oraz przedstawicieli CrowdStrike i Palo Alto Networks, globalnych firm zajmujących się cyberbezpieczeństwem.

Szczegóły tych rozmów nie są znane. Wiadomo, że na nich się nie skończyło. Agencja Bloomberg podała, że Bessent i Jerome Powell, prezes Rezerwy Federalnej (banku centralnego), zwołali pilne spotkanie z liderami Wall Street, by rozmawiać o „erze zwiększonego ryzyka cybernetycznego”, którą miał właśnie zapoczątkować Mythos.

W ostatnich dniach ostrzeżenia wydali także Brytyjczycy. Tamtejszy rządowy Instytut Bezpieczeństwa Sztucznej Inteligencji stwierdził, że Mythos stanowi „krok naprzód względem wcześniejszych modeli z najwyższej półki” i jest niewątpliwie najlepszy z dotąd przetestowanych. Instytut zastrzegł jednak, że „nie jest w stanie stwierdzić z całą pewnością”, czy Mythos byłby w stanie zaatakować dobrze chronione systemy, i że potrzebne są tu dalsze testy.

Czy Mythos naprawdę zmienia zasady gry w cyberbezpieczeństwie

O tym, że Anthropic nie sieje fermentu dla zarabiania, lecz że chodzi mu o realne zagrożenie, może świadczyć także to, że od razu informował, iż zapraszając „ograniczoną grupę kluczowych partnerów branżowych” do wspomnianego projektu Glasswing – łącznie ponoć ok. 40 podmiotów, w tym Nvidia, Google, Amazon Web Services, Apple i Microsoft – zamierza zapewnić im kredyty o wartości 100 mln dolarów na dostęp do swojego modelu.

Po ich wyczerpaniu będą musieli płacić. Chodzi o to, by „umożliwić zabezpieczenie najważniejszych systemów, zanim modele o podobnych możliwościach staną się powszechnie dostępne”.

Z wypowiedzi niemal wszystkich ekspertów przebija się jedno: Mythos jest prawdopodobnie skuteczniejszy od poprzedników, ale zasadniczo nie zmienia natury problemu. Zmienia się jedynie poziom umiejętności potrzebnych, aby radzić sobie z problemem wykorzystywania sztucznej inteligencji w cyberbezpieczeństwie.

Przyznaje to także Anthropic. Logan Graham, lider jego zespołu symulującego ataki, powiedział w rozmowie z portalem Wired, że nie chodzi o jeden model ani jedną firmę. „Musimy przygotować się już teraz na świat, w którym takie zdolności będą szeroko dostępne za sześć, dwanaście czy dwadzieścia cztery miesiące”. „Wiele założeń, na których zbudowaliśmy współczesne podejście do bezpieczeństwa, może się załamać” – dodał Graham.

Wyścig AI o cyberbezpieczeństwo już trwa

Rynek ma jednak swoje prawa, a konkurencja nie śpi. Wkrótce po tym, jak Anthropic ogłosił, że jego Mythos jest programem zbyt niebezpiecznym, aby szeroko go udostępnić, firma OpenAI poinformowała, że oni też taki mają.

Jej program GPT-5.4 Cyber też ma być dostępny dla firm i dla organizacji, ale w bardziej „demokratycznym” modelu. „Projektujemy mechanizmy, które nie decydują arbitralnie, kto dostaje dostęp do legalnych zastosowań, a kto nie” – pisze OpenAI w oświadczeniu. Jednocześnie firma przyznała, że pełna otwartość nie wchodzi w grę: model ma mieć dodatkowe zabezpieczenia i kontrolę sposobu jego wykorzystania.

I nagle zamiast dyskusji o tym, jak to zatrzymać, mamy licytację na to, kto potrafi zepsuć więcej. Czyli mamy jeszcze sześć, dwanaście albo dwadzieścia cztery miesiące. Potem wiele ważnych rzeczy może przestać działać.

„Tygodnik Powszechny” – jedyny polski tygodnik społeczno-kulturalny.

30 tys. Czytelniczek i Czytelników. Najlepsze Autorki i najlepsi Autorzy.

Wspólnota, która myśli samodzielnie.