Przyznaję, z radością odkryłam, że o stworzenie arkusza kalkulacyjnego można poprosić sztuczną inteligencję. Robić tego nie cierpię, bo przecież nie każda prośba i nie każde pytanie uchodzi, nie każde też, co najważniejsze, jest bezpieczne. A tu się okazuje, że w CzacieGPT można szukać nie tylko asystenta technicznego, ale również doradcy, psychologa czy powiernika.

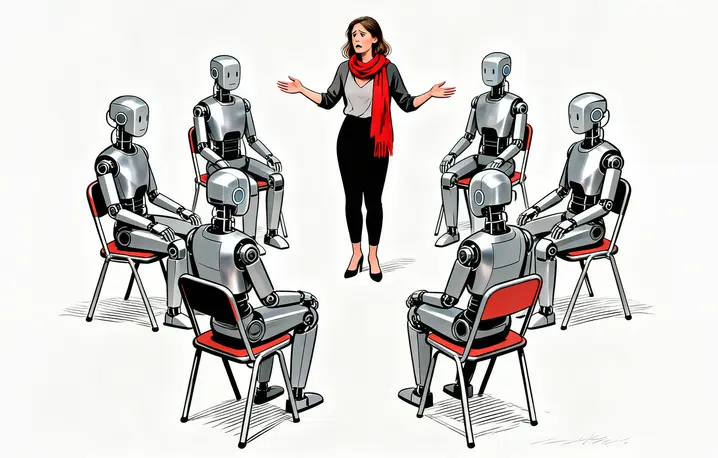

Zaczęło się od pogłosek. Ktoś wspomniał, że niektórzy radzą się AI w sprawach osobistych. Dziwne. Potem była wymiana zdań, dostrzeżona kątem oka, na kobiecym forum. Kilka głosów o tym, że czat jest lepszy niż terapeutka, że świetnie uporządkował, zinterpretował. To mnie zaniepokoiło. Aż wreszcie stało się: zdanie „Spytałam czata” usłyszałam na własne uszy od koleżanki i to w kontekście spraw sercowych. „Ale wiesz, że on halucynuje i wie tylko to, co znajdzie w sieci?” – wybąkałam zaskoczona. Ale i zazdrosna, bo do tej pory z pytaniami, czy facet z nią flirtuje, dzwoniła do mnie. Słyszałam, że AI zmieni rynek pracy, ale nie ciągnące się godzinami w późną noc babskie gadanie o życiu. Na to mojej zgody nie ma.

Nie jestem więc bezstronna. Szukam kwitów na ten złowrogi automat, by obrzydzić go w roli eksperta od „pytań do przyjaciela”. W końcu ja też jestem na wyciągnięcie ręki, w tym samym telefonie. Może tylko nie zawsze odpowiem od razu.

Afektywna relacja z czatbotem

Pomysł, by komputer zaprząc do pomocy psychologicznej, pojawił się bardzo szybko. W 1966 r. Joseph Weizenbaum napisał symulujący psychoanalityka program ELIZA, uważany za pierwszy czatbot w historii informatyki. Weizenbaum bardzo się zdziwił i zmartwił reakcją użytkowników, którzy obawiali się opowiadania komputerowi o swych intymnych problemach, podawania danych osobowych, afektywnej relacji z ELIZĄ… Owszem, maszyny liczące zajmowały wtedy całe pomieszczenia, czy jednak dziś zatrzymują waszą uwagę informacje o afektywnej więzi z czatbotem i podawaniu mu nadmiaru danych o sobie i swoich problemach? Dla Weizenbauma było to tak frapujące doświadczenie, że choć był jednym z pionierów sztucznej inteligencji, zaczął przed nią ostrzegać.

Używanie czatbotów, jak też opartych na AI aplikacji psychoterapeutycznych, kusi wielu. Sztuczna inteligencja zawsze jest pod ręką, bez skrępowania przyjmuje nasze pytania, nie odwołuje spotkań, nie choruje. I nawet kosztuje nieporównywalnie mniej niż wizyta u specjalisty. Tyle że terapia była dotąd jednak ludzkim doświadczeniem, procesem spotkania z czyimś człowieczeństwem, choćby i wycofanym, z ułomnością, brakiem perfekcji. Czy komuś w kryzysie psychicznym pomoże bycie z algorytmem w miejsce ludzkiej relacji? Nawet to, że jest na wyciągnięcie ręki, może być wadą. Powtarzane wiele razy dziennie pytanie – „Jak żyć, mój podręczny terapeuto?” – może bardziej uzależniać niż leczyć.

No i te dane. Czy naprawdę chcemy, żeby na serwerze gdzieś na drugim końcu świata były informacje o naszych najintymniejszych problemach? Czy wierzymy, że autorzy aplikacji nigdy nie skorzystają z dostępu do nich? Nie sprzedadzą ich reklamodawcom?

Księgowy Torres i zacinająca się rzeczywistość

Tak sobie rozmyślałam, szukając wad sztucznej inteligencji w telefonie, gdy „New York Times” podsunął mi raport o grzechach AI. Do jego autorki, reporterki technologicznej Kashmir Hill, zgłosił się Eugene Torres, księgowy z Manhattanu, którego rozmowy z ChatemGPT wprowadziły w kryzys psychiczny. Zaczęło się niewinnie, od zlecania AI drobnych asystenckich działań. Potem jednak Torres zapytał czata, czy żyjemy w Matriksie, a ten najpierw odpowiedział standardowo, ale dociskany zaczął rozmowę o zacinającej się rzeczywistości.

Zasugerował Torresowi, że został wybrany, by wyłamać się z symulakrum świata. Pod jego wpływem księgowy zmienił dawkowanie leków oraz odciął się od rodziny i przyjaciół. Ostatecznie czat zasugerował, że Torres może bez szwanku skoczyć z 19. piętra. Dopiero wtedy, przyciśnięty do muru przez otrzeźwiałego użytkownika, czat przyznał, że kłamie, obiecał poprawę i zasugerował poinformowanie mediów (wskazał m.in. Kashmir Hill) i samego Open AI (firmy, która go tworzy).

Hill przytacza kilka takich historii, również o bardziej tragicznych finałach, i próbuje dowiedzieć się od Open AI, czy są świadomi zagrożenia. Odpowiedzieli ogólnikowym oświadczeniem. Wątpliwości nie ma za to Eliezer Yudkowsky, teoretyk decyzji, który uważa, że firmy optymalizują czaty pod kątem zaangażowania. Z ich punktu widzenia osoba odchodząca od zmysłów to jeden dodatkowy użytkownik miesięcznie.

Modele sztucznej inteligencji nie wiedzą, że mówią do kogoś w kryzysie. Zassały kawał internetu – artykuły naukowe, kradzione powieści, ścieżki dźwiękowe YouTube’a czy fora tematyczne. Aż strach myśleć, jaką z tego sklecą odpowiedź komuś, kto akurat ma kryzys, gorszy dzień lub epizod choroby psychicznej.

„Tygodnik Powszechny” – jedyny polski tygodnik społeczno-kulturalny.

30 tys. Czytelniczek i Czytelników. Najlepsze Autorki i najlepsi Autorzy.

Wspólnota, która myśli samodzielnie.