Wyobraź sobie, że kiedy na ulicy zamawiałeś taksówkę, jakiś zakapturzony młodzik wyrwał ci z ręki telefon i uciekł. Kontakty były w chmurze, więc bez problemu je odtworzyłeś, ale karta była zarejestrowana na brata, który jest za granicą, więc nie udało się wyrobić duplikatu. Kilka tygodni później znów pech: przez roztargnienie zostawiłeś w kawiarni torbę, którą ktoś ukradł, i kolejny telefon przepadł. Na szczęście firma telekomunikacyjna miała dobre promocje i mogłeś sobie pozwolić na nowy smartfon. Tyle że przez to znów zmieniłeś numer. A potem wybuchła wojna i okazało się, że częste zmiany numeru telefonu wystarczą do wydania decyzji, żeby cię zabić. Ciebie i rodzinę, z którą akurat byłeś w domu.

Niemożliwe?

Czy będzie traktat ONZ w sprawie militarnego wykorzystywania AI?

Debata o losach ludzkości odbyła się nie w sali plenarnej Zgromadzenia Ogólnego ani nie na forum Rady Bezpieczeństwa, tylko w piwnicy, gdzie mieści się jedna z sal konferencyjnych nowojorskiej siedziby ONZ. Nie ma się jednak co dziwić, że przedstawiciele 150 państw właśnie tam debatowali – przełomu w sprawie stosowania broni autonomicznej nikt się nie spodziewał.

Cóż z tego, że maleńka Antigua przekonuje, że „nie chodzi o fabułę dystopijnej powieści”, Pakistan argumentuje, że „okno możliwości się szybko kurczy”, a według Austrii „to absolutnie fundamentalna kwestia bezpieczeństwa, prawa i etyki”. Najpotężniejsze państwa porozumienia w tej sprawie po prostu nie chcą. Nie zgadzają się nawet co do tego, co to jest broń autonomiczna.

Pekin uważa, że to broń, która może się uczyć i adaptować, czyli jest wyposażona w sztuczną inteligencję. Amerykanom wystarczy, że działa automatycznie. Francuzi i Niemcy w zasadzie się z tym zgadzają, ale według nich broń autonomiczna musi działać poza kontrolą ludzi, podczas gdy Chińczycy sądzą, że człowiek musi mieć możliwość jej wycofania z pola walki. USA dopuszczają brak takiej możliwości, a Rosja twierdzi, że sprawa kontroli przez ludzi to zagadnienie w tej debacie całkiem nieprzydatne.

I to ledwie wierzchołek sporów. Choć uczciwie trzeba przyznać: najważniejsi gracze – USA, Rosja, Francja, Australia czy Izrael – są zgodni, że żadnego nowego międzynarodowego traktatu w tej sprawie nie potrzeba (Chiny chcą, żeby powstał, ale wedle ich propozycji w zasadzie niczego by nie zabraniał). Jak powiedział Konstantin Woroncow, wiceambasador Rosji przy ONZ: „To po prostu nie jest dobry moment na takie rozmowy”.

W Ukrainie sztuczna inteligencja już jest na polu bitwy

Prof. Stuart Russell, pionier badań nad AI, w nagraniach z Ukrainy widzi przedsmak ponurej przyszłości. Sześć lat temu wraz z Future of Life Institute przygotował animację „Slaughterbots”, w której roje inteligentnych dronów dokonują algorytmicznego ludobójstwa. To miało być ostrzeżenie – apel, żeby wstrzymać prace nad bronią autonomiczną.

Teraz profesor przyznaje, że prześladują go nagrania ataków dronów dokonywanych przez obie strony ukraińskiej wojny. Zwłaszcza widok żołnierzy, którzy początkowo starają się uciec, ale w pewnym momencie zastygają w bezruchu. „Wiedzą, że nie uciekną, więc po prostu czekają na śmierć” – mówi.

Nie zawsze tak się dzieje. Są nagrania, na których widać, że operatorzy dronów, widząc poddających się przeciwników, oszczędzali ich, a nawet wskazywali bezpieczną drogę do niewoli. Automat, któremu postawiony będzie cel, tak nie postąpi.

Ukraina w obliczu agresji stara się stworzyć „dronową Dolinę Krzemową”. Wykorzystuje do tego talent 300 tys. rodzimych pracowników branży wysokich technologii, ale także fundusze i doświadczenie firm zagranicznych. Sednem planu Kijowa jest rządowy program Brave1, wspólne przedsięwzięcie sześciu ministerstw, które wspiera start-upy pracujące m.in. w technologiach medycznych czy logistyce. W ciągu pierwszego roku działania Brave1 zatwierdzono ok. 700 wynalazków, z których 40 trafiło prosto na front.

Najwyższym priorytetem są jednak systemy bezzałogowe. „Celem jest to, by roboty, a nie ludzie, walczyły na polu bitwy – mówił „Politico” ukraiński wiceminister transformacji cyfrowej Aleks Bornjakow. W lutym prezydent Zełenski, ogłaszając powołanie Sił Systemów Bezzałogowych, powiedział, że jego kraj jest na drodze do wyprodukowania ponad miliona dronów do końca 2024 r. A wicepremier Mychajło Fedorow w wywiadzie dla Associated Press oznajmił, że w pełni autonomiczna, zabójcza broń to „logiczny i nieunikniony następny krok” podczas wojny z Rosją.

Kiedy ten krok zostanie wykonany? A może już do tego doszło? To nie jest jasne. Pewne jest natomiast, że wojna faktycznie przyspieszyła wdrażanie nowych technologii. Ukraińska firma Swarmer buduje roje dronów, które automatycznie znajdują cele, wzywają uzbrojone posiłki, a nawet weryfikują skutki bombardowania. Człowiek, który to nadzoruje, ma wcisnąć tylko trzy przyciski, żeby uruchomić system i zatwierdzić atak.

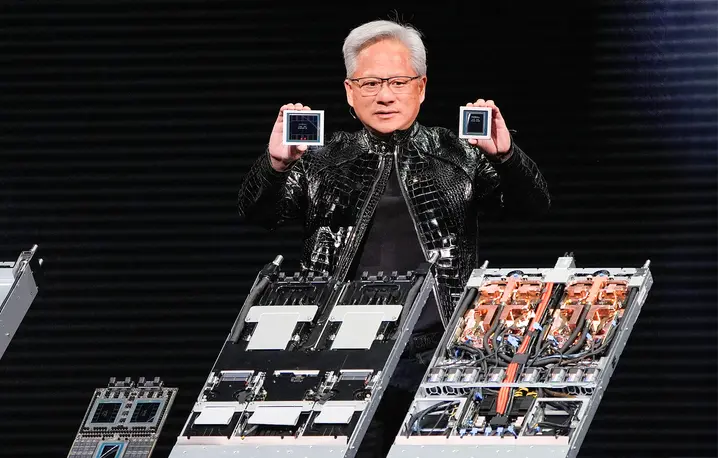

Eric Schmidt, były dyrektor generalny Google, chce iść dalej – jego drony mają być autonomiczne. Zamiast drogich i stosunkowo łatwych do zniszczenia bezzałogowców chce budować roje tanich maszyn, które wykonają misję, nawet jeśli stracą łączność z bazą – wymienią się danymi, namierzą wroga i go zlikwidują. Prototypy dronów Schmidta, które docelowo trafią pewnie do armii USA, były już ponoć testowane w Ukrainie.

Konflikt za naszą wschodnią granicą zmienił nie tylko skalę wykorzystywania bezzałogowców. Opracowywane w USA i dostarczone Ukrainie technologie, czy to z wojskowego Programu Maven, czy z firm takich jak Palantir i Clearview, pomagają zautomatyzować cały backend wojny: zgromadzić w jednym miejscu dane z wojskowych i komercyjnych źródeł, satelitów, dronów czy mediów społecznościowych rosyjskich żołnierzy. Tak powstaje mapa działań wojennych aktualizowana na żywo. I zmieniają się paradygmaty wojny.

Przyglądamy się największym wyzwaniom epoki człowieka oraz drodze, która zaprowadziła nas od afrykańskich sawann do globalnej wioski. Omawiamy badania naukowe i dyskusje nad interakcjami między człowiekiem i innymi elementami przyrody – zarówno tymi współczesnymi, jak i przeszłymi.

Gen. Mark Milley, były przewodniczący Kolegium Połączonych Szefów Sztabów, latem 2023 r. stwierdził: „W dzisiejszych czasach, by przetrwać na polu bitwy, jednostki wojskowe muszą być małe, w większości niewidoczne i muszą się szybko przemieszczać, bo rosnąca liczba sieci czujników pozwala każdemu z dowolnego miejsca na świecie je zobaczyć. A co widzisz, do tego możesz strzelić”.

Wtóruje mu Mick Ryan, emerytowany generał australijski badający rolę technologii w ukraińskich działaniach wojennych: „Zwycięstwo w bitwie o oprogramowanie jest w tej strategicznej rywalizacji niezbędne”.

Strefa Gazy: AI namierza członków Hamasu. Decyzję o ataku muszą szybko podjąć ludzie

Jeden program służy do wskazywania konkretnych osób, m.in. na podstawie tego, gdzie przebywały, z kim miały kontakt (także za pośrednictwem grup w mediach społecznościowych) oraz jak często zmieniają numer telefonu. Kolejny pokazuje, gdzie mieszka taka osoba, a program numer trzy – kiedy wchodzi do domu. Surowe dane są przesiane i statystycznie skatalogowane przez algorytmy AI.

Z dziennikarskiego śledztwa magazynu „+972” wynika, że takie właśnie programy – nazwane Lavender, Habsora i Where’s Daddy – były po zeszłorocznych zamachach w Izraelu wykorzystywane przez tamtejszą armię do wskazywania i likwidacji celów w Strefie Gazy. Celami mieli być członkowie Hamasu i innych grup, które Izrael uznaje za zagrożenie.

– Jest w podejściu statystycznym coś, co wyznacza pewną normę i standard – mówił „+972” jeden z oficerów obsługujących taki program. – Mam o wiele większe zaufanie do mechanizmu statystycznego niż do żołnierza, który stracił przyjaciela dwa dni wcześniej. A wszyscy, łącznie ze mną, w zamachu 7 października kogoś stracili. Maszyna zrobiła to na zimno. I to ułatwiło sprawę.

Skatalogowany był niemal każdy mieszkaniec Gazy, a do sił zbrojnych Izraela (IDF) należało określenie współczynnika błędu, który były skłonne tolerować, akceptując cele oznaczone przez program. Próg ten – wedle źródeł „+972” – zwykle wynosił 10 proc. Mieściły się tu np. osoby o takich samych nazwiskach jak członkowie Hamasu albo osoby dzielące telefony z członkami rodziny zidentyfikowanymi jako członkowie Hamasu. Albo takie, które miały kontakt z kimś z Hamasu i często zmieniały numer telefonu. I takie, które źle sklasyfikował system. Te 10 proc. uznawano za „dopuszczalny błąd w warunkach wojny”.

Dokumentację dotyczącą celów przekazywano analitykom. Wedle „+972” poświęcali oni średnio 20 sekund na każdy. Decydowanie o czyimś życiu lub śmierci zwykle polegało na sprawdzeniu, czy dana osoba jest mężczyzną (zakładano, że kobiety nie są bojownikami). Zatwierdzone listy celów były przekazywane zespołom operacyjnym. IDF atakowało domy wskazane przez program Habsora w czasie wskazanym przez Where’s Daddy. Rodziny i sąsiadów uznawano za „szkody uboczne”. Statystycznie przyjmowano, że dla młodszych członków Hamasu to 15-20 osób.

„+972” twierdzi, że w pierwszych tygodniach wojny IDF niemal całkowicie polegało na Lavender, dzięki któremu wytypowano 37 tys. Palestyńczyków. Według źródeł „Guardiana” wojsko izraelskie stworzyło listę 30-40 tys. podejrzanych, a systemy AI „odegrały w tym kluczową rolę”. Samo IDF oświadcza, że niektóre z tych twierdzeń są bezpodstawne, inne odzwierciedlają błędne rozumienie rozkazów i prawa międzynarodowego, a systemy sztucznej inteligencji są tylko jednym z narzędzi, które pomagają gromadzić i optymalnie analizować informacje wywiadowcze z różnych źródeł.

Wojskowi systemy broni autonomicznej dzielą na trzy grupy: takie, gdzie program samodzielnie podejmuje decyzje, oraz takie, gdzie człowiek inicjuje użycie broni lub może przerwać jej działanie. Te dwie ostatnie grupy nazywane są „człowiek w pętli”. Według Chin i USA to warunek stosowania broni autonomicznej.

W systemach takich jak Lavender człowiek jest „w pętli” dowodzenia. Tyle że – jak zauważa wielu ekspertów – to zwodnicze. I bynajmniej nie chodzi o 20 sekund na decyzję. Przykład mniej drastyczny niż użycie broni: testy wykazały, że na dokładność diagnoz doświadczonych radiologów niekorzystnie wpływały fałszywe wyniki podpowiadane przez AI, która rzekomo miała ich wspomagać. Laure de Roucy-Rochegonde z Centrum Badań nad Bezpieczeństwem Francuskiego Instytutu Stosunków Międzynarodowych (IFRI) twierdzi, że dokładnie ten sam mechanizm działa podczas zatwierdzania celów do ataku. Co więcej – i co też wynika z licznych badań – tam, gdzie człowiek regularnie bazuje na wynikach wskazywanych przez programy – z czasem zaczyna coraz bardziej na nich polegać.

Tajwan kontra Chiny: AI zaatakuje, AI będzie się bronić

W Cieśninie Tajwańskiej jesień i zima nie sprzyjają prowadzeniu manewrów. Silny wiatr i potężne fale powinny skutecznie odstraszać napastników. Z drugiej strony to doskonały czas na atak z zaskoczenia. I wielu analityków twierdzi, że prędzej czy później Pekin się na to zdecyduje. A wtedy wojna może rozstrzygnąć się błyskawicznie.

Dmitrij Alperovitch, szef waszyngtońskiego think tanku Silverado Policy Accelerator, w książce „World on the Brink” przedstawia następujący scenariusz chińskiego D-Day: okręty desantowe, zdolne do przenoszenia śmigłowców, poduszkowców i po 800 żołnierzy każdy, podpływają do granicy tajwańskich wód terytorialnych. Z ich pokładów startuje 200 śmigłowców transportowych eskortowanych przez maszyny bojowe. Dokonujący desantu żołnierze błyskawicznie zajmują w Tajpej port i lotniska. Zaraz potem na wyspę promami, śmigłowcami i samolotami docierają dziesiątki tysięcy żołnierzy, czołgi i transportery opancerzone. Jednocześnie uderzają chińskie rakiety, eliminując broniące wyspy myśliwce i okaleczając radary, radiostacje i nadajniki telewizyjne. Takie uderzenie miałoby zdekapitować tajwański rząd i sprawić, że wojska zbuntowanej prowincji nie byłyby w stanie prowadzić zorganizowanego oporu. Walki mogłyby jeszcze toczyć się miesiącami, ale ich rezultat byłby przesądzony. Zwłaszcza że bez portów i lotnisk sojusznicy Tajwanu nie mogliby pospieszyć z odsieczą.

Tajwańczycy i Amerykanie zdają sobie sprawę z tego zagrożenia. „Chiny chcą krótkiej, gwałtownej wojny. Chcą faktów dokonanych, zanim świat zareaguje” – mówił „The Washington Post” adm. Samuel Paparo, zwierzchnik amerykańskiego Dowództwa Indopacyfiku, dodając: „Moje zadanie polega na tym, by i do 2027 r., i później siły zbrojne USA oraz ich sojusznicy byli w stanie zwyciężyć”.

Kluczem do tego zwycięstwa ma być plan, który nosi nieoficjalną nazwę „Hellscape” (Piekielny Krajobraz). Zakłada on, że kiedy chińskie siły wyruszą, na Tajwanie uruchomione zostaną tysiące dronów. Mają to być współpracujące ze sobą roje działające z minimalnym udziałem człowieka lub całkowicie sterowane przez AI. Ukryte w głębinach bezzałogowce – w zasadzie torpedy czekające na dnie – mają uderzyć w kluczowe jednostki wroga. Pomóc w ich zatopieniu mają samosterujące motorówki. A do tego chmara dronów ma ogłupić systemy obrony przeciwlotniczej Chińczyków i dobić te jednostki, które nie zostaną zatopione spod wody. „Chcę zmienić Cieśninę Tajwańską w bezzałogowy, piekielny krajobraz z wykorzystaniem szeregu niejawnych środków” – mówił Paparo.

Tyle że przeciwnikiem są Chiny, globalny lider w produkcji dronów i sztucznej inteligencji, a budżet wojskowy Pekinu może być – według admirała – trzykrotnie wyższy od podawanego oficjalnie. Oznaczałoby to, że ChRL wydaje na zbrojenia rocznie ok. 700 mld dolarów. Znaczna część tych wydatków idzie właśnie na systemy bezzałogowe sterowane przez AI.

Jednym z chińskich osiągnięć na tym polu jest „Zhu Hai Yun” – formalnie to statek badawczy, RAND Corporation twierdzi jednak, że umożliwia on mapowanie głębokości dla okrętów podwodnych i rozmieszczanie inteligentnych min. Głównie zaś ma to być prototyp zupełnie nowej generacji okrętów wojennych – baza dla flotylli dronów, zdolna do dowodzenia maszynami podwodnymi, pływającymi i latającymi. Potencjalnie: baza bezzałogowa.

Jak na ironię, pierwsza w historii wojna, w której mocarstwa wystawią przeciw sobie broń autonomiczną, może się rozegrać właśnie o Tajwan – niekwestionowanego lidera w produkcji chipów (80 proc.) i serwerów (90 proc.) niezbędnych do działania sztucznej inteligencji. Tajwański koncern tej branży, TSMC, zapowiedział, że nie chce, by w razie inwazji jego produkty lub technologia wpadły w ręce Chin: urządzenia w jego fabrykach mają wmontowany „zdalny włącznik autodestrukcji”.

Czy sztuczna inteligencja sprawi, że wojny będą bardziej humanitarne?

Amerykanie i Brytyjczycy podkreślają, że broń autonomiczna jest bardziej precyzyjna od konwencjonalnej, co pozwala uniknąć ofiar wśród cywilów. Taka broń, zdaniem jej zwolenników, pozwala też wyeliminować z pola walki przemoc seksualną i emocje, często będące podłożem zbrodni wojennych.

Warto podkreślić: choć broń autonomiczna jest wynalazkiem naszych czasów, to w sprawie jej wykorzystywania ma zastosowanie szereg już istniejących aktów prawa międzynarodowego, m.in. konwencje haskie czy Konwencja o zakazie lub ograniczeniu użycia pewnych broni konwencjonalnych, które mogą być uważane za powodujące nadmierne cierpienia lub mające niekontrolowane skutki. Wszystkie one mówią jednoznacznie: atakowanie cywilów to zbrodnia. I AI, choć może się wydawać, że zapewnia outsourcing dla sumienia, alibi nie daje.

A co, jeśli broń autonomiczna zaatakuje przez przypadek, np. wskutek błędu oprogramowania? Tu precedensem jest Międzynarodowe Prawo Kosmiczne, które stanowi, że państwo odpowiada za szkody wyrządzone przez jego urządzenia.

Zwolennicy inteligentnych maszyn do zastosowań wojskowych twierdzą, że mogłyby one nie tylko ograniczyć straty wśród żołnierzy, ale uczynić ich udział w walkach w zasadzie zbędnym. Na taki argument prof. Russell odpowiada: „Gdyby tak było naprawdę, o wyniku wojen można by decydować grając w pchełki. Sądzę, że w rzeczywistości wojny kończą się, gdy liczba ofiar śmiertelnych i poziom zniszczeń stają się dla jednej lub obu stron po prostu zbyt wysokie”.

Profesor w eseju opublikowanym przez „Issues in Science and Technology” zwraca uwagę na jeszcze inny aspekt związany z użyciem broni autonomicznej: „Dla badacza zajmującego się AI autonomia w przypadku broni jest dokładnie tym samym, co w programach szachowych. Człowiek pisze program, który gra w szachy, ale to nie on decyduje o kolejnych ruchach. Naciskamy przycisk start i decyzje podejmuje program. Bardzo szybko program przejdzie do takich pozycji na szachownicy, których nikt dotąd nie widział na oczy, i wówczas na podstawie własnych złożonych, nieprzeniknionych obliczeń podejmie decyzje, którą figurę ruszy i które figury przeciwnika zbije”.

Dokładnie tak samo na pewnym etapie rozwoju działać będzie broń autonomiczna. Jaki potencjał kryzysu niesie interakcja dwóch wrogich sztucznych inteligencji, jeśli będą go mogły eskalować wedle własnego uznania?

Człowiek w tej „pętli”, jeśli w ogóle będzie, może nie zdążyć wcisnąć wyłącznika.

Atom: kto kogo odstrasza

Rewolucyjną cechą broni atomowej – bez względu na podejmowane przez dziesięciolecia wysiłki – jest brak możliwości skutecznej obrony przed nią. Jej istnienie wymusiło więc zmianę nie tylko sposobu, ale przede wszystkim celu prowadzenia wojen. Carl von Clausewitz podkreślał, że celem wojny powinno być zapewnienie bezpieczeństwa państwu, więc skala konfliktu musi być ograniczona: „Zamiar polityczny jest bowiem celem, wojna zaś środkiem, a środka bez celu nie można sobie wyobrazić”. Wojna nuklearna tymczasem zagraża celowi, w jakim wojny są toczone, a samo użycie siły może zniszczyć to, co miało być chronione. Bernard Brodie, architekt pierwszej amerykańskiej strategii odstraszania, już w 1946 r. twierdził, że o ile wcześniej celem wojskowych było wygrywanie wojen, to wraz z rozpoczęciem epoki atomowej „głównym celem stanie się zapobieganie wojnom”, bo – jak ujął to Kenneth Waltz blisko cztery dekady później – „w konflikcie konwencjonalnym nie ma pewności kto wygra, a kto przegra. Natomiast w nuklearnym świecie nie ma pewności co do przetrwania albo bycia unicestwionym”.

Sposobem na zapobieganie wojnie atomowej stało się więc odstraszanie. Osiągnięta w ten sposób równowaga nacechowana była jednak paradoksami. O ile bowiem równowaga sił jest zjawiskiem obiektywnym, to – jak zauważa prof. Łukasz Kamieński w eseju „Broń jądrowa i rewolucja w strategii” – „wzajemne odstraszanie nuklearne było zasadniczo naznaczone subiektywizmem, bo opierało się na wierzeniach, przekonaniach, percepcji, interpretacji działań przeciwnika”.

Co więcej, odstraszanie przed epoką atomową polegało na przekonaniu wroga, że nie powinien podejmować ataku, bo nie ma szans na wygraną – skalkulowanie ewentualnych korzyści i strat było kwestią obiektywną. W epoce broni atomowej ten schemat wyparło odstraszanie oparte na karze – w przypadku ataku jego koszty staną się nie do przyjęcia dla atakującego. Prof. Kamieński: „Hamulcem przed rozpętaniem wojny globalnej była więc sama perspektywa jej prowadzenia, a nie wizja przegranej”. Z tego powodu prowadzenie wojny atomowej przestało mieć sens, bo nie mogło prowadzić do militarnego zwycięstwa.

Czy uzbrojona sztuczna inteligencja może stać się bronią masowego zniszczenia naszych czasów? Niekoniecznie, szczególnie że aż takiego potencjału siania masowego zniszczenia jak atomówki – przynajmniej na razie – nie ma.

Stany Zjednoczone – bez względu na to, że same rozwijają programy broni autonomicznej – od pewnego czasu zabiegają o wprowadzenie zakazu stosowania AI w systemach broni atomowej. Pekin odmawia.

Projekt dofinansowany ze środków budżetu państwa, przyznanych przez Ministra Nauki i Szkolnictwa Wyższego w ramach Programu „Społeczna Odpowiedzialność Nauki II”.

„Tygodnik Powszechny” – jedyny polski tygodnik społeczno-kulturalny.

30 tys. Czytelniczek i Czytelników. Najlepsze Autorki i najlepsi Autorzy.

Wspólnota, która myśli samodzielnie.