Piotr Jończyk: Dlaczego ludzie obawiają się rozwoju sztucznej inteligencji?

Prof. Joanna Rączaszek-Leonardi: Jesteśmy w podobnej fazie rozwoju sztucznej inteligencji jak wtedy, gdy w motoryzacji nastąpił postęp i pojawiało się coraz więcej samochodów. Pierwsze auta pędziły po wsiach i rozjeżdżały kury, owce, psy i ludzi. To było przerażające, więc niektórzy, chcąc oswoić widok pędzących maszyn, zakładali na nie sztuczną głowę konia.

Obecnie niektóre sztuczne systemy „inteligentne” mają twarz lub nawet ciało człowieka, a użytkownicy przypisują im posiadanie celów, intencji czy uczuć. Roboty z twarzą, zamiast oswajać sztuczną inteligencję, mogą paradoksalnie wzmacniać lęki przed „zastąpieniem” człowieka i dominacją sztucznej inteligencji nad ludźmi.

W końcu zrezygnowaliśmy z utożsamiania samochodów i koni.

Dopiero odpowiednia infrastruktura i regulacje sprawiły, że przestaliśmy bać się samochodów i nauczyliśmy się z nich bezpiecznie korzystać. Nie powinniśmy antropomorfizować czatów i botów, tylko szukać nowych narzędzi teoretycznych, żeby rozumieć miejsce tzw. sztucznej inteligencji w działaniach człowieka. Szczególnie potrzebujemy podejść, które pozwolą nam zrozumieć jej wpływ na relacje między ludźmi i życie społeczne. Obecne dyskusje wciąż opierają się na założeniach z lat 50., które niekoniecznie przystają do współczesnej wiedzy.

Jakie są więc źródła tego, w jaki sposób myślimy o sztucznej inteligencji?

Przez lata w badaniach nad umysłem dominowała metafora komputerowa, czyli przekonanie, że myślenie to sekwencja: bodziec, przetwarzanie informacji, a na koniec wynik myślenia, czyli reakcja.

Obiektem zainteresowania dużej części naukowców stało się badanie jednostkowego umysłu i tego, w jaki sposób tworzy język, żeby rozumieć rzeczywistość. Ale nie możemy zapominać, że umysł odzwierciedla to, jak był wychowywany i rozwijał się w relacjach społecznych. Myślenie i inteligentne zachowanie ujawniają się głównie w kontakcie z innymi ludźmi.

Metafory, które przyrównują myślenie do działania komputera, zadomowiły się w języku – mówimy o sobie, że „styki nam się przegrzewają”, młodsi powiedzą, że „brakuje im ramu”.

Metafora komputerowa działa w dwie strony – komputerom przypisujemy ludzkie cechy, a ludzkie myślenie opisujemy językiem informatyki.

Pojawienie się komputerów pomogło w zmianie metodologii i rewolucji w psychologii. Wcześniej dominował behawioryzm, skupiano się przede wszystkim na zachowaniu. Potem, gdy pojawiły się komputery, w końcu mieliśmy urządzenie, w którego wnętrzu dzieje się bardzo dużo ciekawych rzeczy. Tak jak w naszej głowie.

To była dobra metafora do uporządkowania na nowo dziedzin psychologii – wyodrębniono osobne gałęzie, które zajmowały się poszczególnymi „częściami” umysłu: pamięcią, uwagą, buforem sensorycznym. Przyniosła ona ze sobą jednak dużo szkodliwych uproszczeń, w tym przekonanie, że procesy umysłowe da się łatwo symulować jako procesy obliczeniowe. Niezależnie, czy dotyczą twierdzeń matematycznych, czy problemów etycznych.

Nawet jeśli twórcom czy teoretykom sztucznej inteligencji coś umyka, np. społeczny kontekst, to jednak sztuczna inteligencja rozwija się bardzo szybko. Żadne z nas nie wygra z AI w szachy.

Zauważ, że zawsze mówimy o „zadaniach stawianych przed sztuczną inteligencją”. Jeśli postawimy przed maszyną Deep Blue zadanie, żeby wygrywała w szachy, to ona się tego nauczy.

Jest ogromna różnica między organizmami żywymi a jakąkolwiek technologią. Organizmy żywe mają instynkt przetrwania i zachowują wartości, które temu przetrwaniu służą. Sztuczna inteligencja nie będzie chciała niczego, czego nie chcieliby jej twórcy.

Gdy patrzymy na odkurzacz, który sam podjeżdża do stacji ładującej, to możemy pomyśleć, że samodzielnie podtrzymuje swoje zasoby życiowe. Ale to my mamy nad tym kontrolę – w jakie funkcje wyposażamy technologię i kiedy chcemy ją wyłączyć.

Publicysta „New York Timesa” Oliver Whang przywołał słowa Josha Bongarda, robotyka z Uniwersytetu Vermontu, według którego sztuczną inteligencję należy wyposażyć w ciało, bo to ono stanowi podstawę inteligentnego, ale przede wszystkim bezpiecznego działania.

Stoi za tym słuszna intuicja, że inteligencja człowieka to nie tylko jego mózg. Ale zarazem powszechne i nieuzasadnione przekonanie, że tzw. sztuczna inteligencja jest bezcielesna. Przywiązaliśmy się do myślenia, że ciało oznacza zawsze coś biologicznego czy organicznego.

Jednak ChatGPT nie funkcjonuje przecież bez ucieleśnienia w sieciach i gigantycznych serwerach, które pożerają ogromne ilości energii, oraz bez końcówek w postaci naszych telefonów i komputerów.

Zasadnym pytaniem jest, w jakie ciało wyposażać sztuczną inteligencję. Wyposażanie w „biologiczne” ciało algorytmicznych rozwiązań konkretnych problemów – takich jak gra w szachy czy podsumowywanie tekstów – przypomina głowę konia, o której mówiliśmy wcześniej.

Wiele z mechanizmów sztucznej inteligencji jest inspirowanych tym, jak działa mózg.

Chociaż to, jak one się mają do prawdziwego mózgu, to inny temat, bo to dalej jedynie maleńki fragment rozwiązań inspirowanych działaniem prawdziwych sieci neuronowych. Na razie wykorzystaliśmy wiedzę o niektórych aspektach architektury mózgu, jedynie po to, by coraz dokładniej rozpoznawać współzależności statystyczne.

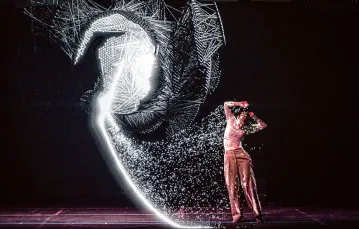

Możliwe, że gdybyśmy poświęcili tyle czasu inteligencji zaklętej w ruchu, ile poświęciliśmy na badania nad neuroobrazowaniem mózgu, to bylibyśmy w zupełnie innym miejscu, także jeśli chodzi o obawy związane z tzw. sztuczną inteligencją.

W ruchu wyraża się cała gama inteligentnych zachowań. Z ruchu innych ludzi potrafimy odczytać, czy są do nas usposobieni dobrze, czy źle. Na mikroruchy twarzy reagujemy niemal zawsze bezpośrednio – gdy ktoś się do nas uśmiecha, my też się uśmiechamy.

Natalia Waloch pisała w „Wysokich Obcasach” o tym, że ludzie stworzyli AI, która mogła wygrać z Kasparowem w szachy, ale dalej nie taką, która umie zetrzeć plamę z kanapy.

To oczywiście mówi o brakach sztucznej inteligencji i jak jest rozwijana. Ale czy rzeczywiście chcielibyśmy, żeby wszystkie obszary życia były obsługiwane przez roboty i sztuczną inteligencję?

Przeprowadzono wiele badań o wpływie relacji z lekarzem na proces zdrowienia. Okazało się, że zwykła rozmowa z medykiem, niekoniecznie dotycząca stanu zdrowia pacjenta, przekłada się na to, że pacjent lepiej rozumie swój stan, co zwykle przekłada się na szybszy wypis ze szpitala.

Technologia wiele ułatwia, ale jeśli jej rozwój zmniejsza częstotliwość i jakość kontaktów międzyludzkich, to powinna nam się zapalić czerwona lampka.

Dzięki wielu technologiom te kontakty mogą być też częstsze.

Psycholożka Sherry Turkle opowiadała podczas swojego TedTalku, że spotyka nastolatków, którzy postanowili, że pora nauczyć się rozmawiać z innymi, bo dotąd większość ich komunikacji była zapośredniczona przez różne media. To było ponad 10 lat temu, a pandemia jeszcze bardziej pogłębiła ten problem, poprzez upowszechnienie zdalnej komunikacji. Co z kolei, jak wynika z badań w naszej pracowni, przełożyło się na dobrostan psychiczny i jakość interakcji.

Łatwiej zauważyć wady i zalety każdej technologii, gdy myślimy o niej jako o czymś, co zmienia relacje między człowiekiem a człowiekiem.

Technologie cyfrowe sprawiają, że możemy przesłać komuś w odpowiednim momencie coś, co odczuje jako prawdziwe wsparcie. Po angielsku mówi się na to digital hug – cyfrowe przytulanie. Jednocześnie taki punkt widzenia umożliwia dostrzeżenie negatywnego wpływu nowych technologii, np. masowych niebezpośrednich kontaktów, które umożliwiają edytowanie tekstu przed wysłaniem czy ukrycie własnej tożsamości.

Wydawałoby się, że możliwość redagowania wiadomości przed wysłaniem to akurat dobra rzecz. Musimy się zastanowić, co chcemy powiedzieć, łatwiej nie odpowiadać impulsywnie i „w emocjach”...

Przyzwyczajenie do takiej komunikacji może wywoływać lęk przed popełnieniem błędu w komunikacji „na żywo”, kiedy bierzemy odpowiedzialność za wszystko, co mówimy, i nie możemy redagować wypowiedzi. Zapośredniczenie powoduje odarcie komunikacji z elementów relacji międzyludzkich, które są naturalne w sytuacji rozmowy twarzą w twarz – uważności wobec drugiego człowieka, możliwości popełnienia błędu i jego naprawy w dialogu.

Badacz sztucznej inteligencji Michał Kosiński przekonywał niedawno na tych łamach, że ChatGPT dysponuje teorią umysłu – jest w stanie odczytywać nasze emocje oraz przynajmniej symulować własne.

Wszelkie stwierdzenia, że modele językowe „myślą” albo „rozumieją język”, które pojawiają się nawet w wypowiedziach znanych naukowców, są przejawem częstej tendencji do przypisywania rzeczom i maszynom stanów intencjonalnych, których te po prostu nie mają.

To, co generują modele językowe, to nie są myśli ani wypowiedzi, tylko ciągi znaków tworzone na podstawie złożonych wzorców statystycznych współwystępowania słów.

Gdy zaczniemy myśleć o Chacie GPT nie jak o agencie czy bycie inteligentnym, tylko jak o czymś, co modyfikuje to, co dzieje się między ludźmi, to będziemy mogli zacząć budować lepszy aparat teoretyczny. Będziemy mogli dojrzeć, jak zmieniają się wartości, które są realizowane w relacjach. A także to, które z nich można zrealizować, a których zrealizować się nie da.

Mogłabyś przedstawić to na jakimś przykładzie?

Często pojawia się pytanie, czy należy pozwalać uczniom na używanie Chata GPT w szkołach. I to jest bardzo dobre pytanie.

Sam Altman, szef firmy Open AI, mówi, że stworzony przez nią ChatGPT wyzwala kreatywność, ja powiedziałabym, że kreatywność dusi, ponieważ podaje nam średnie rozwiązania. Podpowiada nam to, co w różnych opracowaniach pojawia się najczęściej, co jest nudne i banalne. Jeśli jesteśmy dobrymi nauczycielami, to chcemy, żeby uczniowie umieli wyjść poza schemat.

Ale znowu, w ten sposób patrzymy na samego ucznia jak na osobną jednostkę, a to, co powinno być przedmiotem analizy, to cały kontekst społeczny.

Gdy proszę ucznia, żeby coś zrobił, to chcę go wielu rzeczy nauczyć: znajdowania informacji, samodzielności, szacunku do drugiego człowieka, także do mnie i do mojej pracy, ale również tego, że ja go szanuję. Jeśli uczeń chce wypróbować ChatGPT do znajdowania informacji, to nie ma problemu. Ale niech z szacunku do mnie powie, ile z tego, co napisał, wygenerował model, a kiedy ChatGPT go rozczarował – to ostatnie może być całkiem dobrym zadaniem domowym.

Z drugiej strony, możemy spojrzeć na ucznia i jego relacje oraz wartości, które wypracowuje w szkole. Może pomyśleć: „Ja używam Chata GPT, a Kazek nie używa, ja dostanę szóstkę, a on trójkę. Jak się z tym czuję?”. Niespecjalnie, prawda?

Albo wręcz przeciwnie.

Może będzie się czuł super, bo chce wykorzystywać nowe technologie. Ale to jest jego relacja z kolegą, a nie między nim a Chatem GPT. Między dwójką kolegów jest wygenerowany tekst, który ma wpływ na ich sposób uczenia się i oceny. Używanie Chata GPT zmienia przede wszystkim ich relacje – ze sobą nawzajem i z innymi osobami.

W jaki sposób to może nam pomóc w tworzeniu przepisów, które będą regulowały użycie sztucznej inteligencji?

Komisje regulacyjne czekają na pierwsze przypadki, które zostaną do nich zgłoszone. To pokazuje, że bardzo trudno opracować przepisy bez analizy sytuacji, które przeszły przez czyjeś pierwszoosobowe doświadczenie. Zastosowań, które wyrządziły jakąś szkodę albo zrobiły coś dobrego.

Jeśli chodzi o duże modele językowe i bazujące na nich systemy konwersacyjne, takie jak ChatGPT, na początku powinniśmy skupić się na rozpoznaniu, gdzie – na ścieżce od człowieka do człowieka, która modyfikowana jest poprzez użycie różnych narzędzi cyfrowych – postawić czyjeś pierwszoosobowe doświadczenie, czyli takich „wartowników”. Kogoś, dla kogo tekst nie jest jedynie ciągiem wyrazów, ale kto potrafi poczuć jego moc oddziaływania i jest w stanie wyobrazić sobie jego wpływ na innych.

Tego prawdopodobnie nie da się zrobić całkowicie automatycznie. Ale jeśli będziemy wiedzieć, jak i na które relacje wpływają sztucznie tworzone systemy i ich produkty, to będziemy mogli właściwie wybrać, gdzie wartowników postawić na stałe.

Co mieliby robić tacy wartownicy?

Pojęcie wartownika nasunęło mi się po przeczytaniu książki Harper Lee „Idź, postaw wartownika”. Tytuł pochodzi z Biblii, gdzie wartownik oznacza kogoś, kto jest naocznym świadkiem, doświadcza dziejących się wydarzeń. U Harper Lee to osoba, która stanowi moralny kompas w trudnych sytuacjach, kiedy nie można odwołać się do skodyfikowanych norm.

Każdy z nas powinien być takim wartownikiem dla własnych tekstów i wypowiedzi, które czytają lub słyszą inni. Czy przesłałabym komuś tekst wygenerowany przez ChatGPT jako mój tekst, nie czytając go wcześniej? Nie. A w ten sposób zachowują się twórcy takich modeli – dają możliwość rozmowy ze sztucznym systemem, ale nie biorą odpowiedzialności za jego „wypowiedzi”.

Wszyscy powinni mieć świadomość, co znaczy posłużyć się wygenerowanym przez sztuczną inteligencję tekstem bez czytania go, a firmy powinny umieć to skalować do swoich produktów.

Nauka powinna natomiast dostarczyć sposoby sprawdzenia, czy i jak sztucznie tworzone systemy, realizując jedne wartości, nie powodują przy okazji, że inne wartości są poświęcane na ołtarzu „szybciej, wyżej, dalej”. Potrzebujemy umieć rozpoznać, czy np. zyskując wygodę porozumiewania się na odległość z dużymi grupami osób, nie tracimy bezpośredniego kontaktu z drugim człowiekiem albo naturalnego rytmu interakcji między rodzicem a dzieckiem.

Podejrzewam, że to nie jest priorytet dla technologicznych gigantów.

To przerażające, co niedawno mówił Mustafa Suleyman, dyrektor generalny Microsoft AI, w rozmowie z Gazetą.pl. Jego słowa: „Wyobraź sobie, że masz trenera, kolegę i powiernika w kieszeni w trybie 24/7, który zna cię, pomaga ci, może robić rzeczy w twoim imieniu, aby ułatwić ci życie i osiągnięcie celów. Uważam, że to byłoby niesamowite” – mówią więcej o człowieku, który taki wyłączalny system w kieszeni nazywa kolegą czy powiernikiem, niż o samej sztucznej inteligencji.

Ilustruje to dość dobrze, kto stoi za tworzeniem niektórych systemów oraz jaki tryb życia i życiowe wartości są dla tych osób istotne.

I to jest druga rola wartownika – stać na straży tych wartości międzyludzkich, które mogą być zagrożone przez nadmierne zapośredniczenie kontaktów przez technologie. Musimy wiedzieć, co w tych kontaktach jest na tyle istotne, że przekłada się na nasz dobrostan i jakość życia.

W jaki sposób możemy do tego doprowadzić?

Mam wrażenie, że na razie jesteśmy na tyle skupieni na pojedynczym umyśle, że nawet nie bardzo wiemy, co badać.

Ostatnio w gronie współpracowników europejskiego projektu Traincrease, który dotyczy społecznych podstaw poznania, zaproponowaliśmy, żeby jak najszybciej poważnie się nad tymi miarami zastanowić. Żeby nie było podobnie jak z poziomem CO2 i zanieczyszczeń. Gdybyśmy wiedzieli, że warto je monitorować, podjęlibyśmy działania na rzecz klimatu wcześniej. Jeśli nie będziemy wiedzieć, co mierzyć, możemy ponownie ocknąć się, gdy będzie już za późno.

Kluczowe jest sprawdzanie, jak zmienia się nasza empatia i relacje oraz jaką rolę mają w tym nowe technologie. Jak dostrzegać, kiedy i dlaczego ludzie zaczynają preferować kontakt z czatem niż prawdziwym człowiekiem? Jak uczyć ludzi dostrzegania tego u siebie samych?

Powinniśmy zacząć mierzyć, jak zmienia się nasza uważność oraz odczuwanie satysfakcji z kontaktu z innymi. Z drugiej strony, należy przyglądać się poczuciu osamotnienia, oderwania czy niezręczności w życiu społecznym.

Uważam, że w obliczu rozwoju nowych technologii to są obecnie najważniejsze zadania stojące przed naukami kognitywnymi, psychologią i socjologią.

Prof. Joanna Rączaszek-Leonardi jest psycholożką, założycielką Human Interactivity and Language Lab (Pracowni Badania Interaktywności i Języka) na Wydziale Psychologii UW. Specjalizuje się w psychologii poznawczej i kognitywistyce, bada związki między zjawiskami językowymi a procesami umysłowymi.

„Tygodnik Powszechny” – jedyny polski tygodnik społeczno-kulturalny.

30 tys. Czytelniczek i Czytelników. Najlepsze Autorki i najlepsi Autorzy.

Wspólnota, która myśli samodzielnie.