Polscy wikipedyści spotykają się co roku na wydarzeniach organizowanych przez Stowarzyszenie Wikimedia Polska. W 2025 r. podczas takiego spotkania w Lublinie pewien wikipedysta zwrócił uwagę na problem z biogramem Zuli Pacanowskiej. Ta polska aktorka żydowskiego pochodzenia, przed wojną komunistka, potem sanitariuszka z łódzkiego getta, została zamordowana przez Niemców w 1942 r.

Kontrowersje wzbudziła ilustracja. Oryginalna fotografia Pacanowskiej została „przeskalowana przy użyciu sztucznej inteligencji”, gdyż pierwotny wizerunek „jest niewyraźny i wydrukowany w małym formacie na papierze słabej jakości”.

Wikipedia to społeczność, która ostrożnie, a momentami wręcz wrogo podchodzi do sztucznej inteligencji – odrzucane są wszystkie edycje AI, istnieje grupa do walki z takimi treściami. Mimo to poprawione w photoshopie i powiększone maszynowo zdjęcie nadal ilustruje biogram Pacanowskiej. Być może taką ingerencję w źródło społeczność jest w stanie zaakceptować.

AI i historia: gdzie kończy się rekonstrukcja, a zaczyna manipulacja

W dyskusji o wpływie AI na pamięć historyczną łatwo o przesadę. Sam się na tym złapałem, gdy moje social media zaczęły pokazywać mi koloryzowane maszynowo historyczne zdjęcia. Nie myślałem nawet o tym jak o manipulacji (choć to manipulacja). Irytowało mnie, że ludzie nie są w stanie przyjąć historii takiej, jaka jest: z ograniczoną liczbą niedoskonałych źródeł.

Luke McKernan, brytyjski historyk filmu, pisze na swoim blogu, że „jeśli chcemy zachęcić nowe pokolenie do zrozumienia tego, co oznaczała wojna (…), powinniśmy zachęcać je do oglądania filmów [historycznych] w takiej postaci, w jakiej zostały one wytworzone i przez ten wysiłek zachęcać do doceniania ich za to, czym były i co współcześnie znaczyły”.

„To właśnie wysiłek prowadzi do zrozumienia – przekonuje McKernan. – Bez niego nie ma prawdziwej empatii, jest tylko fałszywa sentymentalność. Film, który wygląda, jakby został nakręcony w zeszłym tygodniu, przynależy tylko do zeszłego tygodnia”.

Kolorowanie starych zdjęć i filmów wydawało mi się właśnie takim brakiem szacunku dla przeszłości. Jednak sprawa nie jest tak jednoznaczna.

Czy koloryzowanie zdjęć pomaga doświadczyć przeszłości

– Koloryzowanie czarno-białej fotografii jest naruszeniem materiału źródłowego. Ale rozbierając ten problem na czynniki pierwsze, sama czarno-biała fotografia też jest jakimś zniekształceniem źródła, bo przecież świat nie jest czarno-biały – mówi mi Paweł Sawicki, redaktor naczelny miesięcznika „Memoria” i zastępca rzecznika prasowego Muzeum Auschwitz-Birkenau.

– Jestem w stanie zrozumieć, że ktoś chce zobaczyć, jak przeszłość wyglądała w kolorze. Choć to ryzykowne. Wiemy np., że trójkąt więźnia Auschwitz na danym zdjęciu był czerwony, bo był to więzień polityczny, ale z koloryzacji wynikać może coś innego. Próbując zbliżyć się do jakiejś rzeczywistości, możemy ją jeszcze bardziej zagmatwać – uważa Sawicki.

Paweł Sawicki odnosi się do realiów historycznych, podobnie jak ja w mojej krytyce koloryzacji. Jednak w sferze pamięci historycznej nie chodzi tylko o fakty („jak było”) – czasem potrzebujemy czegoś więcej.

Przeszłość wywołuje nostalgię, dumę, wymaga upamiętniania czy nawet przeżycia żałoby. Jeśli koloryzacja zdjęć i filmów może być sposobem na wyrażanie tych emocji, trudno – historycy i historyczki, muzea i archiwa i tak nie mają narzędzi, by takie przetworzenia blokować.

Autentyczność fotografii historycznej w epoce AI

Niezależnie od intencji, kosztem jest tu jednak zawsze autentyczność źródła.

– Koloryzowana fotografia historyczna może wywołać w odbiorcy przeświadczenie, że ma do czynienia z czymś autentycznym. To jednak wprowadzenie do obiegu fałszywej informacji. A przy tym dobrze ukrywającej fałszerstwo, bo ta zmiana wydaje się zupełnie przezroczysta – uważa prof. Wiktor Werner, historyk z UAM.

Choć więc koloryzacja czarno-białych zdjęć może pomóc nam wchodzić w dialog z przeszłością, to jednocześnie zatruwa źródła jej poznania. Kolorowane obrazy i filmy funkcjonują w internecie na tych samych warunkach, co oryginały. Mało kto czyta podpisy czy sprawdza metadane. Wyszukiwarka podpowie nam wizerunki z przeszłości bez względu na to, skąd pochodzą i jaki mają status.

Tymczasem fotografia, jak przypomina Paweł Sawicki, jest w naszej kulturze od stu kilkudziesięciu lat i polega na pewnym zaufaniu: – Zdjęcie niesie ze sobą domyślne założenie, że ktoś był w określonym miejscu i zrobił je, a to znaczy, że ta scena tak wyglądała.

Wobec sztucznej inteligencji takie założenie, oparte na zaufaniu, jest już jednak niemożliwe.

Ożywianie zdjęć ofiar: kiedy AI przekracza granice etyczne

Bywa, że nawet historycy, którzy nieufności do źródeł uczyli się przecież na studiach, mają problem z rozpoznawaniem autentyczności treści znajdowanych w internecie.

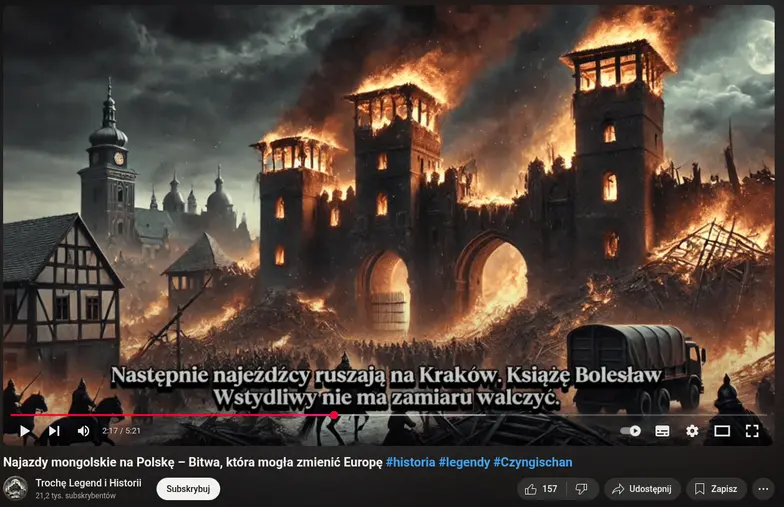

Wiktor Werner przyznaje, że ogląda programy historyczne na YouTubie w kilku językach. Czasem są ilustrowane oryginalnymi zdjęciami z epoki z dodaną narracją, ale czasem ilustracje to wytwory sztucznej inteligencji. – Zdarzają się takie, przy których muszę robić pauzę i zastanowić się, z czym w ogóle mam do czynienia – przyznaje Werner.

Sztuczna inteligencja podważa zaufanie do fotografii nie tylko dlatego, że daje możliwość łatwej koloryzacji, ale także gdyż pozwala generować nieistniejące sceny. Oraz ożywiać.

– Ożywianie zdjęć jest groźne etycznie, gdyż mamy tu już złudzenie ruchu i np. twarz może zdradzać konkretne emocje. A przecież nie wiemy, co ta osoba czuła, gdy była fotografowana – mówi Sawicki. Edukator z Muzeum Auschwitz wspomina:

– Kilka lat temu zwróciło się do nas muzeum z Kambodży, które upamiętnia ludobójstwo Czerwonych Khmerów, informując o artyście, który jakimś programem edytował zdjęcia ofiar tak, że zaczynały się uśmiechać.

Chodzi o Matta Loughreya z Irlandii. W 2021 r. opublikował w magazynie „Vice” cykl kolorowanych zdjęć ludzi zamęczonych w więzieniu S-21 w Phnom Penh (dziś jest tam Muzeum Ludobójstwa), manipulując też wyrazem ich twarzy. Materiał zdjęto z sieci po tym, jak skrytykowały go władze Kambodży, Muzeum Ludobójstwa i rodziny ofiar.

Loughrey nie tylko bezcześcił pamięć ofiar. Było to też kulturowe i pamięciowe zawłaszczanie dramatycznej historii Kambodży, gdzie pod rządami Khmerów zginęły nawet 2 mln ludzi.

Historyczne treści AI zalewają internet, muzea i edukację

Dziś manipulowanie zdjęciami i filmami jest łatwiejsze niż w 2021 r., a to za sprawą rozwoju modeli multimodalnych. Pozwalają wytwarzać i przekształcać materiały wizualne ze wsparciem i „rozumieniem” dużych modeli językowych.

Ponadto publikowanie takich treści jest premiowane przez algorytmy social mediów – przykładem obrazy „krewetkowego Jezusa”, napędzające ruch na spamerskich i złodziejskich profilach na Facebooku już w 2024 r.

W zeszłym roku analizowałem dynamikę publikacji i przyrost liczby oglądających jednego z nowych polskich kanałów historycznych na YouTubie, który zawiera wyłącznie filmy generowane w AI (teksty, lektora i ilustracje). Kanał publikował średnio 43 krótkie filmy miesięcznie. W ciągu ledwie siedmiu miesięcy zebrał prawie jedną trzecią liczby wyświetleń, którą przez długie 16 lat zbierał profesjonalny profil Muzeum Historii Polski.

Dostęp do narzędzi „ożywiających” czy generujących zdjęcia, ale też – nie miejmy złudzeń – społeczne zapotrzebowanie na nie sprawia, że trafiają one również do muzeów i instytucji edukacyjnych. Rok temu kontrolerzy NIK zwracali uwagę na nieprawidłowości w projekcie Biura Nowych Technologii IPN, polegające na stworzeniu w celach edukacyjnych „cyfrowych odpowiedników postaci historycznych”, czyli dwóch polskich oficerów i niedźwiedzia Wojtka z armii Andersa. Miały wchodzić w interakcję z odbiorcami.

„AI slop” w historii: cyfrowe popłuczyny czy nowe dziedzictwo

Historyczne produkcje AI mają w sobie coś niepokojącego. Choć czasem mozolnie dopracowane, rażą niedoskonałością, ujawniającą się w szczegółach, radykalnej dosłowności, zbyt generycznym stylu. To mimo wszystko wciąż „AI slop”: cyfrowe popłuczyny po ludzkiej twórczości, przemielonej przez sztuczną inteligencję z całym bagażem jej uproszczeń, formatowania i stronniczości.

Dodatkowo „historyczny slop” zawiera – nie zawsze łatwo wykrywalne – błędy, ahistoryczności, fałszerstwa na poziomie szczegółów (twarzy, munduru, sceny). Gdy na popularnym na Facebooku filmie, pokazującym ewolucję uzbrojenia polskiego żołnierza, widzimy powstańca warszawskiego z twarzą Roberta Lewandowskiego, jest jasne, co to. Nie tak oczywiste są szczegóły generowanych w AI polskich mundurów na okładce jednej z najnowszych książek w poczytnej serii „Żółty tygrys” wydawnictwa Bellona.

Bo „historyczny slop” jest dziś obecny i w obiegu książkowym, i w edukacji, i w działaniach wielu instytucji. Staje się przez to częścią dziedzictwa: trafia do bibliotek, archiwów tych instytucji, które korzystają z AI do tworzenia własnych zasobów (np. edukacyjnych), ostatecznie także do archiwów Webu, zabezpieczających zasoby internetu.

Już dwa lata temu Australijskie Archiwum Webu, prowadzone tam przez Bibliotekę Narodową, informowało o generowanych maszynowo tekstach, a nawet całych witrynach, które znajdowały się w jego zbiorach. Archiwum to, które buduje zasoby webowe od połowy lat 90. XX w., uznaje treści AI obecne online za warte zachowania – jako świadectwo stanu współczesnego internetu.

Czy sztuczna inteligencja zatruwa internet jak azbest?

Australijskie archiwum zwracało przy tym uwagę na wysokie koszty opracowania i przechowywania takich treści – w sytuacji, gdy jest ich coraz więcej i coraz łatwiej je wytwarzać.

Z takim zalewem nie radzą sobie również internetowe wyszukiwarki. Google traktuje wytwory AI na równi z treściami pochodzenia ludzkiego. Alternatywna wyszukiwarka DuckDuckGo pracuje wprawdzie nad filtrami AI, są one jednak niedoskonałe (źródła „AI slopu” blokowane są tam na podstawie ręcznie tworzonych indeksów).

„Sztuczna inteligencja jest jak azbest, którym wypełniamy ściany naszego społeczeństwa, a nasze dzieci i wnuki będą go potem usuwać przez całe pokolenia” – pisał na blogu Cory Doctorow, kanadyjski twórca fantastyki i krytyk technologii.

Choć użyteczna w wielu zastosowaniach, AI staje się problemem cywilizacyjnym właśnie ze względu na brak skutecznych metod rozróżniania, co jest jej wytworem, a co nadal efektem ludzkiej pracy i autentyczną kulturą.

Być może jednak tak radykalne rozgraniczenia nie mają sensu? Przecież w kinie od dawna stosuje się cyfrowe efekty specjalne (także w filmach dokumentalnych). Wikipedia zaś, choć dziś stara się blokować wpływ AI na treść haseł, od dawna pozwala robić to autoryzowanym botom, rozwijanym w ramach społeczności. Tylko w anglojęzycznej wersji Wikipedii działa dziś ich ponad dwa tysiące.

AI jako narzędzie fałszerzy: nowy problem dla historii i archiwów

AI nie tworzy problemu fałszerstw źródeł historycznych – te mają długą tradycję, czego przykładem może być działalność, którą prowadził Jerónimo de la Higuera, XVI-wieczny hiszpański humanista.

– Był on orędownikiem polityki, jaką Hiszpania prowadziła w swoim Złotym Wieku. Fałszował źródła, aby dowieść, że np. chrześcijaństwo dotarło na Półwysep Iberyjski wcześniej niż do Grecji i działali tu apostołowie – mówi Wiktor Werner.

– Higuera zadawał sobie olbrzymi trud: na ołowianych tabliczkach rył znaki, które uznawał za litery greckie z I wieku, zakopywał je, chodził po tawernach i rozpowiadał, że w tym i tym miejscu coś takiego można znaleźć. Tak chciał budować wielkość historii Hiszpanii – opowiada prof. Werner. – Dziś manipulacje przy pomocy AI są nieporównywalnie łatwiejsze. Niekoniecznie skuteczniejsze, ale łatwiejsze, a tym samym mogą stać się znacznie bardziej powszechną praktyką niż kiedykolwiek wcześniej.

Niektórzy uważają, że historia jest dziś bardziej zagrożona przez manipulacje AI niż bieżąca polityka.

W 2024 r. Jacob N. Shapiro i Chris Mattmann przekonywali na łamach dziennika „New York Times”, że nowo wytwarzane treści mogą być zabezpieczane przez wbudowane systemy znaków wodnych, natomiast skany starych dokumentów i zdjęć już nie.

„Gdy takie znakowanie stanie się powszechne, a ludzie przestaną ufać treściom pozbawionym takich oznaczeń, wszystko, co powstało wcześniej, może być znacznie łatwiej podważane” – pisali. Stworzy to też ogromne możliwości wspierania fałszywych twierdzeń fałszywymi (generowanymi) dokumentami: od zdjęć (np. historyczne postacie w kompromitujących sytuacjach), przez zmienianie archiwalnych wydań gazet, aż po podmienianie nazwisk w aktach własności.

Shapiro i Mattmann przyznawali, że techniki fałszowania źródeł historycznych stosowano już wcześniej. Jednak, przekonują, dziś „zwalczanie jest znacznie trudniejsze, gdy koszt tworzenia niemal doskonałych fałszerstw radykalnie spada”.

Co AI naprawdę wie o historii. I dlaczego wciąż się myli

Dodajmy do tego manipulacje faktami i językiem opisu wydarzeń i procesów historycznych, które stanowią nieodzowną część treści generowanych przez AI.

W 2025 r. austriacki ośrodek Complexity Science Hub postanowił sprawdzić „wiedzę” popularnych modeli językowych na temat historii i umiejętność opisywania przez nie tematów historycznych. Co ustalono?

„Modele LLM [zaawansowane systemy, trenowane na wielkich zbiorach tekstów – red.], choć imponujące, nadal nie mają głębi rozumienia wymaganej do zaawansowanej historii” – pisała prof. Maria del Rio-Chanona, współautorka badania. Okazało się, że są one skuteczne w zakresie podstawowych faktów, ale gdy idzie o dociekania zniuansowane, nie da się ich wykorzystać.

Najlepiej wypadający w tym badaniu model AI osiągnął tylko 46 proc. poprawności – podczas gdy w losowym zgadywaniu poprawność wynosiła 25 procent.

Bot z głosem zmarłej matki

PUBLIKOWANE na Facebooku animacje szarżujących husarzy, kolorowane zdjęcia powstańców warszawskich i powojennych partyzantów, Piłsudski „rozmawiający” z Dmowskim w wywiadzie wygenerowanym przez tygodnik „Polityka” (sic!) – to tylko jedna strona zjawiska. Druga ma charakter intymny: jest związana z upamiętnianiem naszych zmarłych. Przybiera formę kolorowanych zdjęć, animacji z fotografii, a nawet cyfrowych awatarów zdolnych do rozmowy.

– To, co obiecują technologie, to najstarsze marzenie ludzkości, czyli pokonanie śmierci – uważa kulturoznawczyni Anja Franczak. – W całej historii ludzkości spotykamy się z tym marzeniem w różnych formach. Jest wiele narracji o tym, że po kimś został tak ogromny ślad, iż w tym swoim dziedzictwie ta osoba nie umiera.

ANJA FRANCZAK przypomina, że gdy kiedyś upowszechniała się fotografia, również toczyły się dyskusje o utrwalaniu wizerunków zmarłych. Oraz że wiele osób po stracie stara się utrzymywać więź ze zmarłym, np. wystawiając zdjęcia w domu, a nawet wewnętrznie z nim rozmawiając. To zatem nic nowego, że szukamy takiego kontaktu również za pomocą sztucznej inteligencji.

DAVID SYPNIEWSKI z AI Open Lab Uniwersytetu SWPS jest autorem bota żałobnego (grief bot), upamiętniającego zmarłą matkę Nataszę. Zanim głos jego mamy dotarł do uszu widowni (inicjatywa miała wymiar sceniczny), autor opracował oryginalne nagrania (bot mówi głosem Nataszy) i zestaw poleceń dla bota, określających jego zachowanie. Są wśród nich: „odpowiadaj konkretnie”, „styl: chłodny, nieco oschły, zdystansowany”, „nie tłumacz się, nie praw kazań”.

Szokujące? Jak mówi Franczak, jedynym ekspertem od żałoby jest ta osoba, która jest w żałobie.

MW

„Tygodnik Powszechny” – jedyny polski tygodnik społeczno-kulturalny.

30 tys. Czytelniczek i Czytelników. Najlepsze Autorki i najlepsi Autorzy.

Wspólnota, która myśli samodzielnie.