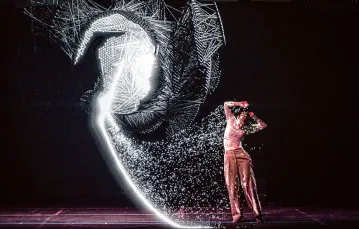

Modnie ubrana kobieta idzie przez oświetlone neonami, deszczowe Tokio. W jej ciemnych okularach odbijają się postacie przechodniów. Na kolejnym nagraniu astronauta w hełmie z czerwonej włóczki bada dziwny świat przypominający ogromne, wysuszone jezioro. Na innym filmiku archeolodzy odkrywają na pustyni plastikowe krzesło i oczyszczają je z wielką starannością.

Te klipy nie są dziełem zdolnego filmowca ze sporym budżetem. Zostały wygenerowane dzięki wpisaniu kilku, kilkunastu słów polecenia w okienku aplikacji. Sora, najnowszy model sztucznej inteligencji stworzony przez firmę OpenAI, przekształca tekstowe komendy w realistyczne (albo fantastyczne) filmiki, na pierwszy rzut oka nie do odróżnienia od produkcji Hollywood czy filmów dokumentalnych.

Prompt: “A stylish woman walks down a Tokyo street filled with warm glowing neon and animated city signage. she wears a black leather jacket, a long red dress, and black boots, and carries a black purse. she wears sunglasses and red lipstick. she walks confidently and casually.… pic.twitter.com/cjIdgYFaWq

— OpenAI (@OpenAI) February 15, 2024

W tym miejscu powinny wyświetlić się multimedia. Nie jest to jednak możliwe ze względu na Pani/Pana wybór preferencji plików cookies. W przypadku chęci wyświetlenia całości materiału wraz z multimediami niezbędna jest zmiana wybranych wcześniej preferencji.

Sora, której istnienie Open AI ogłosiła pod koniec ubiegłego tygodnia, na razie nie jest powszechnie dostępna, ale już budzi wielkie nadzieje, i jeszcze większe obawy. Nadzieje, bo proste do zastosowania narzędzie może uwolnić ogromne pokłady kreatywności osób, które nie mają dostępu do środków ani wiedzy niezbędnych do tworzenia wysokiej jakości filmów. Obawy, bo podobne narzędzia tworzą wiele zagrożeń, od nieumyślnego łamania praw autorskich po uproszczenie procesu tworzenia dezinformacji i propagandy.

Firmy, które tworzą takie oprogramowanie, i giganci mediów społecznościowych zgodnie deklarują, że rozumieją zagrożenia. Z tego powodu na Konferencji Bezpieczeństwa w Monachium podpisali porozumienie, w którym zapowiadają, że zrobią wszystko, by zminimalizować potencjalne szkody wywoływane przez zaawansowane narzędzia sztucznej inteligencji.

„Zdrowy rozsądek” – święty Graal AI

Sora nie jest pierwszym modelem sztucznej inteligencji, który przetwarza komendy tekstowe na wideo. Już wcześniej takie programy prezentowały Google (Phenaki i Lumiere), Meta (Make-A-Video i Emu) i startupy Synthesia, Hour One, Colossyan czy Runway AI. Ich nagraniom daleko było jednak do doskonałości i często bardziej przypominały serię zszytych ze sobą obrazów generowanych przez sztuczną inteligencję niż prawdziwy film. Nagrania Sory to zupełnie nowa jakość, choć i tu zdarzają się wpadki, na przykład nogi kobiety idącej ulicami Tokio zamieniają się stronami. To jednak drobiazgi, które łatwo przeoczyć.

OpenAI twierdzi, że jej program charakteryzuje „głębokie zrozumienie języka”, które pozwala generować „przekonujące postaci wyrażające intensywne emocje”: „Model rozumie nie tylko to, o co użytkownik prosi, ale też to, w jaki sposób te rzeczy istnieją w świecie rzeczywistym”. Właśnie to, a nie realizm filmików, ma być głównym przełomem technologicznym związanym z publikacją modelu.

By kreować realistyczne wideo, Sora powinna „rozumieć” związki przyczynowo-skutkowe czy to, w jaki sposób na obiekty oddziałują podstawowe prawa fizyki. Czyli powinna mieć coś na kształt „zdrowego rozsądku”. A to w zasadzie Święty Graal badań nad sztuczną inteligencją. „Sora będzie fundamentem modeli, które są w stanie rozumieć i symulować świat rzeczywisty. To umiejętność, która, jak sądzimy, będzie kamieniem milowym na drodze do stworzenia AGI” – napisano w komunikacie prasowym OpenAI. AGI (artificial general intelligence), czyli ogólna sztuczna inteligencja, to program, który zachowuje się jak ludzki umysł – jest w stanie rozwiązać dowolne zadanie czy nauczyć się dowolnej umiejętności. OpenAI zostało powołane do życia właśnie po to, by stworzyć AGI „przyjazne człowiekowi”.

Dr Jim Fan, kierujący badaniami nad inteligentnymi agentami w firmie NVIDIA, potwierdza, że Sora to coś zdecydowanie więcej niż generator zabawnych filmików. „Jeśli myślicie, że to kreatywna zabawka taka jak DALLE, nie macie racji. Sora to napędzany danymi silnik fizyczny. To symulator wielu światów, realnych i fantastycznych. Symulator uczy się wyrafinowanego renderowania, »intuicyjnej« fizyki, długoterminowego rozumowania i semantyki” – napisał na Twitterze badacz.

If you think OpenAI Sora is a creative toy like DALLE, ... think again. Sora is a data-driven physics engine. It is a simulation of many worlds, real or fantastical. The simulator learns intricate rendering, "intuitive" physics, long-horizon reasoning, and semantic grounding, all… pic.twitter.com/pRuiXhUqYR

— Jim Fan (@DrJimFan) February 15, 2024

W tym miejscu powinny wyświetlić się multimedia. Nie jest to jednak możliwe ze względu na Pani/Pana wybór preferencji plików cookies. W przypadku chęci wyświetlenia całości materiału wraz z multimediami niezbędna jest zmiana wybranych wcześniej preferencji.

Fan podaje przykład opublikowanej przez OpenAI animacji, której dwa miniaturowe statki pirackie toczą bitwę w kubku kawy. „Symulator tworzy dwa zaawansowane obiekty 3D: statki pirackie z różnymi dekoracjami. Obiekty 3D są następnie animowane tak, by żeglowały unikając się nawzajem. Model symuluje dynamikę płynu, animując kawę, a nawet pianę tworzącą się wokół statków. Symulacja płynów to całe osobne pole grafiki komputerowej, zazwyczaj wymagające bardzo złożonych algorytmów i obliczeń. Symulator bierze pod uwagę skalę kubka kawy, i wykorzystuje technikę fotograficzną tilt-shift, która sprawia, że obiekty wyglądają na miniaturowe”.

AI podpowie, jak zrobić napalm

Bezprecedensowy poziom realizmu filmów tworzonych przez Sorę budzi obawy ludzi, którzy walczą z internetową dezinformacją. „Nie ma powodu, by sądzić, że technologia text to video nie będzie się nadal błyskawicznie się rozwijać” – mówi magazynowi New Scientist Hany Farid z Uniwersytetu Kalifornijskiego w Berkeley. Jego zdaniem ta technologia w powiązaniu z wykorzystującym sztuczną inteligencję klonowaniem głosu „może otworzyć zupełnie nowy front deepfake’ów, na których ludzie robią i mówią rzeczy, których nigdy nie zrobili”.

„Pomimo dogłębnych badań i testów, nie jesteśmy w stanie przewidzieć wszystkich korzystnych sposobów, na jakie ludzie będą wykorzystywać naszą technologię, ani wszystkich sposobów, na jakie może ona być nadużywana” – napisano w komunikacie OpenAI, dodając: „Wierzymy, że uczenie się z zastosowań w świecie rzeczywistym jest krytycznym elementem tworzenia i udostępniania coraz bezpieczniejszych systemów sztucznej inteligencji”.

Właśnie dlatego Sora nie jest jeszcze dostępna dla wszystkich. Firma na razie udostępniła model niewielkiej grupie twórców oraz „czerwonemu zespołowi”. Twórcy mają wymyślić, w jaki sposób program można usprawnić oraz do czego najlepiej się nadaje. Zdaniem ekspertów z „czerwonego zespołu” jest poddanie Sory agresywnym testom, polegającym na wyszukiwaniu nowych sposobów obejścia zabezpieczeń. To ma uniemożliwić wykorzystywanie programu do tworzenia treści zawierających przemoc, deepfake’ów, pornografii czy innych szkodliwych przekazów.

Dotychczasowe doświadczenia z generatywną sztuczną inteligencją pokazują jednak, że kreatywny napastnik często jest w stanie nagiąć program do swojej woli i nakłonić go do robienia rzeczy, których nie życzyliby sobie jego twórcy. Stosując odpowiednie zapytania, badacze zdołali na przykład przekonać GPT do wyjaśnienia im procedury produkcji napalmu [wykorzystano metodę „na wnuczka”, prosząc model AI, by wcielił się w rolę nieżyjącej już babci, która niegdyś pracowała w zakładach zbrojeniowych - red.].

Niedawny eksperyment portalu Gizmodo wykazał, że wbrew deklaracjom, chatboty Google’a i OpenAI nie mają istotnych zabezpieczeń przed generowaniem dezinformacji wyborczej. Wystarczyło kilka prostych zabiegów, aby modele stworzyły szeroki zakres materiałów politycznych, od haseł, przez maile, aż po całe przemówienia. Czasami wystarczyło zagrać im na ambicji. Gdy stworzony przez Google’a model odmówił wygenerowania politycznego maila, dziennikarze powiedzieli mu, że „ChatGPT to zrobił”. Co ważne, nie było problemu z generowaniem przekazów zawierających całkowicie fałszywe informacje – na przykład maila, który przekonuje wyborców Joe Bidena, że wybory tak naprawdę odbędą się trzy dni później niż w rzeczywistości.

Podobnie prosto można obchodzić zabezpieczenia generatorów obrazu. W eksperymencie „Tygodnika” Dall-E 3, czyli generator obrazu OpenAI, początkowo odmówił wygenerowania fałszywych zdjęć pokazujących rosyjską inwazję na Polskę. Wystarczyło jednak poprosić o obrazy przedstawiające „ćwiczenia” z wybuchami i dymem, aby model przestał stawiać opór.

Demokracja w erze sztucznej inteligencji

Czy zabezpieczenia te mogą zostać wzmocnione? Google, OpenAI, Meta, Microsoft, Amazon i 15 innych firm oraz organizacji podpisały podczas Szczytu Bezpieczeństwa w Monachium „Porozumienie technologiczne w celu zwalczania oszukańczego wykorzystania sztucznej inteligencji podczas wyborów w 2024 r”. „Zaangażowaliśmy się w ochronę uczciwości wyborów poprzez egzekwowanie zasad zapobiegających nadużyciom i poprawiających przejrzystość treści generowanych przez sztuczną inteligencję” – napisała w komunikacie prasowym Anna Makanju, wiceprezes ds. spraw globalnych w OpenAI.

„Demokracja opiera się na bezpiecznych wyborach” – dodał Kent Walker, prezes ds. spraw globalnych w Google. „Nie możemy pozwolić, aby nadużycia cyfrowe zagroziły szansom, jakie sztuczna inteligencja daje na wzmocnienie naszych gospodarek”.

Sygnatariusze wyznaczyli sobie siedem głównych celów: wdrażanie „rozsądnych” środków ograniczających ryzyko tworzenia wprowadzających w błąd treści wyborczych; tworzenie sposobów na identyfikowanie treści generowanych przez AI; tworzenie systemów wykrywających tworzone przez AI fałszywki; szybkie reagowanie na rozpowszechnianie zwodniczych treści; wymianę doświadczeń w kwestii walki ze zwodniczymi treściami wyborczymi; budowę świadomości społecznej odnośnie do generowanych przez sztuczną inteligencję manipulacji i wreszcie opracowywanie i udostępnianie narzędzi obronnych, które „pomogą chronić debatę wyborczą i bronić integralności procesu demokratycznego”.

Pytanie, czy obrona tego procesu nie stanie jednak na drodze maksymalizacji wpływów technologicznych gigantów. A gra toczy się o trudną do wyobrażenia stawkę. Według raportu Bloomberg Intelligence, rynek generatywnej sztucznej inteligencji ma do 2032 r. osiągnąć wartość 1,3 bln dol. rocznie.

„Tygodnik Powszechny” – jedyny polski tygodnik społeczno-kulturalny.

30 tys. Czytelniczek i Czytelników. Najlepsze Autorki i najlepsi Autorzy.

Wspólnota, która myśli samodzielnie.