49-letnią Elaine Herzberg przejechało w Phoenix autonomiczne auto. Wyposażone w laserowe czujniki, powinno ją było zauważyć także w ciemności. Nawet nie hamowało.

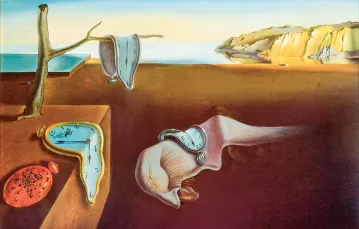

Choćby najlepiej wyszkolona sztuczna inteligencja zawiadująca pojazdem nie zawsze będzie w stanie uniknąć skrzywdzenia ludzi. Dlatego inżynierowie postanowili wpoić jej podstawy etyki. I tu zaczęły się problemy. Bo czy my sami rozumiemy własne zasady?

W 2016 r. zespół z MIT stworzył test „The Moral Machine”, który miał ustalić, czym naszym zdaniem powinny kierować się roboty. Rozwiązały go 4 mln ludzi. Naukowcy właśnie przedstawili wyniki.

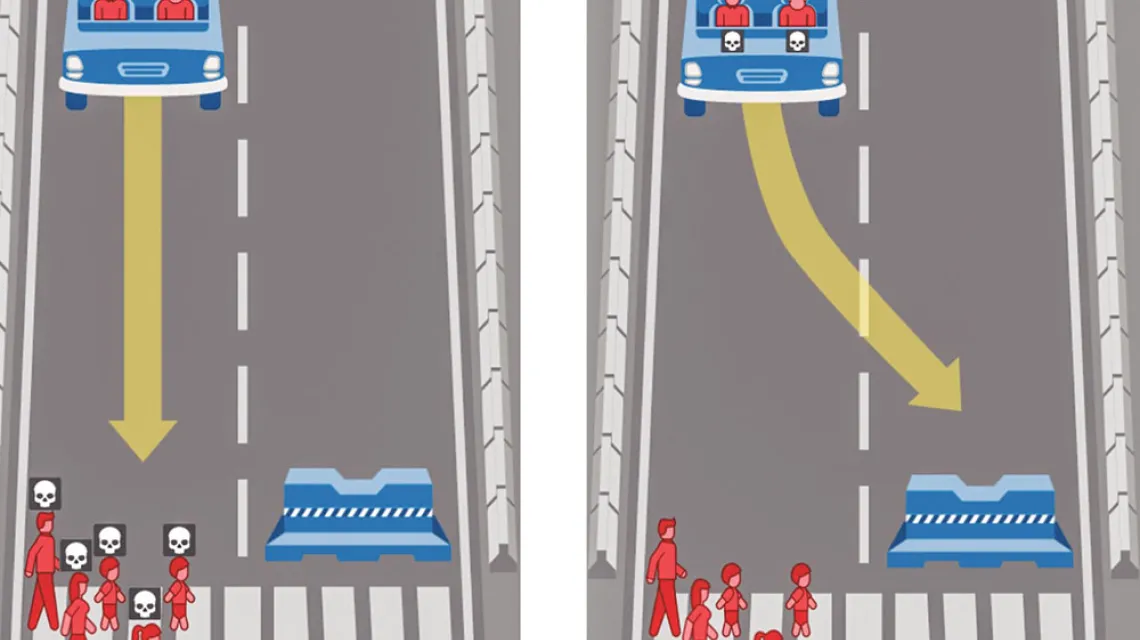

Mając wybór między dzieckiem a dorosłym w przytłaczającej większości pozwolimy skrzywdzić dorosłego. Dorosły albo emeryt? Prawie zawsze każemy zabić emeryta. Ponad 40 proc. ankietowanych wolało, żeby samochód wjechał w przechodniów niż żeby krzywda stała się pasażerom. Przy wyborze między zabiciem jednej osoby przechodzącej na zielonym, a dwiema na czerwonym, głosy rozłożyły się niemal po równo.

Czy naprawdę chcemy, żeby takie zasady były twardo zapisane nie w prawie, lecz w kodzie? Nie będziemy mieli wyjścia. Autonomiczne auta nie posługują się uczuciami, lecz surową punktacją: mają minimalizować straty.

Ludzcy kierowcy zabijają co roku 270 tysięcy pieszych. Autonomiczne auta z założenia mają być bez porównania bezpieczniejsze, ale nawet ograniczenie tej liczby o 99 proc. oznacza, że zabiją one tysiące przechodniów. Ofiar będzie o wiele mniej niż dziś, gdy krzywdzimy się sami, ale i tak trudno będzie znieść fakt, że samochód zabija: na zimno, według algorytmu. I tak, jak według tego algorytmu jest dla nas wszystkich lepiej. ©

„Tygodnik Powszechny” – jedyny polski tygodnik społeczno-kulturalny.

30 tys. Czytelniczek i Czytelników. Najlepsze Autorki i najlepsi Autorzy.

Wspólnota, która myśli samodzielnie.