Ewolucja: czy zawsze prowadzi do wzrostu złożoności?

Nie. Na podstawowym poziomie istnienie ewolucji oznacza tylko tyle, że populacje organizmów mają zdolność przystosowywania się do środowiska. Gdy zrobi się zimniej, przetrwają te odporniejsze na zimno; gdy pojawi się pokarm wymagający rozgryzienia, przetrwają te o mocniejszych szczękach. Gdy nic się nie zmieni, populacja też się raczej nie zmieni. A gdy warunki będą sprzyjać uproszczeniu anatomii, prędzej czy później do tego dojdzie.

W zasadzie nie ma więc żadnego dobrego powodu, dla którego ewolucja nie zatrzymała się na etapie bakteryjnego śluzu. Tak zresztą przez około dwa miliardy lat wyglądała cała biosfera Ziemi. Dlaczego więc ostatecznie powstały potężne sekwoje, delikatne meduzy, wielkookie lorisy i pół miliona gatunków chrząszczy?

Jedyna szczera odpowiedź brzmi: nie wiadomo. Prawdopodobnie ma to coś wspólnego z wielkimi przemianami środowiska: zderzaniem się i rozrywaniem kontynentów, epokami lodowcowymi, gigantycznymi epizodami wulkanicznymi. Ma też coś tu do gadania konkurencja międzygatunkowa: ta sama siła, która sprawia, że odpowiedzią na oszczep jest tarcza, na tarczę miecz, na miecz kolczuga… a na wóz opancerzony – amunicja przeciwpancerna. Kto stoi w miejscu, ten się cofa.

Prawdę jednak mówiąc, gdyby jutro została odkryta planeta, na której po 4 miliardach lat życia wciąż istnieje tylko jednokomórkowy śluz, nie byłoby to sprzeczne z żadną fundamentalną zasadą biologii, chemii czy fizyki. Może tylko z głębszą, metafizyczną zasadą, że świat szybko się nudzi?

Emergencja: rzeczywiste zjawisko czy uczona nazwa na „coś ciekawego”?

W drugiej połowie XIX w. zaczęła do nas docierać pewna niezwykła cecha wszechświata. Otóż wszystkie jego złożone zjawiska przyrodnicze – wszystkie! – wyłoniły się z czegoś prostszego.

To dziwne. Pomyślmy choćby o powstaniu życia z materii nieożywionej. Coś nieżywego, co daje życie, ma na pozór tyleż sensu, co bankrut pożyczający stówę albo malarz, który potrafi z białej i czarnej farby uzyskać nagle barwę czerwoną.

Jak więc materia wyłoniła się z niematerii? Życie z nieżycia? Umysł z nieumysłu? Na początku XX w. przyjęło się nazywać tego typu szczególnie spektakularne przypadki słowem emergencja. Nad pojęciem tym od początku unosi się duch metafizycznej kontrowersji. Czy „zjawiska emergentne” to po prostu to wszystko, co nas zaskakuje, dziwi, czego nie umiemy wytłumaczyć? Większość definicji emergencji, którą wtedy określa się jako „emergencję słabą”, opowiada się właśnie po tej bezpiecznej stronie: świat ewoluuje w sposób ciągły, a jego zdolność do samoorganizacji czasem po prostu powala nas na kolana.

A może jednak świat ma zdolność wyłaniania w sobie zupełnie nowego rodzaju porządku, nawet tak spektakularnego, jak niematerialny porządek duchowy wyłaniający się z materialnej rzeczywistości mózgu? Od przeszło stu lat trwają nieustające poszukiwania czegoś takiego, co już tym razem na pewno nie może być po prostu sumą swoich części: czegoś, co nie jest tylko sprytniejszym układem już istniejących klocków, ale czymś autentycznie nowym we wszechświecie. Dopiero to byłaby „silna emergencja”.

Termodynamika: dlaczego nauka o silnikach parowych stała się tak ważna?

Niektóre pojęcia termodynamiki dość naturalnie stosują się do całego świata. Ot, „ciepło” albo nieco bardziej swojska „temperatura”. Każdy kąsek materii w kosmosie ma jakąś temperaturę: łatwo więc zrozumieć, że nauka opracowana z myślą o rozgrzewających się do czerwoności kotłach parowych pomoże nam też zrozumieć hawajską lawę i kosmiczną plazmę.

Dużo mniej oczywiste jest to, że słup magmy wykonuje „pracę” na skorupie ziemskiej. A jednak – i nie jest to tylko matematyczną ciekawostką, ale częścią języka, którym geofizycy opisują dziś ewolucję naszej planety. Skoro już jakiś „tłok” napiera w określonym kierunku, przemieszczając pewną masę, to możemy podciągnąć to zjawisko pod ogólniejszy opis przepływów energii i masy, posługując się przy tym językiem, który po niedługim czasie przestaje się w ogóle kojarzyć z XIX-wieczną angielską fabryką śrubek.

Hitem okazały się jednak te wszystkie „entalpie”, „energie swobodne” i „entropie”, które wiążą przepływy energii z przepływami informacji (zob. „Informacja: czy świat składa się raczej z informacji niż z materii?”). Do dzisiaj kolejne pokolenia młodych chemików drapią się po głowie, próbując zrozumieć, jakim cudem na przebieg jakiejś reakcji chemicznej ma wpływ liczba sposobów, na jakie może zachowywać się produkt tej reakcji! Przecież to jest jakieś szaleństwo. Tak jednak definiuje się dziś „entropię konfiguracyjną”, z której korzystamy przy obliczaniu tempa zachodzenia reakcji. To jeden z powodów, dla których fizycy coraz częściej sięgają do pojęcia informacji, gdy mowa o podstawowych elementach rzeczywistości.

Samoorganizacja: czy świat umie nauczyć sam siebie nowej sztuczki?

Dość łatwo jest sobie wyobrazić zewnętrzną, odgórną siłę organizującą. Ot, generał rozstawiający oddziały zgodnie z ordre de bataille, burza miotająca liśćmi, procesor sterujący elektronami. Czy jednak armia, liście i elektrony same w sobie byłyby w stanie dogadać się i wykonać piękny, harmonijny taniec? Wygląda na to, że tak, owszem, czasem.

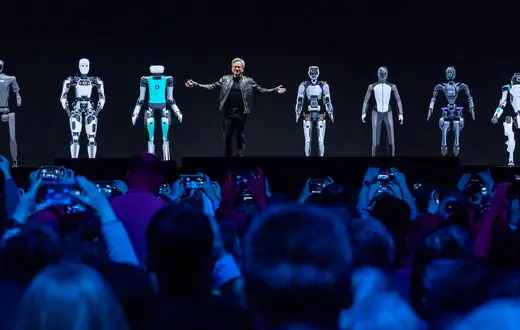

Nauka o samoorganizacji zajmuje się przypadkami, gdy jakiś system nie jest wyposażony w centralną jednostkę sterującą, a jednak zachowuje się w sposób globalnie uporządkowany. Czasem wyłania się w nim tak elegancki porządek, że wydaje się on wymagać jednej ręki sterującej. Maskotką teorii samoorganizacji jest klucz ptaków, w którym nie ma ptasiego generała, a tylko grupa całkowicie równorzędnych sobie ptaków organizujących się jednak spontanicznie w regularną formę klucza. Samoorganizują się też kryształy, prądy oceaniczne, no i oczywiście niezliczone inne istoty żywe, z których szczególnie spektakularnie robią to mrówki czy termity.

Wiele zjawisk społecznych powstaje właśnie w ten sposób. Koncerty i mecze potrafią aż tętnić od wspaniałych form samoorganizacji, ale nawet potężne ruchy społeczne i polityczne, którym lubimy przypisywać „założycieli”, w istocie wyłoniły się z potrzeby miliona serc. Serio, czy ktoś tak naprawdę wymyślił socjalizm?

Przedrostek „samo-” jest tym bardziej oczywisty, im prostsze rozważamy układy. Nikt chyba nie przypuszcza, że pierwsza komórka żywa została zorganizowana zgodnie z planem? Świat w zasadzie nie robi nic innego, jak tylko się samoorganizuje. „Cudzoorganizacja” to rzadki, wątpliwy wyjątek, a rola jednostki w dziejach jest niemal zawsze przesadzona.

Chaos: czy największa złożoność rodzi się na „ostrzu chaosu”?

To doświadczenie, które każdy z nas może wykonać w zaciszu swojego domu. Powolutku, bardzo ostrożnie, odkręcamy kran. Najpierw będzie regularnie kapać: kap… kap… kap… Chwilę później będzie ciec prawie jednolitym strumieniem: szzzzzzz… Pomiędzy tymi dwoma stanami czyha jednak „reżim chaotyczny”. Czasem trzeba sporo cierpliwości i ręki kasiarza, ale warto poświęcić chwilę i go upolować, ponieważ są to wrota do jednej z największych tajemnic rzeczywistości. Kap… kap kap… szzzzkap… kap... kap kap… kap… kapkap… szzzzkap… szzzzzzkap… kap…

Chociaż fizycy badają układ cieknącego kranu od ok. 50 lat, wciąż da się na nim ugrać doktorat. Jest to bowiem jeden z najbardziej dostępnych przykładów na układ chaotyczny: taki, którego historia szybko staje się nieprzewidywalna, i którą można całkowicie odmienić poprzez najdrobniejsze zaburzenie. Najpotężniejsze superkomputery świata nie są w stanie przewidzieć, co zrobi twój kran za minutę. Serio.

Charakterystyczne dla wielu układów chaotycznych jest to, że odnajdujemy je w wąskim przedziale parametrów – czasem tak ulotnym, jak ułamek milimetra w położeniu kurka z wodą – oddzielającym jedną nudę (regularność) od drugiej nudy (szum). Wciąż nie jest jasne, na ile teoria matematyczna chaosu stosuje się do życia codziennego. „Ostrze chaosu” brzmi jednak znajomo. Z jednej strony spokojny, nudny dzień: słonko spokojnie świeci, cicho brzęczą muchy. Z drugiej pełen chaos: rano przypalona jajecznica, o południu pękająca rura, a wieczorem pijani goście. Pytanie: w który z tych dni wpadniemy na świetny pomysł? Odpowiedź: w żaden. Kurek bodźców musi zostać ustawiony w idealnej pozycji: tak, aby chaos nas uskrzydlał.

Miary złożoności: jak porównać poziom złożoności mózgu i klimatu?

Na pierwszy rzut oka słowo „złożony” wydaje się mniej więcej tak precyzyjne, jak słowo „fajny”. Gdy stwierdzam, że jakiś tekst albo jakieś zjawisko są „złożone”, to brzmi jak opinia, a nie stwierdzenie faktu. A jednak – niektórzy naukowcy uważają, że złożoność można mierzyć równie dobrze, co masę, ładunek elektryczny, lepkość albo liczbę kończyn.

Pradziadkiem wszystkich miar złożoności jest „złożoność algorytmiczna” opisana w 1963 r. przez radzieckiego matematyka Andrieja Kołmogorowa. Miarą Kołmogorowa można co prawda mierzyć tylko ciągi znaków, ale prawie wszystko można dzisiaj zamienić na ciąg znaków. Złożoność algorytmiczna danego ciągu to długość najkrótszego algorytmu (w praktyce: programu komputerowego), który jest go w stanie wygenerować. Intuicyjnie: jeżeli coś wymaga dłuższego opisu, jest bardziej złożone.

W 1971 r. inżynier Daniel Minoli opisał miarę „złożoności kombinatorycznej”, którą można zastosować do wszystkiego, co da się przedstawić jako graf – czyli zbiór wierzchołków połączonych krawędziami. Graf niekoniecznie jest bardziej złożony, jeśli ma więcej wierzchołków („obiektów”) – istotna jest liczba krawędzi („relacji”). W następnych dekadach metodę Minolego zastosowano m.in. do mierzenia złożoności reakcji chemicznych, sieci komputerowych i społeczności ludzkich.

Pytanie za sto punktów nie brzmi jednak, jak zmierzyć złożoność, tylko… po co? Nie jest to jeszcze do końca jasne.

Informacja: czy świat składa się raczej z informacji niż z materii?

To problem, który sięga najstraszliwszych głębin metafizyki (pomyślmy choćby o wszystkich tych modelach powstania świata, w których siłą stwarzającą jest Słowo) i najpaskudniejszych odmętów fizyki kwantowej (którą od kilkudziesięciu lat rosnące grono uczonych opisuje jako naukę nie o cząstkach albo polach, lecz o przepływie informacji).

Logika bywa nawet dość przekonująca. Fizycy, przykładowo, zwracają uwagę na to, że wszelkie nasze sposoby oddziaływania ze światem sprowadzają się do zadawania światu pytań („Hej, cząstko, jesteś naładowana elektrycznie?”), na które ten odpowiada („Ano jestem”). Jest to więc w istocie wymiana informacji. Co gorsza, tak samo można opisać również procesy naturalne, w których nie ma udziału umysł człowieka: dwie zderzające się cząstki tak naprawdę dokonują „uaktualnienia swojego stanu”, wymieniając się informacją o swojej masie, pędzie, położeniu czy ładunku.

Fizyk John Wheeler sformułował słynną frazę „it from bit”: „to” (czyli rozmaite rzeczy występujące w świecie) miałoby wyłaniać się z bitów, czyli jednostek informacji. Z tego typu przedefiniowaniem jest oczywiście sporo problemów, z których najpoważniejszy jest taki, że nikt nie wydaje się mieć zielonego pojęcia, czym jest informacja. O ile „materia”, „energia”, a nawet – zaszalejmy – „umysł” budzą w nas przynajmniej jakieś szybkie, niedoskonałe skojarzenia, to „informacja”… nie za bardzo.

System: co ma wspólnego komputer, miasto i komórka żywa?

Słowo „układ” (ang. system) to jedno z pojęć tak ogólnych, że można rozsądnie pytać, czy jest w ogóle sens je definiować. Zdefiniować pojęcie szczegółowe to banał. Ot, „beton”, „wróbel” albo „lager”. Nawet jeżeli akurat nie wiesz, czym się różni lager od ale’a albo wróbel od mazurka, wystarczy się tego dowiedzieć. To konkretne różnice. Co jednak ze słowami typu „sytuacja”, „rzecz” albo „przypadek”? No, śmiało, zdefiniuj mi „rzecz”!

Słowa „układ” i „system” wydają się należeć do tej samej kategorii. Austriacki biolog Ludwig von Bertalanffy (1901-1972) w latach 40. XX wieku opracował „ogólną teorię systemów” – którą jedni komentatorzy uznali za poetycką pseudonaukę, a inni za nową fundamentalną teorię wszystkiego. Von Bertalanffy marzył o nauce, która byłaby w stanie mówić jednym językiem o organizmach żywych, planetach, korporacjach i obwodach elektrycznych. Wszystkie te systemy, pisał, pobierają energię i ją spożytkowują. Wszystkie przetwarzają informacje. Wszystkie są wrażliwe na jedne typy bodźców, a na inne – nie. Wszystkie zawierają podukłady (subsystemy) i harmonijnie nimi sterują.

Dziś można bezpiecznie powiedzieć, że projekt von Bertalanffy’ego nie przyjął się – teoria systemów od 80 lat pozostaje na peryferiach nauki i filozofii, choć w każdym pokoleniu znajduje swoich wielbicieli – ale jego marzenie żyje. Jest zresztą znacznie starsze. Któż by nie chciał znaleźć języka uniwersalnego?

„Tygodnik Powszechny” – jedyny polski tygodnik społeczno-kulturalny.

30 tys. Czytelniczek i Czytelników. Najlepsze Autorki i najlepsi Autorzy.

Wspólnota, która myśli samodzielnie.