Gdyby rok 2025 w AI miał mieć swoje hasło przewodnie, brzmiałoby ono „AI bubble”. Praktycznie każda osoba ze świata biznesu i finansjery mówiła w ostatnich miesiącach o bańce AI-owej. Czysto symbolicznie oznacza to wyjście z etapu fascynacji i wejście w fazę trudnych pytań: czy aby nie przeceniamy AI, w przenośni i dosłownie?

Zacznijmy jednak od pytania, czym jest „bańka AI” tak konkretniej.

Czym jest „bańka AI?”

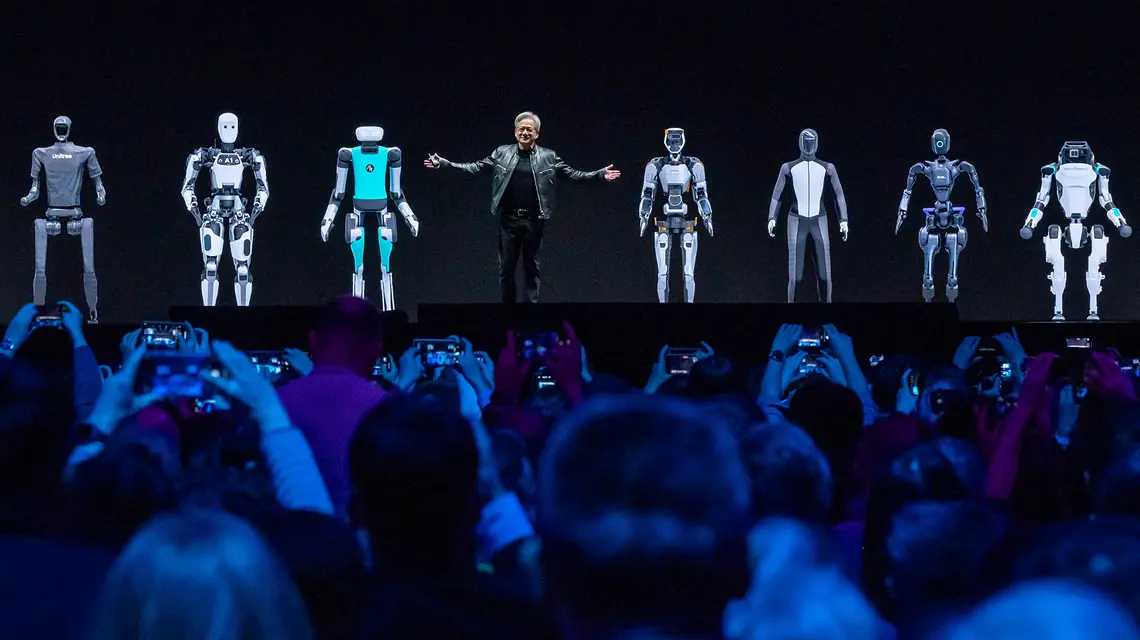

Producenci wiodących modeli (jak OpenAI, xAI czy Anthropic) oraz firmy zapewniające im infrastrukturę sprzętową i software (jak Nvidia, AMD, Oracle czy CoreWeave) przyciągają olbrzymi kapitał i błyskawicznie go inwestują. „The Economist” szacuje, że w 2025 r. amerykańskie firmy wpompowały ponad 400 mld dolarów w sprzęt napędzający sztuczną inteligencję. OpenAI ma obecnie wartość 830 mld dolarów, a holding finansowy HSBC przewiduje, że firma ta zainwestuje w infrastrukturę w latach 2025-2030 dalszy bilion dolarów.

Są z tym sposobem działania przynajmniej dwa problemy. Po pierwsze, za sporą część tych zawrotnych sum odpowiadają „zapętlone” transakcje pomiędzy kilkoma dużymi graczami. Temat zrobił się głośny, gdy Nvidia ogłosiła we wrześniu, że zainwestuje 100 mld dolarów w OpenAI. OpenAI kupuje tymczasem usługi chmurowe od Oracle, które z kolei kupuje chipy od Nvidia.

Tego typu pętelek jest więcej: Nvidia zainwestowała 350 mln w CoreWeave i ma 7 proc. ich udziałów, a CoreWeave zapewnia infrastrukturę obliczeniową OpenAI. Setki miliardów dolarów często wędrują więc w kółko, sztucznie zawyżając wartość spółek. Ekonomiści bardzo takich sytuacji nie lubią.

Po drugie, zwroty z tych szalonych inwestycji pozostają skromne. Choć ChatGPT ma 800 mln użytkowników tygodniowo, wciąż na siebie nie zarabia. „The Information” szacuje, że OpenAI zakończy rok 2025 ze stratą w wysokości ok. 27 mld dolarów. Prywatni użytkownicy nigdy nie przyniosą do stołu setek miliardów. Producenci usilnie próbują więc przekonać wielki biznes – sektor energetyczny i paliwowy, finansowy, hotele, Big Pharmę... – że integracja z AI da im zysk. Jak do tej pory – idzie im słabo.

Jak zarobić na sztucznej inteligencji?

W lipcu ukazał się raport MIT o stanie implementacji AI w biznesie: „The GenAI Divide. State of AI in Business 2025”. Autorzy przeanalizowali wyniki 300 spółek, zebrali 153 ankiety od osób na stanowiskach kierowniczych i przeprowadzili dziesiątki wywiadów. Wnioski? Choć niemal wszyscy eksperymentują z AI, w 95 proc. firm nie przynosi to żadnego wymiernego zysku, w tym ścisłym sensie zwrotu z inwestycji (ROI).

Oto typowy scenariusz: zarząd z dumą ogłasza, że nabył jedno z rozwiązań korporacyjnych i „przestawia firmę na AI”. Pracownicy próbują następnie zintegrować to narzędzie ze swoim zwykłym trybem pracy. Wyniki są mizerne. Ostatecznie AI zostaje oddelegowane do generowania maili i streszczania dokumentów, jednak wszystko to i tak musi później krytycznie czytać człowiek. Pod koniec roku okazuje się, że słupki nie urosły – i po rewolucji.

Autorzy raportu widzą następujące główne problemy: AI nie uczy się, popełnia w kółko te same błędy i na potęgę halucynuje, czyli generuje prawdopodobnie brzmiące, ale fałszywe treści.

Konkluzja: chociaż AI jest wszędzie, to jedynym potwierdzonym skutkiem jego obecności jest okazjonalne zwiększenie wydajności pracy, które nie zawsze daje wymierny zysk. Jedyny sektor rynku, w którym AI wywołało przemianę jakościową, to media. Nie brzmi to jak przemiana cywilizacyjna na skalę science fiction... AI miało być geniuszem o niemal nieograniczonych zdolnościach, a nie programem, który nieznacznie usprawnia pracę biurową!

Dwa powody, dla których rozsądnie jest nie ufać AI

Optymiści twierdzą, że wciąż patrzymy na zalążkowy etap rozwoju tej technologii, a tuż za rogiem jest superinteligentne lub „ogólne” AI (ASI/AGI), które nas zachwyci, zastąpi i/lub zniewoli. Lecz jak na razie nie ma nawet prawdziwie autonomicznych „agentów AI”, którym można zlecić proste zadanie i zaufać, że zostanie ono wykonane.

Istnieją pilotaże tej idei, ale nie produkty o potwierdzonej skuteczności i bezpieczeństwie. A warto przypomnieć, że równo rok temu szefowie OpenAI, Google AI czy Meta AI zgodnie twierdzili, że to 2025 będzie „rokiem agentów”. Nie był. Są też dwa poważne powody, dla których rozsądnie jest nie ufać AI.

Po pierwsze, zmorą są wciąż wspomniane halucynacje – kluczowy nierozwiązany problem dużych modeli językowych (LLM). AI zmyślające wyniki finansowe, akty prawne albo dane klientów to realny problem, którego nie rozwiąże przyrost mocy obliczeniowej, pamięci i ilości danych treningowych.

Jedynym poważnym krokiem naprzód byłaby głęboka zmiana w samym sposobie programowania AI: np. pożenienie obecnych LLM-ów z zasobem uporządkowanej wiedzy o świecie, co wymaga zupełnie innej architektury, tzw. symbolicznego AI. Wszyscy pracują dziś pilnie nad taką hybrydą, określaną zwykle jako „neurosymboliczne AI”, a Amazon nawet pochwalił się w sierpniu, że ich roboty magazynowe Vulcan mają architekturę neurosymboliczną.

Czy sztuczna inteligencja nas szpieguje?

Znacznie większym problemem jest dostęp producentów AI do danych wrażliwych. Można na ślepo założyć, że do ChatGPT regularnie trafiają wyniki finansowe spółek, dane osobowe, projekty ustaw, schematy eksperymentalnych urządzeń, dokumenty sądowe czy nawet plany militarne. Nie ze złej woli! Ot, po prostu, bezmyślnie, bo ktoś chciał wygenerować streszczenie, maila albo prezentację. MIT szacuje, że w ok. 90 proc. firm pracownicy korzystają z prywatnych kont AI w pracy, nawet gdy pracodawca oferuje dostęp do płatnych kont służbowych.

Wszelkie tego typu informacje są niemal na pewno automatycznie analizowane, agregowane i zapisywane. Wiara w etyczność firm typu OpenAI czy Google jest naiwna, a gromadzenie danych to ich cały raison d’être.

W rezultacie Big Tech, a więc i administracja Trumpa oraz każda inna odpowiednio silna instytucja posiada obecnie prawdopodobnie intymny wgląd w funkcjonowanie wszystkich większych instytucji na świecie. Wielką niewiadomą jest tylko pytanie, czy informacje te swobodnie wędrują na linii Chiny–reszta świata.

Europa, dodajmy, jest praktycznie poza tym wyścigiem. Jedyny duży europejski model, Mistral, ma mniej niż 2 proc. udziału w rynku, a wymuszony okolicznościami wzrost nakładu Europy na zbrojenia nie sprzyja inwestowaniu w AI.

Ameryka tymczasem jawnie opiera na AI swoje finanse i przyszłość, a zapowiedziany niedawno nowy, 5-letni plan rozwojowy Chin na lata 2026-2030 ma ociekać od konkretnych zobowiązań w tej dziedzinie. Wszystko wskazuje na to, że w tym kluczowym współczesnym procesie cywilizacyjnym Stary Kontynent stoi na poboczu.

Co o sztucznej inteligencji sądzą programiści

Programiści wykonują pracę wręcz stworzoną dla współpracy z AI, warto więc przyjrzeć się, jakie nastroje panują w tej szczególnej grupie zawodowej. Stack Overflow, największa społeczność programistów na świecie, opublikowała spore badanie opinii branży wobec AI, „2025 Developer Survey”. Choć większość korzysta już z narzędzi AI wspomagających kodowanie (47 proc. codziennie), jest to ostrożna współpraca.

Tylko 3 proc. programistów wyraźnie stwierdza, że ufa kodowi od AI, a 30 proc. wyraża „ostrożne zaufanie”. Jeszcze większa jest nieufność wobec agentów AI, czyli programów, które otrzymują dostęp do kodu i mogą samodzielnie realizować powierzone cele. 70 proc. ankietowanych nigdy nie korzystało z agenta AI, a 38 proc. twierdzi, że nie zamierza tego nigdy robić.

No i wisienka na torcie: sentyment wobec AI („Jak ogólnie oceniam korzystanie z AI w mojej pracy?”) jest wyraźnie gorszy niż w poprzednim roku i dwa lata temu (60 proc. pozytywnych odpowiedzi, a było ponad 70 proc.). Zmęczenie? Zawód?

„Tygodnik Powszechny” – jedyny polski tygodnik społeczno-kulturalny.

30 tys. Czytelniczek i Czytelników. Najlepsze Autorki i najlepsi Autorzy.

Wspólnota, która myśli samodzielnie.