Regularnie wchodzimy w interakcje z dwoma potężnymi, choć bardzo odmiennymi miniaturowymi mechanizmami.

Codziennie korzystamy z komputerów i smartfonów wyposażonych w mikroprocesory. Kluczowi producenci chwalą się dziś wytwarzaniem układów scalonych w technologii 3 nanometrów, wykorzystując do bardzo precyzyjnego „drukowania” na krzemowej płytce maleńkich tranzystorów przy pomocy bardzo krótkich fal świetlnych.

Wraz z miniaturyzacją spada koszt energetyczny i wzrasta moc obliczeniowa takich układów. W jednym milimetrze kwadratowym procesora wytworzonego w takiej technologii mieści się nawet 250 mln tranzystorów. Można stwierdzić, że to triumf ludzkiego umysłu nad materią – struktura o niewyobrażalnej precyzji, którą możemy programować i nad którą mamy absolutną kontrolę. Wiemy dokładnie, co robi w każdym ułamku sekundy.

Mikroprocesor czy wirus: co jest bardziej złożone?

Z drugiej strony, nasz układ odpornościowy codziennie styka się z wirusami, które również operują w skali nano. Przykładowo: wirus wywołujący wystąpienie covid-19 jest rozmiaru zbliżonego do pojedynczego tranzystora w nowoczesnym mikroprocesorze.

Jak na standardy biologiczne, wirus wydaje się niezbyt złożony – jego program genetyczny koduje zaledwie 50 białek, które decydują o tym, że może wnikać do innych komórek i się w nich namnażać, korzystając zresztą z mechanizmów molekularnych, które zastanie na miejscu. Logika tego programu genetycznego wygląda na prostą w porównaniu do olbrzymiej różnorodności operacji, które mogą być wykorzystane na układzie scalonym.

Co sprawia, że jako ludzkość mamy absolutną władzę nad układem scalonym, a zarazem stajemy się bezbronnymi ofiarami biologicznie prostych wirusów?

Jak się wydaje, różnica w poziomie rozumienia i możliwości kontroli tych dwóch układów nie może leżeć ani w wielkości, ani w poziomie skomplikowania. Ani w samych prawach przyrody – identyczne fundamentalne prawa działają na mikroprocesory i na koronawirusy.

By odpowiedzieć na powyższe pytanie, David Krakauer odwołuje się do pojęcia złożoności. Miniaturowe układy scalone może i są bardziej zaawansowane i skomplikowane, ale za to wirusy zdają się cechować większą złożonością. Mają zdolność do adaptacji i nieustannie ewoluują. Obie te struktury należą do dwóch różnych światów.

Współczesna nauka i dwa systemy świata

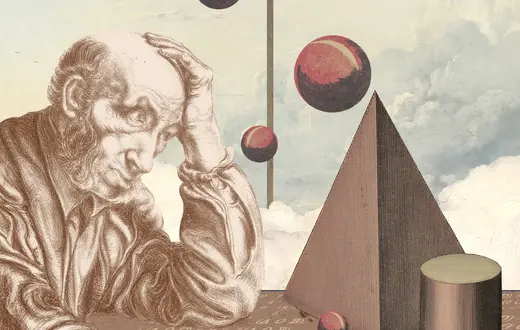

Po wyborze Urbana VIII na papieża Galileusz, zachęcony potencjalną odwilżą w stosunku kościelnych struktur wobec heliocentryzmu, postanowił sporządzić większą monografię na temat systemów astronomicznych. W 1632 r. opublikował „Dialog o dwu najważniejszych układach świata, Ptolemeuszowym i Kopernikowym”. Kluczowymi bohaterami „Dialogu” są dwie postacie: Salviati, który reprezentuje poglądy samego autora, oraz Simplicio – arystotelik, którego argumenty na rzecz geocentryzmu są, jeden za drugim, zbijane przez Salviatiego.

Salviati spotyka się z niezwykłym oporem. Nietrudno zrozumieć, że konsekwencje przyjęcia jego systemu nie ograniczą się do przerysowania kilku atlasów nieba. Konieczne będzie zburzenie olbrzymiego gmachu arystotelesowsko-ptolemejskiej wizji świata, w której Ziemia zajmuje centralne miejsce, a sfera niebieska rządzi się własnymi, doskonałymi prawami ruchu. To wizja podparta autorytetem scholastycznych autorów i przenikająca do szpiku ówczesną filozofię i teologię. Niełatwo porzucić taki paradygmat.

Jak przekonuje Krakauer, współczesna nauka znajduje się w podobnym stanie przejściowym pomiędzy dwoma systemami świata: klasycznym Systemem A – zamkniętym, odwracalnym i przewidywalnym światem teorii fundamentalnych, w którym królują proste zasady i minimalne założenia; oraz złożonym Systemem B – otwartym, samoorganizującym się, chaotycznym oraz pełnym fundamentalnej niepewności światem teorii efektywnych, w którym reguły gry nieustannie się zmieniają pod wpływem zmian w otoczeniu.

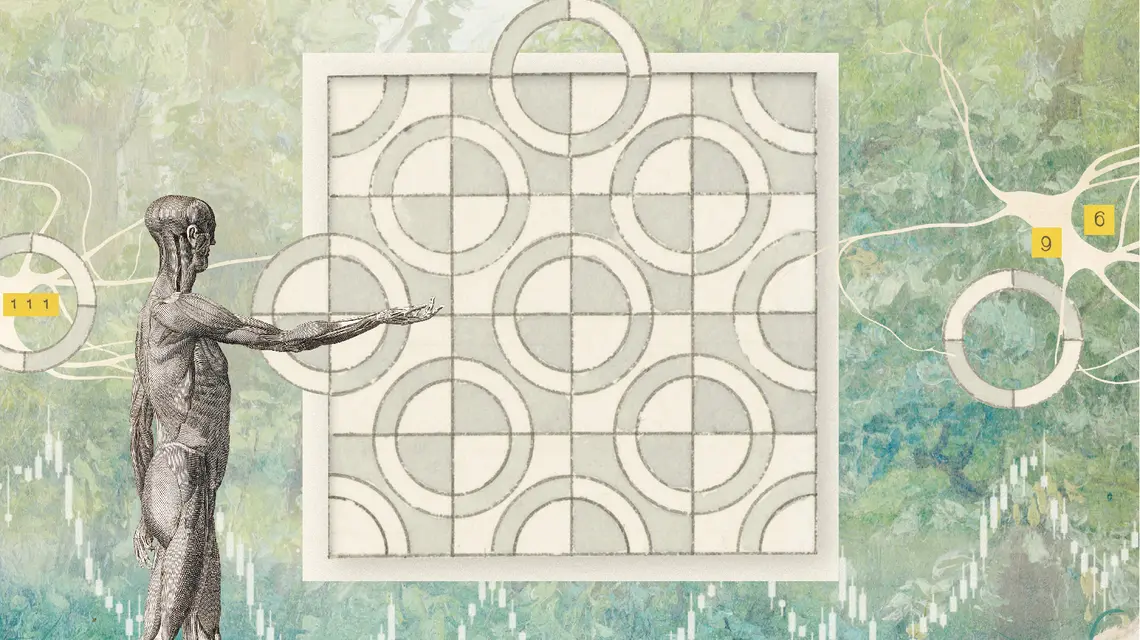

System A to świat symetrii i praw. Wszystko zachowuje się tu jak perfekcyjnie zaprojektowany, mechaniczny szwajcarski zegarek. To właśnie dzięki prawom Systemu A potrafimy zbudować posłuszny ludzkiej woli mikroprocesor czy wysłać sondę na orbitę Jowisza. Kochamy System A, ponieważ daje nam poczucie absolutnej przewidywalności i kontroli. System B to świat informacji i adaptacji. To świat wirusów, lasów tropikalnych, ludzkich mózgów, giełd finansowych i wielkich miast. System B uczy się na błędach, ewoluuje, dostosowując się do panujących warunków.

Zdaniem Krakauera zbyt często próbujemy wtłoczyć żywy, nieprzewidywalny System B w sztywne, strukturalne ramy Systemu A. Chcielibyśmy przewidywać wybuchy pandemii, zachowania tłumu czy krachy na giełdzie z taką samą bezbłędną precyzją, z jaką astronomowie przewidują zaćmienia Słońca. Jednak natura stawia tu twardy opór.

Równania opisujące ruch planet czy zderzenia atomów są całkowicie bezradne wobec układu, który potrafi się uczyć i ewoluować. Napięcie to jest w gruncie rzeczy źródłem fermentu w nauce – zderzeniem naszej potrzeby posiadania prostej, eleganckiej teorii z brutalnie chaotyczną rzeczywistością.

Aby w pełni zrozumieć metody, tempo i geografię rozprzestrzeniania się wirusa, działanie dużych modeli sztucznej inteligencji, dynamikę wahań giełdowych czy ludzkie społeczeństwo, musimy odrzucić naszą iluzję absolutnej kontroli. Musimy zaakceptować to, że System B wymaga nowych praw. Dla wielu naukowców akceptacja tego jest równie trudna i szokująca, co niegdyś dla arystotelików odrzucenie tezy, zgodnie z którą Ziemia znajduje się w centrum wszechświata.

Kiedy zaciera się różnica między wirusem i tranzystorem

Tymczasem to właśnie na styku Systemów A i B tworzy się nowy rodzaj nauki – nauka o złożoności, której Krakauer jest zaangażowanym apostołem. Nie tylko cechuje się ona nowym paradygmatem, lecz także dopuszcza inne, a nawet zaprasza do działania w obrębie wielu paradygmatów. Przecież różne sposoby patrzenia na świat mogą z powodzeniem współistnieć, jeśli tylko są użyteczne.

Wystrzeliwujemy satelity w kosmos, korzystając z praw fizyki klasycznej, nawigujemy nimi, wykorzystując teorię względności, a zasilamy je panelami słonecznymi opartymi na zasadach mechaniki kwantowej. Niewspółmierność obrazów świata, jakie wyłaniają się z tych teorii, nie musi koniecznie oznaczać ich niezgodności.

Takie podejście jest z natury odporne na redukcjonizm. Traktowanie różnych dyscyplin nauki jak odmiennych spojrzeń na rzeczywistość, podlegających tej samej uniwersalnej racjonalności, jest nadmiernym uproszczeniem. Opisują one różne, choć często przecinające się, zbiory zasad i wykorzystują odmienne narzędzia do badania świata. Nie można mówić o chemii jako „fizyce w innej skali”. To zbiór mechanizmów, który wymaga odrębnych, pozafizycznych zasad i modeli, aby w ogóle był użyteczny jako dyscyplina naukowa. Podobnie na biologię nie można patrzeć jak na „chemię w innej skali” itd.

Ponadto odmienności Systemów A i B nie dostrzeżemy przy wykorzystaniu potężniejszych narzędzi badawczych i pomiarowych. Przeciwnie: w coraz mniejszych skalach zaciera się różnica między wirusem i tranzystorem, neuronem i minerałem, mrowiskiem a kupą kompostu. Redukcjonizm charakterystyczny dla Systemu A nie tylko nie potrafi wyjaśnić złożoności, lecz sprawia, że w ogóle przestajemy być w stanie ją wykryć.

Z drugiej strony, nie powinniśmy myśleć, że naukę o złożoności da się sprowadzić wyłącznie do metod statystycznych, które uchwytują pewne regularności w ewoluującym i ciągle organizującym się na nowo świecie. Nauka o złożoności nie stanowi ilościowej techniki znajdowania statystycznego porządku w dużych zbiorach danych.

W ekstremalnym przypadku taka tendencja przyjmuje postać próby stworzenia jednej miary dla wszystkich złożonych obserwacji. Za pomocą takiej uniwersalnej metryki mielibyśmy mierzyć „poziom złożoności” ludzkiego mózgu, cywilizacji czy sztucznej inteligencji, umieszczając je wszystkie na tej samej osi. Zdaniem Krakauera – to absurd. To tak, jakbyśmy próbowali zmierzyć „poziom chemii” we wszystkich możliwych reakcjach chemicznych albo obliczyć „współczynnik antropologii” w społeczeństwie. Mylenie metody badawczej z teorią to ślepy zaułek.

Cztery historyczne filary nauki o złożoności

Krakauer to także skrupulatny historyk nauki, wskazujący prekursorów i pierwsze ślady nowego paradygmatu złożoności w XIX i XX-wiecznych tekstach z zakresu fizyki, biologii, informatyki i matematyki. Korzenie tego paradygmatu sięgają rewolucji przemysłowej XIX w. – koncepcje złożoności narodziły się w epoce maszyny i pary.

Ówczesny olbrzymi i niekwestionowany postęp technologiczny sprawił, że świadomie poszukiwano paraleli, które mogłyby połączyć triumfującą technologię z „mechaniką życia”, a próby te często wymagały wypracowania nowego języka. Choć maszyna parowa była systemem czysto fizycznym i na dodatek skonstruowanym przez człowieka, zaczęła wymagać opisu w kategoriach innych niż te znane z tradycyjnej fizyki.

Wymogi pracy mechanicznej wymusiły zmianę słownictwa – w szerszy obieg weszły takie terminy jak wydajność, produkcja, kontrola, użyteczność, trwałość czy wartość. A z nich wyrosły nowe teorie naukowe i modele matematyczne. Według Krakauera z XIX-wiecznych prób zrozumienia „pracującej materii” wyłoniły się cztery historyczne filary nauki o złożoności, które w XX w. zaczęły być integrowane w jeden spójny system świata.

Pierwszy z filarów zrodził się z prób zwiększenia wydajności maszyn parowych. Inżynierowie tacy jak Sadi Carnot próbowali zrozumieć, jak wycisnąć z dawki paliwa maksimum pracy mechanicznej. Te z początku czysto praktyczne poszukiwania doprowadziły do odkrycia termodynamiki i pojęcia entropii. Rudolf Clausius nadał jej rangę uniwersalnego prawa, głosząc, że wszechświat nieuchronnie dąży do nieuporządkowania, a Ludwig Boltzmann przełożył to na język statystyki i prawdopodobieństwa, wyjaśniając tym samym, dlaczego czas płynie tylko w jedną stronę. Ten sam nurt myślenia dostarczył później argumentów za fizycznym charakterem informacji.

Równolegle wizjonerzy tacy jak Charles Babbage i Ada Lovelace kładli podwaliny pod drugi filar: obliczenia. Zrozumieli oni, że fizyczna materia – wtedy jeszcze w postaci mosiężnych kół zębatych, nie mikroskopijnych krzemowych tranzystorów – może służyć do przetwarzania logiki.

Lovelace jako pierwsza opanowała sztukę programowania, opisując algorytm obliczający tzw. liczby Bernoullego. Spekulowała też nad rozmaitymi zastosowaniami tzw. maszyny analitycznej – zaprojektowanego przez Babbage’a mechanicznego urządzenia – wykraczającymi poza obliczanie tablic matematycznych, do czego pierwotnie miała ona służyć.

Dopełnieniem ich prac był projekt George’a Boole’a, który ujął podstawowe prawa ludzkiego myślenia w terminach algebry binarnej, w której wyrażeniom logicznym można przypisywać jedną wartość: prawdy lub fałszu.

Nowy paradygmat złożoności

Trzeci filar paradygmatu złożoności wyrósł z próby naturalizacji biologii i znalezienia mechanizmu, który stoi za oszałamiającą różnorodnością życia. Karol Darwin i Alfred Wallace zaproponowali teorię doboru naturalnego wyjaśniającą tę różnorodność w ramach bezwzględnego, samoregulującego się mechanizmu. Co ciekawe, Wallace porównywał ten proces do regulatora odśrodkowego w maszynie parowej – urządzenia, które automatycznie koryguje wahania prędkości obrotowej i utrzymuje stabilność systemu.

Gdy Gregor Mendel dorzucił do tej układanki odkrycie jednostek dziedziczenia, nauka zyskała model tego, jak informacja genetyczna jest przekazywana, modyfikowana i optymalizowana w starciu z surowym filtrem środowiska.

Ostatni filar to dynamika, która zrodziła się z potrzeby zapanowania nad ruchem. James C. Maxwell przeprowadził pierwszą rygorystyczną analizę stabilności mechanicznych regulatorów silnika parowego, kładąc podwaliny pod to, co dziś nazywamy cybernetyką.

Jednak to Henri Poincaré, badając ruch ciał niebieskich, odkrył teorię chaosu. Wykazał, że w układach rządzonych nawet prostymi prawami Newtona minimalne zmiany warunków początkowych prowadzą do całkowicie odmiennych, nieprzewidywalnych skutków, co jest kluczową cechą systemów złożonych. Znaną reprezentacją tego zjawiska jest tzw. problem trzech ciał.

Od połowy XX w. nauka o złożoności przechodzi proces syntezy i konsolidacji, czego historię można prześledzić w monumentalnej, czterotomowej antologii tekstów źródłowych „Foundational Papers in Complexity Science” (SFI Press, 2024).

Nowy paradygmat złożoności jest inny od wielu wcześniejszych, a mimo to pozostaje z nimi zgodny. Aby przezwyciężyć ograniczenia istniejących koncepcji, modeli i ram teoretycznych, które przez wieki powstawały w ramach Systemu A, konieczne było odkrycie nowych, efektywnych teorii. Często nie są one w pełni obliczalne, a wiele z nich może zostać uznane za „nieeleganckie” według standardów teorii fundamentalnych. Są one jednak niezbędne do tego, by poradzić sobie z problemami, które pojawiają się na granicy systemów A i B – np. wyłanianie się nowych, nieoczywistych struktur w na pozór prostych układach.

Porządkowanie pojęć: „podlegać” a „determinować”

To właśnie pojęcie wyłaniania się (emergencji) stanowi serce nauki o złożoności. Najczęściej odnosi się ono do zagadki powstawania stanów makroskopowych, które wykazują właściwości nieobecne na poziomie ich mikroskopowych części składowych.

Choć często przywołuje się tu arystotelesowską maksymę, że „całość jest czymś więcej niż sumą części”, Krakauer sugeruje, że technicznie trafniejsze jest stwierdzenie, iż „całość jest czymś innym niż suma jej części”.

Dla wielu naukowców przełomem w rozumieniu tego zjawiska był artykuł Philipa Andersona „Więcej znaczy inaczej” („More is Different”). Anderson wykazał, że wraz ze wzrostem skali układu następuje fundamentalna nieredukowalność epistemologiczna: przy pewnym poziomie komplikacji prawa fizyki fundamentalnej przestają determinować zachowanie całości.

Kluczowe jest tu rozróżnienie między słowami „podlegać” a „determinować” – chemia podlega prawom fizyki ciała stałego, a biologia molekularna prawom chemii, ale te niższe poziomy nie determinują w pełni struktury poziomów wyższych. Każdy etap hierarchii nauk wymaga własnych, unikalnych struktur pojęciowych.

Aby uporządkować te rozważania, Krakauer wprowadził narzędzie zwane kratą emergencji (emergence lattice), która pozwala precyzyjnie sklasyfikować procesy wyłaniania się nieredukowalnych własności. Krata ta rozpiera się na dwóch osiach: oś pozioma (tranzycje) dotyczy lokalnych oddziaływań, takich jak wiązania chemiczne, które prowadzą do powstania nowych stanów; oś pionowa (kolekcje) odnosi się do globalnej agregacji wielu elementów w całości, gdzie kluczowe staje się uśrednianie (lub po prostu rozpatrywanie w większej skali).

Czy wszystko jest złożone?

Krakauer zauważa, że o ile w termodynamice możemy jeszcze czasem przewidzieć właściwości całości na podstawie części (np. zmianę stanu skupienia wody pod wpływem temperatury), o tyle w przypadku systemów żywych jest to w zasadzie niemożliwe.

Tu pojawia się najważniejszy element teorii Krakauera: „schemat”. Złożone systemy adaptacyjne, takie jak wirus czy ludzki mózg, nie tylko podlegają prawom fizyki, ale wykształcają własne, wewnętrzne modele otoczenia. Ten wewnętrzny „teoretyk”, zaszyty w genomie czy w neuronach, sprawia, że organizm przestaje być biernym przedmiotem fizyki, a staje się aktywnym podmiotem, który interpretuje świat, by w nim przetrwać. To właśnie ten „schemat” ostatecznie rozrywa stare ramy Systemu A i zmusza nas do przyjęcia perspektywy nauki o złożoności.

Są na świecie szkoły myślenia, które z arogancką pewnością siebie głoszą, że „wszystko jest fizyczne”, „wszystko jest matematyczne”, albo „wszystko jest poezją” lub „wszystko jest religią”.

Krakauer nie zamierza popełniać takiego samego błędu. Ostatnią rzeczą, jakiej pragnie, jest ogłoszenie, że oto wszystko jest złożone i może być skutecznie zbadane wyłącznie w obrębie nowego paradygmatu. Wręcz przeciwnie: uważa, że nauka o złożoności wymaga powściągliwości, a kluczowe jest, aby nie mylić zastosowania konkretnej metody z definicją całej dziedziny badań.

Nauka o złożoności pozwala zrozumieć, że różnorodność paradygmatów jest nie tylko użyteczna, lecz także nieunikniona.

Artykuł pochodzi z katalogu Copernicus Festival 2026: „Złożoność”, który ukaże się 12 maja wraz z numerem 20 „Tygodnika”. Tegoroczny festiwal potrwa od 19 do 24 maja. Program i więcej informacji: www.copernicusfestival.com

„Tygodnik Powszechny” – jedyny polski tygodnik społeczno-kulturalny.

30 tys. Czytelniczek i Czytelników. Najlepsze Autorki i najlepsi Autorzy.

Wspólnota, która myśli samodzielnie.