Klasyczne interfejsy mózg–komputer (BCI) opierają się na świadomie generowanych wyobrażeniach (np. ruchu ręką) lub koncentracji uwagi (np. liczenie mignięć), które komputer tłumaczy na ustalone z góry komendy lub komunikaty, co umożliwia pacjentom komunikację. Aktywność mózgowa niosąca ślady tych wyobrażeń jest odczytywana z powierzchni głowy (klasyczne EEG) lub z elektrod implantowanych w jej wnętrzu w celu zamiany na tekst lub polecenia. To drugie podejście daje stabilniejsze i szybsze działanie – od 2006 r. naukowcy wszczepili takie elektrody kilkudziesięciu pacjentom.

Mówienie myślą: jak działa dekodowanie mowy z mózgu

W 2023 r. nowe podejście, oparte na dekodowaniu aktywności neuronów zaangażowanych w wypowiadanie konkretnych słów, dało rekordową (odnotowaną w Księdze Guinnessa) szybkość 78 słów na minutę. Z pomocą uczenia maszynowego identyfikowano wzorce aktywności neuronów, przygotowujące aparat mięśniowy do wypowiadania konkretnych słów z wybranego zestawu.

W bieżącym roku naukowcy z Uniwersytetu Kalifornijskiego w Davis poszli jeszcze inną drogą. Pacjent, który skutkiem stwardnienia zanikowego bocznego (ALS) utracił zdolność zrozumiałego mówienia, próbował wypowiadać – wyobrażając sobie też różne intonacje – wyświetlane na ekranie zdania, a komputer dopasowywał rejestrowane przez elektrody wzorce aktywności neuronalnej do sztucznie wygenerowanego brzmienia tych samych zdań. W ten sposób stworzono system, który zamienia aktywność neuronalną tego pacjenta na dźwięki – włącznie z intonacją, i to niemal natychmiast.

Z mózgu do głośnika: kiedy komputer mówi za człowieka

W poprzednich podejściach znaczenie konkretnego słowa mogło być dekodowane dopiero po zarejestrowaniu odpowiadającej mu aktywności mózgu, czyli z opóźnieniem rzędu sekund. W tym przypadku aktywność neuronów była przetwarzana na dźwięki 100 razy na sekundę, tak że odtwarzane przez głośnik dźwięki składały się w zrozumiałe dla słuchaczy wypowiedzi. W dekodowaniu ponownie wykorzystano uczenie maszynowe, tym razem włącznie z modelem uwagi obecnym w transformerach (ostatnia litera w nazwie Chat GPT odnosi się właśnie do tej architektury).

To wciąż badania podstawowe, ale ich liczba wskazuje, że po okresie szumu medialnego wokół kopiowania świadomości, podglądania myśli i podobnych fantazji, badania nad BCI powracają przynajmniej w części do kwestii komunikacji z pacjentami w stanach zamknięcia.

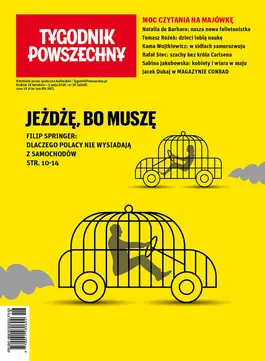

„Tygodnik Powszechny” – jedyny polski tygodnik społeczno-kulturalny.

30 tys. Czytelniczek i Czytelników. Najlepsze Autorki i najlepsi Autorzy.

Wspólnota, która myśli samodzielnie.