Jest połowa XX w. Witold Starkiewicz, warszawski okulista, bierze na warsztat dziwaczne urządzenie zbudowane u schyłku XIX w. przez innego naukowca, Kazimierza Noiszewskiego. Maszyna, nazwana elektroftalmem, miała służyć jako rodzaj sztucznego zmysłu wzroku dla niewidomych. W jej skład wchodziła fotokomórka, która wysyłała sygnał elektryczny, następnie przekształcany na sygnał dźwiękowy, co pozwalało niewidomemu rejestrować źródła światła w otoczeniu, dzięki reprezentowaniu ich za pomocą natężenia dźwięku – im bardziej intensywny dźwięk, tym jaśniej.

Starkiewicz zmodyfikował i ulepszył zapomniany nieco wynalazek Noiszewskiego. Jego wersja posiadała płytkę ze 120 elektrodami, przyczepianymi do czoła osoby niewidomej. Służyły do reprezentowania informacji o naświetleniu, dzięki stymulacji skóry. Użytkownik mógł np. wykryć ścieżkę, która ma jaśniejszy kolor niż otaczający ją trawnik.

Na krześle dentystycznym

Elektroftalm był pierwszym w historii urządzeniem do substytucji sensorycznej (zmysłowej), czyli kodowania informacji jednego zmysłu (np. wzroku) na informację dostępną dla innego (np. słuchu czy dotyku). Polscy badacze najwcześniej eksperymentowali z technologią tego typu, jednak substytucja sensoryczna została najbardziej gruntownie przebadana i spopularyzowana przez amerykańskiego naukowca Paula Bacha-y-Ritę.

Zbudował on urządzenie nazywane dziś „krzesłem Bacha-y-Rity”. Było to zmodyfikowane krzesło dentystyczne, wyposażone w kamerę podłączoną do matrycy złożonej z 400 elektrod, które stymulowały lędźwie osoby siedzącej. Wzorce stymulacji przypominały obraz przechwycony przez kamerę. Dzięki lepszej rozdzielczości niż w przypadku elektroftalmu matryca pozwalała na reprezentowanie bardziej złożonych obrazów.

Doświadczenie zmysłowe wywołane za pomocą krzesła było dla niektórych użytkowników czymś przełomowym; otwierało na niedostępny wcześniej świat form, kształtów i przestrzeni. Ludzie posługujący się wzrokiem w codziennym życiu są przyzwyczajeni do tego, że rzeczy pojawiają się w całości swojej formy, u osób niewidomych tego rodzaju doświadczenie nie występuje albo jest przynajmniej rozciągnięte w czasie.

Gdy niewidomy chce znaleźć widelec leżący na stole pośród innych sztućców, musi wyczuć najpierw coś podłużnego, chłodnego i metalowego. Na tym etapie nie wie jeszcze, czego dotknął. Bierze więc sztuciec do ręki i przejeżdża palcem po powierzchni. Dopiero po wykonaniu całej serii tych czynności ma wrażenie poznania całości przedmiotu.

Właśnie z tego powodu, że osoby niewidome skazane są na wykonywanie podobnych rozciągniętych w czasie sekwencji czynności, gdy chcą doświadczyć czegoś „w całości”, zdaniem niektórych filozofów pozbawione są koncepcji przestrzeni albo ich koncepcja przestrzeni jest niesprowadzalna do tej, którą posiadają osoby widzące.

Krzesło Bacha-y-Rity otwierało więc dla osoby niewidomej zupełnie nowy sposób postrzegania rzeczywistości. Początkowo było to silne i wyjątkowe doznanie. Szybko jednak okazało się, że pacjenci, w miarę jak nabierali biegłości w posługiwaniu się krzesłem, coraz mocniej integrowali wrażenia wywołane przez urządzenie ze swoimi pozostałymi doświadczeniami percepcyjnymi.

Widzenie całą skórą

Przykładem takiej integracji jest tzw. dystalna percepcja. Kiedy osoba widząca na coś patrzy, w jej mózgu dochodzi do dekodowania podrażnień komórek światłoczułych siatkówki przez światło odbijane przez postrzegane obiekty. Nie mamy jednak wrażenia światła łaskoczącego ścianę siatkówki, tak jak to odczuwamy wtedy, kiedy światło słoneczne pada na skórę naszej dłoni. Mamy wrażenie obiektu umieszczonego w pewnej odległości przed nami.

Użytkownicy krzesła Bacha-y-Rity najpierw odczuwali łaskotanie na plecach, ale wraz z treningiem pojawiało się u nich coraz wyraźniej wrażenie odbierania bodźców pochodzących z odległości. Stymulacja na skórze dawała wrażenie obiektu znajdującego się przed nimi.

Krzesło dentystyczne nie jest oczywiście najwygodniejszym sposobem przeprowadzania substytucji sensorycznej, dlatego wkrótce powstały przenośne formy urządzenia. Przyniosło to nowe, zaskakujące odkrycie. Okazało się, że przemieszczanie matrycy elektrod w inne miejsce na ciele nie zaburzało wytrenowanej wcześniej zdolności rozpoznawania kształtów, o ile użytkownik mógł czuć na skórze wszystkie elektrody. Kiedy nauczymy się „widzieć” skórą, czuły na dekodowanie informacji wizualnej nie jest tylko jej fragment, ale całość.

Odkrycia Bacha-y-Rity dostarczyły dowodów na istnienie zjawiska, które zostało teoretycznie opisane przez neurofizjologa Jerzego Konorskiego w pracy z 1948 r. Chodzi o tzw. neuroplastyczność, czyli zdolność mózgu do strukturalnej i funkcjonalnej reorganizacji. Do czasu odkrycia substytucji sensorycznej pojęcie neuroplastyczności było mało znane, a konsensusem w psychologii było założenie, że w mózgach osób dorosłych nie dochodzi już do większych zmian.

Niewidomy fotograf

Zakres kodowania informacji wzrokowych za pośrednictwem skóry jest ograniczony. Niemożliwe jest np. kodowanie koloru ani skali szarości. Użytkownikom problem sprawiały również zachodzące na siebie obiekty, niemożliwe było też widzenie głębi. Dlatego wkrótce zaproponowano bardziej złożone sposoby reprezentowania informacji istotnych dla wzroku. Peter Meijer w 1990 r. stworzył urządzenie zwane The vOICe (OIC w nazwie urządzenia pochodzi od „oh, I see!”, czyli „ja widzę!”). The vOICe skanuje obraz z kamery i piksel po pikselu tłumaczy go na dźwięk, tworząc tzw. pejzaż dźwiękowy. Im piksel jaśniejszy, tym głośniejszy dźwięk, a im wyżej znajduje sie na obrazie, tym wyższa częstotliwość dźwięku.

Początkowo te pejzaże przypominają niezrozumiały miks szumów, tików i bipów, dźwięków rodem z filmu science fiction z lat 60. Jednak po pewnym czasie użytkownicy uczą się wyciągać z nich bardziej złożone informacje.

Pat Fletcher jako 21-letnia dziewczyna była pracownikiem zakładów chemicznych. W wypadku straciła wzrok, jej lewe oko zachowało odrobinę światłoczułości, prawe zostało w całości wypalone. W 1998 r., ponad 20 lat po wypadku, Fletcher po raz pierwszy usłyszała o wynalazku Meijera. Już pierwszy kontakt z urządzeniem był dla niej intrygujący, rozejrzała się po pokoju i zaczęła słyszeć nieregularności powierzchni. Wysokie, podłużne obiekty dawały wysoki dźwięk, po raz pierwszy od 20 lat Pat była w stanie rozpoznać świat wokół siebie bez użycia laski. Nie był to jednak koniec, jej umiejętności szybko się rozwijały – a w jej umyśle zaczęły pod wpływem urządzenia powstawać obrazy.

Z początku taki obraz tworzył wrażenie płaskiego hologramu, obrazka 2D wiszącego przed nią. Badani na tym etapie opisują, jak myląca może być dla nich perspektywa. Jedna z użytkowniczek opisywała np. sytuację, w której miała wrażenie, że oddalający się samochód, na który „patrzyła”, zaczął wjeżdżać pionowo po ścianie wieżowca. Ale „syntetyczny” wzrok i tak pozwalał badanym na niesamowite rzeczy, Fletcher po pewnym czasie wróciła do jazdy rowerem, wkrótce potrafiła rozpoznawać twarze. Pewnego dnia, po około 10 latach korzystania z urządzenia, nastąpił przełom.

Pat sprzątała w kuchni, mając na sobie vOICe. Zmywała naczynia, spojrzała w dół, żeby się upewnić, czy w zlewie nie została woda. Nagle stało się coś niezwykłego, w jednym momencie jej percepcja 2D zmieniła się w 3D! Zobaczyła krawędzie prowadzące w perspektywie na dno zlewu. „Mogłam zajrzeć do pokoju. Ten płaski rysunek ma teraz głębię. Wyczuwam to. Nie mogę ci powiedzieć, co jest po drugiej stronie pokoju, ale mogę powiedzieć, że jest naprzeciwko mnie – opisywała Fletcher. – To jak oglądanie czarno-białego filmu z lat 40. Widzę drzewo od góry do dołu i popękany chodnik”.

Liczba użytkowników vOICe stale rośnie. Jednym z bardziej spektakularnych dowodów możliwości, jakie to urządzenie otwiera, są prace Pranava Lala – niewidomego od urodzenia fotografa.

Maszyna uniwersalna

Badacze szybko zainteresowali się neuronalnym podłożem zjawiska. Okazało się, że osoby korzystające dłuższy czas z urządzeń do substytucji sensorycznej zaczynały używać mózgu w zupełnie inny sposób, niż opisywały to w tamtym czasie podręczniki neuroanatomii.

Już pierwsze badania Pat Fletcher funkcjonalnym rezonansem magnetycznym pokazały, że słuchanie dźwięków z urządzenia, reprezentujących spójny obraz, wywołują u niej aktywacje w korze wzrokowej. Co oznacza, że pacjentka „słuchała” dźwięków za pomocą obszaru mózgu, który normalnie odpowiadał za widzenie. Podobne efekty zaobserwowano u użytkowników innych urządzeń do substytucji.

Dalszych dowodów dostarczyły badania z wykorzystaniem metody przezczaszkowej stymulacji magnetycznej (TMS). Jest to metoda, która pozwala na nieinwazyjne i bezpieczne, tymczasowe zakłócenie działania jakiejś sieci neuronalnej, dzięki czemu można zbadać jej funkcję. Również jedną z pierwszych badanych poddanych tej metodzie była Fletcher. W jednej z procedur miała rozpoznać kształty wyświetlane na ekranie. Gdy jej kora wzrokowa nie była stymulowana za pomocą TMS, badana miała 75 proc. trafności rozpoznania obiektu. Jednak w próbach, w których jej kora wzrokowa była stymulowana, trafność spadła drastycznie, do 25 proc. Kiedy pole magnetyczne TMS zakłócało korę wzrokową, „wzrok” pacjentki za pomocą urządzenia vOICe pogarszał się coraz bardziej. Jej świat stawał się ciemniejszy, jakby ktoś powoli gasił światła. Jak opisywała, nie było to przyjemne doświadczenie: „Było to dla mnie całkowicie dezorientujące, w moim mózgu... nic nie widziałam. Chciałam płakać, ponieważ myślałam, że zepsuli mi wzrok – to było tak, jakby ktoś zarzucił mi kaptur na głowę”.

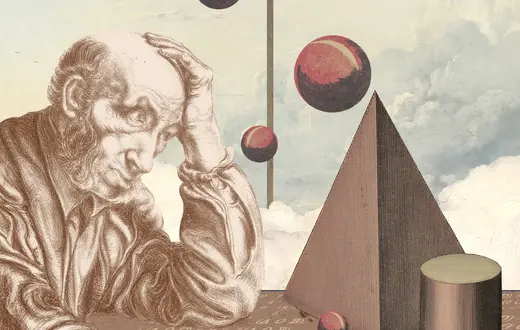

Widzenie za pomocą słuchu jest czymś, co wykracza poza zakres wielu klasycznych teorii tłumaczących przetwarzanie informacji wzrokowej. Często odwoływały się one do założenia modularności umysłu. Według tej teorii rozmaite funkcje umysłu opierają się na wyspecjalizowanych obszarach mózgu – np. obszarze kory motorycznej, czuciowej i wzrokowej, które przetwarzają tylko właściwe dla siebie informacje. Podejście takie początkowo potwierdzały zarówno badania neuroobrazowe, jak i studia nad pacjentami, którzy przeszli rozmaite uszkodzenia mózgu (np. dzięki słynnym pacjentom badanym przez Paula Brokę udało się zlokalizować obszar mózgu uznawany za ośrodek produkcji języka).

Dziś, m.in. dzięki badaniom nad substytucją zmysłową, coraz bardziej docenia się zjawisko neuroplastyczności. Zdajemy sobie sprawę, że moduły funkcjonalne nie są w mózgu wyryte jak w kamieniu. Mogą się rozszerzać, a nawet jeden może zostać zastąpiony przez inny. Mózg nie jest więc układanką wyspecjalizowanych obszarów, ale raczej dynamiczną siecią połączeń, uniwersalną maszyną interpretującą, wyszukującą schematy w sygnałach, które do niego docierają. Dopiero zaczynamy rozumieć granice i możliwości jego plastyczności. ©

Autor pracuje w Laboratorium Badań Świadomości C-Lab UJ. Przygotowuje doktorat z filozofii i neuronauki poznawczej.

UCIELEŚNIONY SAMOLOT

Nie tylko wzrok jest zmysłem, który próbuje się zastąpić cyber-zmysłami. W 2015 r. Scott Novich i David Eagleman zaprezentowali Vest – urządzenie o wyglądzie niepozornej kamizelki, tłumaczące informacje dźwiękowe na dotyk. Wytwarzane przez nie wibracje kodują za pomocą rozkładu w czasie i przestrzeni nawet bardzo subtelne informacje o otoczeniu dźwiękowym użytkownika. Już po ośmiu godzinach treningu osoby niesłyszące od urodzenia są w stanie precyzyjnie rozpoznawać pojedyncze słowa mówione w języku angielskim. Co ciekawe: użytkownicy nie są w pełni świadomi reguł, według których kodowane są informacje dźwiękowe. W pewnym sensie uczą się tych reguł całym ciałem, a nie pojęciowo. Dlatego Vest jest używany do eksperymentów z różnego rodzaju ucieleśnionymi interfejsami, tj. takimi, które zamiast reprezentować dane za pomocą wykresów i liczb, pozwalają poczuć całym ciałem istotne dla obsługi urządzenia dane. Dla przykładu: pilot, aby sprawnie obsługiwać samolot, musi przyswoić sobie bardzo dużą ilość konceptualnych danych, które informują go, w jakim stanie jest samolot i jak dostosować sterowanie. Co jednak, gdybyśmy te dane podawali mu przez Vest w czasie rzeczywistym? Eagleman spekuluje, że pozwoliłoby to pilotowi „ucieleśnić” maszynę, a podobna technologia mogłaby znaleźć zastosowanie również w analizie danych giełdowych czy zarządzaniu przestrzeniami magazynowymi. © PG

„Tygodnik Powszechny” – jedyny polski tygodnik społeczno-kulturalny.

30 tys. Czytelniczek i Czytelników. Najlepsze Autorki i najlepsi Autorzy.

Wspólnota, która myśli samodzielnie.