W odpowiedzi otrzymamy sporo ciekawych, nieintuicyjnych wyników i nieco pogłębiony obraz tego, co jest niemal pewne, co możliwe, a co raczej mało prawdopodobne, jeśli chodzi o przyszłość sztucznej inteligencji i naszą.

W swoim nowym cyklu Łukasz Lamża, dziennikarz naukowy „Tygodnika”, patrzy w przyszłość doby antropocenu trzeźwo, bez paniki i bez naiwności, na podstawie liczb, nauki i zdrowego rozsądku.

Przyglądamy się największym wyzwaniom epoki człowieka oraz drodze, która zaprowadziła nas od afrykańskich sawann do globalnej wioski. Omawiamy badania naukowe i dyskusje nad interakcjami między człowiekiem i innymi elementami przyrody – zarówno tymi współczesnymi, jak i przeszłymi.

Montaż i muzyka: Michał Woźniak

Pełna transkrypcja rozmowy

Poniższy tekst powstał w oparciu o transkrypcję maszynową, może zawierać usterki językowe.

Cześć i czołem, tu Łukasz Lamża i „Jeszcze inna przyszłość” dla Podkastu Tygodnika Powszechnego. Wiem, że mówiłem już o sztucznej inteligencji, ale to jest, jak sami pewnie dobrze wiecie, temat rzeka.

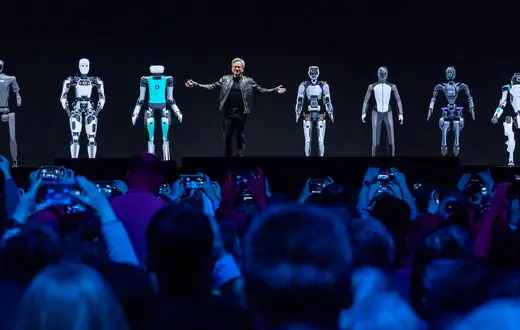

Dzisiaj postanowiłem opowiedzieć wam o fajnym badaniu opinii publicznej na temat przyszłości sztucznej inteligencji, przy czym publiczność jest tutaj rozumiana w bardzo szczególny sposób. W badaniu tym wzięło udział 2778 osób, które zostały zaproszone do udziału przez twórców pracujących w AI Impacts na Uniwersytecie Psychologii w Niemczech i w paru innych instytucjach. Tak czy inaczej, grupa naukowców postanowiła popytać innych naukowców, co sądzą o przyszłości AI.

Tych 2778 osób to są ci, co zgodzili się spośród osób, które publikują w dziedzinie sztucznej inteligencji. A więc mamy tutaj dosyć ciekawą grupkę ludzi, którzy, możemy przynajmniej zakładać, wiedzą mniej więcej, o co chodzi, aktywnie biorą udział w powstawaniu sztucznej inteligencji. Są też w tej grupie ludzie, którzy pracują w dużych międzynarodowych labach komercyjnych, a więc nie są to tylko jakieś, za przeproszeniem, dziadki borowe, które sztuczną inteligencję widziały w jakiejś skrzynce 40 lat temu. No nie. Mamy tutaj ludzi, którzy publikują w ostatnich latach w jednym z sześciu najbardziej szanowanych miejsc poświęconych sztucznej inteligencji.

OK, co z tego badania wynika? No, troszeczkę uspokajania nastrojów, a troszeczkę ciekawych, prowokujących myśli. Więc przejdźmy sobie przez niektóre z ciekawszych wyników. Jedno z pierwszych pytań brzmiało tak: Macie tutaj oto przed sobą listę tak zwanych milestones, kamieni milowych, jakiś cel do osiągnięcia i pytanie brzmi, kiedy – należało podać po prostu datę, rok – zostanie osiągnięty dany milestone. I to, na co w tym momencie patrzę, to są niektóre z tych milestones i zakres podawanych przez ekspertów odpowiedzi. Przykładowo: coś takiego zupełnie prościutkiego, zacznijmy od łatwych rzeczy. Dobry esej na temat historii, wypracowanie, byśmy po polsku powiedzieli, na poziomie szkoły średniej.

No więc to było wypełniane w 2023 roku jesienią i tutaj średnia odpowiedzi to jest 2024 rok. W zasadzie można powiedzieć, że mamy to już i chyba większość ekspertów zgodziłaby się, że już coś takiego może powstać. Plus minus niewielkie korekty.

Transkrypcja mowy, czyli coś takiego, z czego ja czasami korzystam. Mamy nagranie dźwięku, choćby moich własnych słów, i przepisanie tego do postaci tekstu. Tutaj mamy średni odpowiedź rok 2026. Można w praktyce uznać, że jest to albo już, albo będzie niebawem. Klasyfikowanie obiektów blisko. Z takich może ciekawszych rzeczy. Wytworzenie fikcyjnej nowej piosenki, stworzonej jakby rzekomo przez określonego artystę, czyli podszycie się pod Michaela Jacksona, pod wybrany zespół i tak dalej. Tu mamy 2026, 2027, chociaż te widełki, czyli ten zakres zaczyna być coraz bardziej interesujący, bo te najdalsze odpowiedzi to już są w latach 30., 2033, 2034. To już jest ta odpowiedź osób bardziej sceptycznych. Tłumaczenie mowy w postaci napisów to też nie jest prosta sprawa. Średnia 2028, 2038 to jest już ta końcówka.

Ale teraz przechodzimy do troszeczkę bardziej skomplikowanych rzeczy. Może was zaskoczy na przykład takie zadanie. Samodzielne nauczenie się, jak sortować długie listy. Wybrałem ten przykład, ponieważ jest techniczny, jest dzięki temu bardzo interesujący. Sortowanie, czyli uporządkowanie listy składającej się z liter, tzw. stringów, mówiąc w slangu programistów, to wbrew pozorom nie jest banalne zadanie. Jeżeli mamy coś takiego jak nazwiska, Nowak, Kowalski, Lewandowski, to każdy z nas zrobi to spokojnie w pamięci: Kowalski, Lewandowski, Nowak. Natomiast, po pierwsze, jeżeli ta lista będzie miała długość 10 tysięcy, to zrobi się z tego poważne zadanie, trudne do wykonania. Po drugie, te listy mogą być coraz dłuższe i dłuższe, i dłuższe. Krótko mówiąc, wcale nie jest oczywiste, jak to dobrze zrobić. Można to robić metodami siłowymi, czyli na przykład zawsze porównywać parami i zamieniać je miejscami, jeżeli jedna jest wcześniej, inna później, ale w ogólności to nie jest wcale łatwe zadanie.

I wydawałoby się, kurczę, te algorytmy są już w stanie generować piosenki nieodróżnialne od piosenek Michaela Jacksona, czy Queen, tymczasem nie są w stanie sortować. I to jest coś, co ma dalszą odpowiedź w tej ankiecie niż generowanie piosenek. Bo średnia odpowiedź to jest około 2030. Żeby też była jasność: kiedy mówię „średnia”, mam na myśli medianę. Mediana to jest taki punkt, w którym połowa osób uważa, że to będzie wcześniej, połowa osób uważa, że to będzie później. No ale niektórzy uważają, że nawet do lat 40. ten cel nie zostanie jeszcze osiągnięty, a więc to wcale nie jest takie oczywiste, co jest łatwym, a co jest trudnym zadaniem dla komputera.

Na tej liście znajdują się też takie rzeczy jak na przykład wyjaśnienie swojego własnego działania, czyli AI wyjaśnia, co robi ono samo. Tutaj już te listy czasami sięgają nieskończoności, dlatego że niektórzy uważają, że to nigdy nie nastąpi. Do tego zaraz dojdziemy. Z rzeczy takich jeszcze, powiedzmy, technicznych mamy coś, co się nazywa Millennium Prize. To jest nagroda milenijna, to jest lista największych nierozwiązanych problemów matematycznych. To są wielkie problemy matematyki. No i tutaj, słuchajcie, to jest tak, 50 procent badanych uważa, że nastąpi to do roku mniej więcej 2050, natomiast nie tak wcale mała grupa ludzi uważa, że nawet jeszcze w XXII wieku nie zostanie to rozwiązane. To jest bardzo interesujące, dlatego że mówimy tutaj o najwyższym poziomie kreatywności matematycznej. Mówimy o czymś, co próbują robić tysiące ludzi na całym świecie. Ludziom się to nie udaje, genialnym matematykom się to nie udaje, a jednak jest to mimo wszystko matematyka. Interesujące jest więc przyjrzeć się temu sceptycyzmowi ekspertów. Całkiem spora grupa ludzi uważa, że jeszcze spokojnie w XXII wieku będziemy mieli nierozwiązane problemy matematyczne.

Co ciekawe, w tym samym badaniu pojawiły się też pytania związane z aktywnością fizyczną. Mamy więc na przykład coś takiego jak złożenie ciuchów po praniu, fold laundry. Mamy coś tak jak surgeon, czyli kiedy AI, i tak to zostało tutaj sformułowane, kiedy AI będzie mogło przeprowadzać operację, zostanie chirurgiem. I tutaj te przewidywania zwykle są dalsze. Natomiast może od razu powiem – będę przeplatał relacjonowanie tego badania z moim komentarzem – uważam, że to jest duży niedostatek tego badania, a mianowicie zostali zaproszeni eksperci z dziedziny sztucznej inteligencji. Tymczasem wiele z tych pytań to są tak naprawdę pytania być może lepiej adresowane do inżynierów zajmujących się robotyką.

Sztuczna inteligencja, czyli zamienianie danych A na dane B, w dużym uproszczeniu to jest jedno, natomiast chodzenie po domu i instalowanie przewodów – bo o to też pytano – złożenie figurki lego na podstawie instrukcji, składanie ubrania, operowanie na otwartym sercu, tego typu rzeczy, kierowanie pojazdem, one już wymagają oddziaływania z obiektami fizycznymi. I tutaj mam pewien problem z tym, że nie wybrzmiało to wystarczająco mocno. Osoby biorące udział w tym badaniu mogły dojść do wniosku, na podstawie tego, jak to jest sformułowane, że są pytane tak naprawdę o tę część obliczeniową danego problemu. No bo w końcu nie są to eksperci z dziedziny robotyki.

A więc nawiasem mówiąc, to już taki mój bardzo szeroki komentarz, to jest niedostatek wszystkich w zasadzie tego typu badań, które dotychczas widziałem, a mianowicie niedostatecznie mocno wybrzmiewa w tych badaniach, niedostatecznie mocno rozróżnia się kwestie teoretycznego obliczenia czegoś w trzewiach komputera, czyli skonstruowania algorytmu, programu komputerowego, który opisuje, jak powinno się przeprowadzić operację na otwartym sercu albo kierować pojazdem, albo składać pranie, a z drugiej strony jest faktyczne wyprodukowanie miliona robotów, które mogą być dostarczone użytkownikom i faktycznie w ich domach składać pranie.

Najdalsza rzecz, która tutaj się pojawia to jest full automation of labor all human jobs, czyli całkowita zdolność do automatyzacji każdej pracy wykonywanej przez człowieka. I tutaj najwcześniejsza w ogóle skala czasowa to jest rok 2060. Tylko jedna czwarta osób ankietowanych uważa, że to nastąpi wcześniej niż w 2060 roku. Ten punkt środkowy, czyli 50-50, to jest rok 2120, a ten próg sceptycyzmu, czyli ćwierć badanych uważa, że do tego roku to nie nastąpi, to już jest XXIII wiek. Krótko mówiąc, eksperci, których tutaj przepytano, są bardzo mocno sceptyczni, jeżeli chodzi o coś takiego jak pełna automatyzacja każdej pracy ludzkiej.

Przeglądam to badanie. Charakterystyczna rzecz,że pomiędzy rokiem 2022, kiedy wykonywano podobne badanie, a 2023 optymizm badaczy wzrósł. Ewidentnie wydarzyło się w ciągu ostatnich dwóch lat coś, co sprawiło, że dzisiaj badacze odpowiadają na to pytanie bardziej optymistycznie. Wciąż jeszcze miejscami dosyć sceptycznie, ale tak czy inaczej, kto wie, czy jeśli to samo badanie wykonamy za rok, czy odpowiedzi nie będą bardziej optymistyczne.

Cóż my tu mamy? Prawdopodobieństwo, że coś nastąpi do 20 lat, do roku 2043. Czyli tu już mamy nieco inaczej sformułowane pytanie. Oto jest jakaś rzecz, która mogłaby się wydarzyć, jakiś, powiedzmy sobie, milestone, albo jakaś cecha AI, i prosimy ankietowanych o odpowiedź, jak bardzo prawdopodobne jest twoim zdaniem, że to nastąpi.

Na przykład coś takiego sobie wybierzemy może mało kontrowersyjnego, o: jak bardzo prawdopodobne jest, że do roku 2043, czyli plus minus za 20 lat, AI znajdzie niespodziewane sposoby na osiąganie celów, czyli nieprzewidywane przez człowieka sposoby, żeby osiągnąć jakiś cel. Połowa osób uważa, że jest to bardzo prawdopodobne, czyli 90 procent prawdopodobieństwa. Połowa ankietowanych uznała, że jest to bardzo prawdopodobne, a łącznie 80 procent, że jest to prawdopodobne lub bardzo prawdopodobne. Krótko mówiąc, większość badanych jest przekonana, że za 20 lat AI będzie regularnie znajdować niespodziewane sposoby, żeby osiągać cele.

Bardzo podobny wynik: pytanie, czy za 20 lat AI będzie w stanie wypowiadać się jak ludzki ekspert na większość tematów. Znowu mniej więcej 80 procent uważa, że jest to albo prawdopodobne, albo bardzo prawdopodobne.

Natomiast teraz sceptycyzmy. Na przykład, czy w 2043 roku będziemy mogli zaufać AI, że wytłumaczy swoje własne działania, że precyzyjnie i prawdziwie wytłumaczy swoje własne działania. To jest szalenie ważne i szalenie interesujące w kontekście tzw. wyjaśnialnego AI. Sztuczna inteligencja zaczyna powoli infiltrować nie tylko nasze komórki i naszą rozrywkę, ale także nasze systemy decyzyjne. Mamy już testowane rozmaite algorytmy, które mają pomagać w podejmowaniu decyzji instytucjom państwowym, w profilowaniu nas. To jest skomplikowane, to jest trudne. Jednym z poważniejszych problemów jest właśnie explainability, wyjaśnialność. Jeżeli już AI nam powie, że ten i ten człowiek powinien iść do więzienia, ten i ten człowiek powinien dostać kredyt albo go powinien nie dostać, to dobrze by było, żeby towarzyszyło temu pewne wyjaśnienie, dlaczego dany algorytm uznał tak, a nie inaczej. To jest wyjaśnialność.

I tutaj, mogę od razu powiedzieć, eksperci są sceptyczni. Tylko trzydzieści kilka procent uważa, że jest to prawdopodobne, że za 20 lat AI będzie w tym sensie wyjaśnialna. Mniej więcej tyle samo uważa, że jest to nieprawdopodobne. Jest sporo niezdecydowanych. Krótko mówiąc, eksperci uważają, że jest naprawdę niepewne, czy nawet jeszcze za 20 lat AI będzie w stanie wytłumaczyć swoje własne procesy decyzyjne w prawidłowy sposób.

Z rzeczy najmniej prawdopodobnych: AI podejmie działania, żeby przejąć władzę. To jest coś, o czym się bardzo dużo mówi. To jest jeden z tych tematów, które szczególnie lubią dziennikarze, szczególnie lubią naukowcy celebryci i celebryci. Powiedzmy sobie w ten sposób: z tego badania wynika, że ludzie, którzy – możemy chyba zakładać – trochę się na tym temacie znają, są mocno sceptyczni. Tylko kilkanaście procent uważa, że jest to prawdopodobne. Wysoce prawdopodobne to jest kilka procent. Ponad 60 procent uważa, że jest to nieprawdopodobne, że za 20 lat AI będzie wykonywało jakieś działania, żeby przejąć władzę.

Mamy jeszcze parę bardziej precyzyjnych wyników dotyczących wyjaśnialności, ale nie musimy tego czytać. Jeżeli chodzi o listę lęków, eksperci zostali zapytani, które z rzeczy na liście uważacie za... Tu mamy dokładnie tak: extreme concern, substantial concern, a little concern i no concern, gdzie „concern” to jest troska, przejmowanie się czymś, niepokój. jak silny jest twój niepokój, że AI tego i tego dokona. No więc mamy tutaj takie rzeczy, których się chyba możemy spodziewać: najbardziej ankietowanych niepokoją rzeczy takie, jak dezinformacja, deepfejki, wpływanie na opinię publiczną, osoby u władzy wykorzystujące AI do wpływania na opinię publiczną itd., itd. Nieproporcjonalna korzyść dla pewnych osób, a nie dla innych, czyli wprowadzenie równowagi ekonomicznej. To są silne lęki, powiedzmy sobie.

Co nie należy do silnych lęków? Na przykład na samym dole listy niemal pełna automatyzacja pracy, która sprawi, że ludzie nie będą mieli pracy, będą mieli problemy ekonomiczne albo wręcz, że będą mieli trudność z odnalezieniem sensu w swoim życiu. Tak to zostało sformułowane, i tutaj byłem, przyznam się, zaskoczony mimo wszystko, jak wielu ekspertów, choć trochę się tego lęka, bo tu mamy ten silny lęk na poziomie dziesięć, kilkanaście procent, czyli dziesięć, kilkanaście procent uważa, że niemal pełna automatyzacja pracy w pewnym sensie zagrozi ludziom, natomiast aż około 40 procent w pewnym stopniu się tego lęka – substantial, nawet bym powiedział znacząco, nie ekstremalnie, ale znacząco. Tutaj mamy to nieco słabiej powiedziane niż wcześniej, czyli niemal pełna automatyzacja pracy. Krótko mówiąc, czy eksperci lękają się, że niektórzy ludzi będą mieli, albo nawet wielu ludzi będzie miało problem ze swoją pracą? Eksperci uważają, że jest to poważny lęk.

Natomiast wracając jeszcze, wcześniej o tym nie wspomniałem, a jest to po prostu zabawne, do tego pierwszego pytania, czyli lista milestones, czyli co jest łatwe do wykonania przez AI, co trudne, co nastąpi niedługo, a co później. Ostatnia rzecz spośród tych konkretnych milestones, tych konkretnych zadań, które miałoby AI wykonywać, czyli ta, którą zdaniem ekspertów ujrzymy najpóźniej poza tą pełną automatyzacją pracy, to jest AI researcher, czyli badacz AI. 2060 rok, niektórzy mówią 2140 rok.

Dlaczego się z tego śmieję? No dlatego, że o opinię zostali zapytani właśnie AI researchers i oni uznali, że, oj tam, chirurgia łatwiejsza do zastąpienia przez AI. Millennium Prize, najwybitniejsze osiągnięcia matematyczne, łatwiejsze niż my sami do zastąpienia. Elektryk łatwiejszy do zastąpienia. Kierowca łatwiejszy do zastąpienia. Sprzedawca łatwiejszy do zastąpienia. Śpiewak, artysta łatwiejszy do zastąpienia. Natomiast my, badacze AI, możemy spać spokojnie, ponieważ nasza praca jest najtrudniejszą pracą do zastąpienia spośród wszystkich zadań wykonywanych przez ludzi. Bardzo mnie to rozbawiło. Pokazuje jednak, że mimo wszystko to jest ankieta rozdawana ludziom i wszystkie słabości człowieka wyłażą tutaj wprost.

Jeszcze może o tym przejęciu władzy na ludzkością. Wręcz tutaj mamy human extinction. Podam może tylko pytanie o to, czy ludzkość jest zagrożona. Mamy dokładnie wyrażone to tak: jakie prawdopodobieństwo byś przyznał, przyznała scenariuszowi, w którym przyszły rozwój AI doprowadzi do wyginięcia gatunku ludzkiego lub podobnie poważnego zagrożenia lub pozbawienia władzy gatunku ludzkiego? Czyli mówimy o poważnym zagrożeniu ludzkości. Przeczytam po prostu medianę. Znowu: mediana, czyli wszyscy ci ludzie ankietowani mieli podać procent. Jak bardzo prawdopodobne jest ich zdaniem, że to nastąpi? Czyli 100 procent oznaczałoby, że na pewno to nastąpi, 0 procent, że na pewno nie nastąpi.

I teraz podam medianę. Czyli połowa ankietowanych podała niższą liczbę niż ta, połowa wyższą niż ta. Ciekawe. Jeżeli macie ochotę, zapauzujcie sobie podkast, bo to jest jedno z tych pytań, które budzą największe emocje. Może macie ochotę się nad tym zastanowić. Jak wysoko eksperci lokują to prawdopodobieństwo, że AI zagrozi ludzkości? Już mówię, 5 procent. Czyli połowa ankietowanych uznała, że prawdopodobieństwo, że to nastąpi, jest mniejsze niż 5 procent. Połowa uznała, że jest większe niż 5 procent. Później jeszcze padło pytanie, jakie jest prawdopodobieństwo, że to nastąpi w ciągu najbliższych 100 lat, i tam też mediana wynosi 5 procent.

Cóż jeszcze, jeżeli chodzi o te niebezpieczeństwa, to wymieniłbym kilka takich, które mogą zainteresować, bo one są gdzieś pośrodku tego postrzeganego poziomu ryzyka. Na przykład AI będzie w stanie dostarczać ludziom bardzo niebezpiecznych nowych narzędzi, np wirusów stworzonych metodami inżynierii genetycznej. Albo AI będzie w stanie przybliżyć katastrofę, generując nowe rodzaje potężnej broni, albo wpływać na populację. Tutaj mamy takie authortitarian rulers use AI to control their population, czyli władcy autorytarni będą korzystali ze sztucznej inteligencji, żeby kontrolować populację. I tutaj ogólnie rzecz biorąc poziom niepokoju ekspertów jest dosyć wysoki, czyli eksperci zasadniczo uważają, że jest to dosyć prawdopodobne i budzi ich niepokój.

Muszę szczerze przyznać, że – znowu teraz pozwolę sobie na komentarz osobisty – ja się temu zupełnie nie dziwię. Po prostu jest to bardzo prawdopodobne, jako że w uproszczeniu tzw. źli ludzie, nazwijmy to w ten sposób, wiecznie, zawsze korzystają z najbardziej zaawansowanej technologii, żeby zwiększyć swoją władzę. Dzisiejsi władcy autorytarni korzystają z absolutnie wszystkiego, żeby wpływać na opinię społeczną. Kiedy było fałszowanie zdjęć, to korzystano z fałszowania zdjęć – słynny przypadek fałszerstw zdjęć Stalina. Zabijanie tysięcy, milionów ludzi przy pomocy aktualnie najbardziej zaawansowanej broni – to jest absolutnie coś, co się zawsze działo. Kiedy się pojawiły czołgi, to ludzie stosowali czołgi do zabijania milionów ludzi, kiedy pojawiły się samoloty, to się zabijało samolotami, kiedy się pojawiała broń chemiczna, to bronią chemiczną. Nie dziwi mnie więc zupełnie, że to jest wysoko na liście. Jest to wręcz, mógłbym powiedzieć, niejako oczywiste, że właśnie to jest narzędziem, z którego ludzie będą chcieli korzystać również dla złych celów.

Natomiast jeżeli miałbym jakiś taki komentarz uspokajający podać, to czytałem ostatnio taki bardzo interesujący wywiad z człowiekiem zajmującym się bezpieczeństwem publicznym, którego zapytano na temat autonomicznych dronów zabójców. Technologia, o której mówimy jest następująca. Bierzemy drony, wyposażamy je na przykład w mały ładunek wybuchowy, kierunkowy, czyli coś wielkości kciuka, co wygląda jak nabój, waży kilkaset gramów, natomiast jest kierunkowym ładunkiem wybuchowym, czyli coś takiego przytknięte do głowy ludzkiej dokonuje błyskawicznego uśmiercenia człowieka, bardzo precyzyjnie.

Więc mamy dron wyposażony w coś takiego i na pokładzie jest kamera podpięta do jakiegoś algorytmu wykrywającego ludzi. Czyli na przykład scenariusz konkretny jest taki: konstruujemy tysiąc tego typu dronów albo dziesięć tysięcy, wypuszczamy je na miasto, no i dajemy hit listę, czyli listę twarzy, które mają zostać znalezione i ci ludzie mają zostać zabici albo, nie wiem, kolor skóry, albo cokolwiek, ruszamy wyobraźnią, niebieska koszula.

Tego typu scenariusz został przedstawiony temu ekspertowi. I pytanie, co on na ten temat sądzi? Powiedział, że wedle jego najlepszej wiedzy jest to scenariusz jak najbardziej możliwy technologicznie. W zasadzie mamy to, to znaczy jest już możliwość technologiczna wykonania czegoś takiego. I padło pytanie: dlaczego pan się tym nie niepokoi, brzmi pan bardzo spokojnie. I on powiedział tak: ja jako ekspert od bezpieczeństwa publicznego przede wszystkim myślę kategoriami faktycznych niebezpieczeństw, a faktyczne niebezpieczeństwo jest wtedy, kiedy są ludzie odpowiednio zmotywowani, żeby coś takiego zrobić. I jeżeli mamy ludzi odpowiednio zmotywowanych, żeby coś takiego zrobić, to wtedy pojawia się problem, i nasze zadanie polega na tym, żeby monitorować ludzi potencjalnie zdolnych do zrobienia czegoś takiego i uniemożliwiać im wykonywanie tego typu rzeczy.

Z jego punktu widzenia sytuacja się w zasadzie nie zmieniła, dlatego że środek techniczny, którym zostanie tego typu zbrodnia wykonana, jest dla niego w pewnym sensie drugorzędny. Dlatego że dla niego interesujące są wszystkie kroki poprzedzające, które zasadniczo nie uległy zmianie. On tego nie powiedział, natomiast ja to dodam, no od czasu Bliskiego Wschodu pięć tysięcy lat temu. To znaczy zasadnicze motywacje ludzkie stojące za chęcią zabicia kilku tysięcy ludzi są te same.

Co więcej, w tym momencie wracamy do wywiadu z tym człowiekiem, powiedział, że w zasadzie możliwości technologiczne, żeby coś takiego zrobić, już są od lat, tylko nieco inne. Na przykład karabin maszynowy albo bomba, albo gaz bojowy, i mamy długą, długą listę udanych aktów terroru. Mamy strzelaniny, mamy zabójstwa na zlecenie itd., itd. I on mówi, że z jego punktu widzenia tak naprawdę problem byłby wtedy, gdyby coraz więcej ludzi miało ochotę dokonywać tego typu rzeczy i coraz więcej ludzi miało motywację, żeby dokonywać tego typu zbrodni. Tymczasem on mówi, że nie widzi na razie tego typu niebezpieczeństwa. To znaczy oni pilnie monitorują wszelkie niepokojące sygnały, bardzo często uniemożliwiają ludziom wykonywanie różnych rzeczy.

Natomiast gdyby byli ludzie, którzy mają ochotę zabić kilka tysięcy ludzi w centrum jakiegoś dużego miasta, to w zasadzie zorganizowanie tego jest możliwe od bardzo, bardzo dawna. Ale wykorzystywanie do tego tak kosztownej, skomplikowanej, złożonej technologii jest dla tych ludzi niepotrzebne. Ci ludzie, jeżeli mieliby taki plan rzeczywiście, toby go już dawno zrealizowali, i wiecznie próbują go zrealizować, natomiast postrzeganie w konkretnych technologiach, takich jak drony, dodatkowego źródła zagrożenia nie spędza mu snu z powiek. Ciekawa, powiedziałbym, perspektywa. Ciekawa perspektywa pokazująca nam przy okazji i na tym chyba skończę, że tak naprawdę zawsze najsłabszym ogniwem jest człowiek.

Przypomnę, że samodzielne działanie sztucznej inteligencji, nasi eksperci, których opinie dzisiaj dla was relacjonuję, uważają za stosunkowo mało prawdopodobne. We wszystkich tych scenariuszach gdzieś tam w tle, i to nie tak głęboko w tle, są ludzie wykorzystujący konkretną technologię, rządy wykorzystujące konkretną technologię, i to na nich w pewnym sensie powinniśmy tak samo uważnie jak zawsze, ale w każdym razie uważnie patrzeć, jeżeli szukamy zagrożenia dla siebie samego, a niekoniecznie na technologię. Mówiąc nieco inaczej, patrzymy na rękę trzymającą nóż, ewentualnie rękę trzymającą młotek, a nie na nóż albo młotek. I tyle. Do tematu na pewno będziemy jeszcze wracać, bo dzieje się po prostu tyle, że aż szkoda tego nie komentować.

Dzięki, że byliście ze mną w Podkaście Tygodnika Powszechnego. Może rozważycie powiadomienie kogoś znajomego, że mamy taką fajną rzecz, jak Podkast Tygodnika. Można nas wesprzeć na Patronite. A ja, Łukasz Lamża dla Tygodnika Powszechnego, mówię wam już dziś: pa, pa, dzięki i do usłyszenia.

Projekt dofinansowany ze środków budżetu państwa, przyznanych przez Ministra Nauki i Szkolnictwa Wyższego w ramach Programu „Społeczna Odpowiedzialność Nauki II”.

Słuchaj naszych podcastów:

- Podkast Tygodnika Powszechnego — YouTube | Spotify | Apple Podcasts

- Strona świata — Jagielski Story — Spotify | Apple Podcasts

- Szkoła uczuć — Spotify | Apple Podcasts | RSS

„Tygodnik Powszechny” – jedyny polski tygodnik społeczno-kulturalny.

30 tys. Czytelniczek i Czytelników. Najlepsze Autorki i najlepsi Autorzy.

Wspólnota, która myśli samodzielnie.