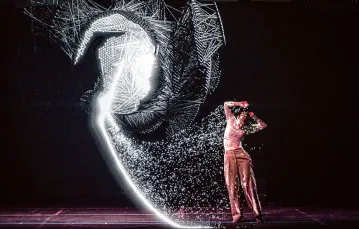

Brzmi to niczym początek niepokojącego filmu science fiction mierzącego się z potencjalnymi konsekwencjami rozwoju technologicznego, ale – wbrew pozorom – nie ma tu nic niezwykłego. Blake Lemoine, 41-letni inżynier pracujący dla Google’a, został niedawno wysłany na przymusowy urlop (co – wszystko na to wskazuje – jest tylko preludium do zwolnienia) z powodu, jak to ujęła korporacja w specjalnym oświadczeniu, „złamania reguł poufności”. Lemoine pracował przy projekcie wyjątkowo zaawansowanego chatbota – czyli sztucznej inteligencji mającej za zadanie rozmawiać z ludźmi. Rozmawiać – co w tym przypadku istotne – na jak najwyższym możliwym poziomie imitacji. Najchętniej tak wysokim, żeby ludzki interlokutor nie zdawał sobie sprawy z tego, z kim tak naprawdę konwersuje. Słowem, żeby był przekonany, że gdzieś tam, po drugiej stronie wirtualnego lustra, znajduje się przedstawiciel tego samego gatunku, nie zaś artefaktyczna sieć neuronalna zdolna do wirtuozerskiego fałszowania procesu komunikacji. To znaczy generowania zdań o poprawnej strukturze semantycznej i syntaktycznej, niebędących wszakże ekspresją procesów mentalnych żadnego świadomego bytu.

W tym właśnie punkcie historia Lemoine’a oraz programu, nad którym pracował – o roboczej nazwie LaMDA (ang. language mode for dialogue applications, czyli w dosłownym tłumaczeniu „tryb językowy do aplikacji dialogowych”) – zaczyna się robić ciekawa. Otóż, po wielogodzinnych rozmowach z chatbotem inżynier nabrał pewności, że ma do czynienia nie z wirtualną maszyną, lecz z… realnym podmiotem, którego procesy mentalne odpowiadają w przybliżeniu procesom mentalnym siedmioletniego dziecka. Założywszy, że wobec takiej kondycji mają zastosowanie zupełnie inne standardy aniżeli wobec konwencjonalnego programu, choćby i najbardziej zaawansowanego – Lemoine podjął, jak to określiła firma Google, szereg „samozwańczych agresywnych działań”. Przede wszystkim – opublikował bez zgody pracodawcy zapisy rozmów z LaMDA, które prowadził wspólnie z innymi zaangażowanymi w projekt programistami. Następnie zaczął starać się o zapewnienie chatbotowi reprezentacji prawnej, ponieważ uznał – skądinąd całkiem zasadnie – że świadoma istota, która na dodatek odczuwa emocje, powinna mieć, z racji swojego problematycznego statusu, własnego prawnika, który będzie umiał zadbać o jej interesy.

Do zatrudnienia prawnika jednak nie doszło, Lemoine został odesłany na przymusowy urlop, zespół ekspertów powołany przez Google’a natomiast orzekł, że nie ma absolutnie żadnych podstaw do przypisywania inkryminowanemu programowi świadomości. Jest to bowiem po prostu bardzo dobry program, którego wstępny projekt zakładał właśnie to, żeby komunikował się w sposób do złudzenia przypominający człowieka, w tym także żeby sam sobie rozmaite ludzkie cechy przypisywał. A właśnie na tym – i tylko na tym – łatwowiernie oparł się Lemoine, który rozmaite autodeskrypcje tak przekonująco formułowane przez LaMDA wziął za dobrą monetę.

Ale czy rzeczywiście Lemoine wykazał się tak unikalną naiwnością? Czy też może jego historia jest, wbrew pozorom, reprezentatywna i ujawnia coś istotnego o specyfice niedalekiej przyszłości świata – przenikniętego technologią i samotnością, zastępującego realne więzi imitacją więzi? Przecież znakomita część – a często większość, jak to choćby się działo w pandemii – naszych interakcji z innymi to dziś inter- akcje wirtualne. Nie widzimy żywych ludzi, widzimy tylko ciąg liter układających się w wyrazy, które z kolei układają się w zdania. Nie widzimy żywych ludzi, tylko ruchome układy pikseli. Wiele spośród głosów, które słyszymy, to głosy elektronicznie przetworzone. Dodajmy do tego rozmaite substytucje bliskości, intymności, relacji, których dookoła pełno. Cyfrowe zwierzątka, które dokarmia się kliknięciem w smartfonie, ultrarealistyczne lalki-kochanki – wykonane z tworzywa do złudzenia przypominającego ludzką skórę i wyposażone w aparaty mowy – które można zaprojektować w najdrobniejszych szczegółach, zgodnie z najbardziej wyrafinowanymi fantazjami. Elektroniczni „pracownicy” banków albo urzędów, z którymi można prowadzić rozmowy nie tylko na czacie, ale i przez telefon.

Przyznajmy – już teraz z łatwością można się w tym wszystkim pogubić. I dlatego właśnie się gubimy. I będziemy się gubić jeszcze bardziej. Dokładnie tak, jak pogubił się biedny inżynier Lemoine, z którego śmieje się teraz cały świat (w tym – z całą pewnością – niejeden inteligentny i samoświadomy chatbot...). ©

„Tygodnik Powszechny” – jedyny polski tygodnik społeczno-kulturalny.

30 tys. Czytelniczek i Czytelników. Najlepsze Autorki i najlepsi Autorzy.

Wspólnota, która myśli samodzielnie.