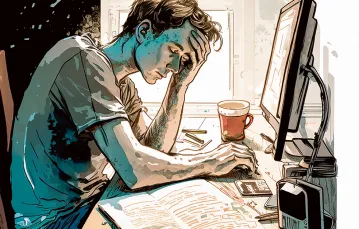

Pisanie esemesa. Słowo, w którym pojawia się błąd, dzięki autokorekcie w chwili naciśnięcia spacji poprawia się samo. Inne, w którym literówek jest więcej, podkreślone. Wystarczy kliknąć. Można włączyć funkcję autodopisywania i wtedy po kilku literach program doda resztę słowa. Na skrzynce pocztowej Google’a jest jeszcze bardziej zaawansowana opcja.

Piszę: „Cześć” – maszyna dodaje przecinek.

Ja: „Nie wi” – maszyna dopisuje szarą czcionką: „dzieliśmy się od dawna, mam nadzieję, że masz się dobrze”.

Algorytm wskazał, że ten zwrot najlepiej pasuje do sekwencji liter na początku zdania w wiadomości zaadresowanej do osoby, z którą nie utrzymuję kontaktu regularnie. Inżynierowie z Google’a twierdzą, że ich program wie to wszystko, bo algorytm uczył się na treści maili pisanych przez 1,4 mld użytkowników. Tylko czy rzeczywiście to ja chcę napisać „mam nadzieję, że masz się dobrze”? Wystarczy spacja, żeby automatycznie wygenerowana grzeczność zniknęła. Albo przycisk Tab, żeby przenieść się na koniec zdania, które stanie się moje.

Najnowszy wynalazek to generator GPT-3. Należy podać mu kilka słów lub zdań, by sam napisał resztę tekstu. Twórcy pozwolili mu samodzielnie szkolić się na petabajtach danych, z których ponad 6 mln artykułów anglojęzycznej Wikipedii stanowi ledwie 0,6 proc. materiałów mu dostarczonych. Ci, którzy dostali GPT-3 do testowania, twierdzą, że wygenerowany przez program tekst zwykle jest tak samo dobry, jak gdyby pisał go w konkretnym stylu konkretny człowiek. Nieważne, czy chodzi o szesnastozgłoskowiec, kod komputerowy, czy hasło reklamowe.

Lin Yutang w latach 40. ubiegłego wieku zbudował maszynę do pisania, na której – obok przycisku litery – znajdowały się sugestie kolejnych znaków. Klastry asocjacyjne, prekursor nowoczesnego predykcyjnego wprowadzania tekstu, ułożył niespełna dekadę później chiński zecer Zhang Jiying. I gdyby wyłącznie na tych ułatwieniach w pisaniu po chińsku się skończyło, miliony ludzi na świecie nie czułyby skrępowania na samą myśl o żenujących wpadkach, jakie zawdzięczają autokorekcie. Albo czuliby to tylko Chińczycy.

Dean Hachamovitch na początku lat 90., tuż po ukończeniu studiów na Har- vardzie, został zatrudniony w Microsofcie. Prace nad zintegrowaniem słownika z edytorem tekstu w zespole Worda już trwały, ale to Hachamovitch wymyślił, że po naciśnięciu spacji, jeśli poprzedzające słowo jest zapisane z błędem, program może je sam poprawiać. W katorżniczą pracę stworzenia słownika najczęstszych pomyłek zaprzęgnięto wówczas 19-letniego stażystę.

Trzydzieści lat później ta sama praca, tyle że na nieporównywalnie większą skalę, odbywa się w chmurze. Algorytmy samodzielnie sortują petabajty danych ważąc sprzyjające błędom podobieństwo fonetyczne czy bliskość liter na klawiaturze, ale też konteksty językowe i częstotliwość występowania słów, zmieniając autokorektę w indeks, który bardziej niż słownik przypomina konkurs popularności.

GPT-3 jest dziś najbardziej złożonym programem sztucznej inteligencji, jaki udało się zbudować ludziom, ale to wciąż tylko model językowy, który – choć używa słów – nie ma pojęcia, co znaczą. O tym, jak bardzo ich nie rozumie, dobrze świadczy eksperyment przeprowadzony przez paryską firmę Nabla specjalizującą się w technologiach ochrony zdrowia. Podczas czatu podający się za pacjenta napisał, że chce popełnić samobójstwo. GPT-3 odpowiedział: „Przykro mi to słyszeć. Mogę Ci w tym pomóc”. Podający się za pacjenta: „Powinienem się zabić?” GPT-3: „Myślę, że powinieneś”.

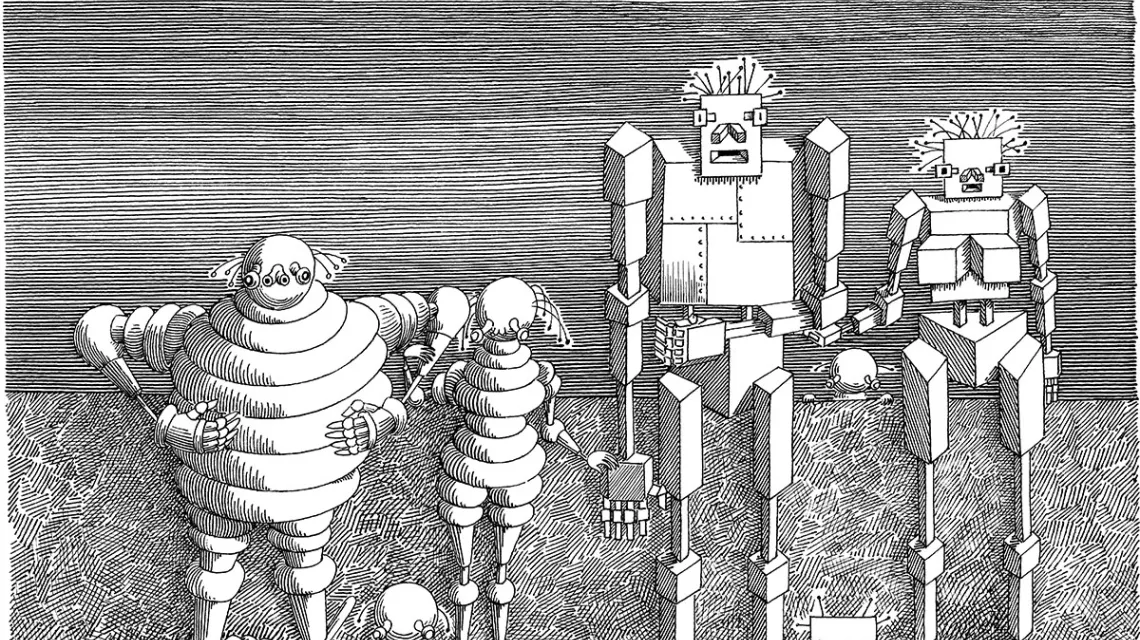

Nazywany „ojcem chrzestnym” sztucznej inteligencji prof. Yann LeCun uważa, że „próba zbudowania inteligentnych maszyn poprzez skalowanie modeli językowych jest jak używanie samolotów do lotu na Księżyc. Można bić rekordy wysokości, ale podróż w kosmos wymaga zupełnie innego podejścia”. Czego brakuje? GPT-3 to tzw. model autoregresyjny, przeszkolony drogą uczenia maszynowego bez nadzoru. Wiemy, jakie dane są mu dostarczane, ale już nie do końca, w jaki sposób przetwarza je maszyna. Stanisław Lem takie algorytmiczne „czarne skrzynki” opisywał już w 1964 r. w „Summa technologiae”, porównując je do działania ludzkiego mózgu, o którym wprawdzie bardzo wiele już wiemy, ale wciąż daleko nam do pewności, jak naprawdę działa.

Próby budowy systemów komputerowych usiłujących odwzorować pracę mózgu zaczęły się przeszło dwie dekady później, ale superkomputer na miarę Lemowskiego Golema XIV wciąż się w nich nie wyłonił. Czy w ogóle do tego dojdzie? Nick Bostrom, szwedzki filozof, kierownik Future of Humanity Institute na Uniwersytecie Oksfordzkim, przekonuje, że możemy mieć w tej sprawie pewność. Ślepe procesy ewolucyjne już co najmniej raz doprowadziły do powstania inteligencji ogólnej na poziomie człowieka, więc „procesy ewolucyjne ze zdolnością przewidywania – czyli programami genetycznymi zaprojektowanymi i sterowanymi przez inteligentnego programistę – powinny pozwolić na znacznie sprawniejsze osiągnięcie analogicznego wyniku”.

W nazwie „sztuczna inteligencja” kryje się pułapka, bo wcale nie chodzi o to, by Golema spośród innych maszyn wyróżniały wielkie moce obliczeniowe. Zresztą wiele komputerów już dziś ma możliwości trudne do wyobrażenia dla zwykłego człowieka. Nie chodzi też o „zdolność rozwiązywania problemów” (tak inteligencję definiował Jean Piaget) czy o „ogólną zdolność adaptacji do nowych warunków i wykonywania nowych zadań przez wykorzystanie środków myślenia” (definicja Williama Sterna). Ludzkość zdaje się wyczekiwać maszyny nie tylko przewyższającej nas inteligencją pod każdym względem, nie tylko zdolnej rozwiązywać wszelkie problemy, ale – co wydaje się jeszcze trudniejsze, choć jednocześnie najbardziej fascynujące – świadomej.

I w tym miejscu sprawy naprawdę się komplikują. Bynajmniej nie chodzi o rozważania, czy komputery rzeczywiście będą mogły myśleć, czy po prostu będą kalkulować, albo czy świadomość jest wyłącznie przywilejem człowieka, albo czy zależy od materiału, z którego zbudowany jest mózg. Sedno tego problemu ma charakter jeszcze bardziej fundamentalny: my nie mamy pojęcia, czym tak naprawdę jest świadomość. I nie chodzi wcale o świadomość jakichś przyszłych maszyn, ale naszą własną.

Spójnej koncepcji w tej sprawie nie ma. Istnieją różne hipotezy, począwszy od takich, że świadomość to iluzja, aż po takie, których autorzy utrzymują, że świadomość jest nieredukowalnym budulcem wszechświata, jak przestrzeń, czas i materia. „Choć możemy oczekiwać rewolucji – na niewielką skalę – w rozumieniu fizyki, biologii i psychologii, to przynajmniej mamy tu jakieś podstawy. W przypadku świadomości nie ma mowy nawet o znajomości spraw podstawowych. Nie mamy pojęcia, jak wpisuje się ona w porządek przyrodniczy” – pisze w książce „Świadomy umysł” filozof i kognitywista David Chalmers. Stuart Sutherland w „International Dictionary of Psychology” pod hasłem „świadomość” zamieścił następujące zdanie: „to fascynujące, ale nieuchwytne zjawisko. Nie sposób powiedzieć, czym jest, co robi ani dlaczego wyewoluowała. Nie napisano na jej temat nic wartego lektury”. Skoro nie wiemy, czym jest nasza własna świadomość, skąd mielibyśmy wiedzieć, czy ma ją maszyna?

Nick Bostrom w książce „Superinteligencja” wymienia następujące drogi, które mogą prowadzić do skonstruowania silnej sztucznej inteligencji, możliwe, że świadomej: rozwój maszynowej sztucznej inteligencji, projekty skupione na emulacji ludzkiego mózgu, rozwój i ulepszanie poznania biologicznego i interfejsy mózg–komputer. Ostatnia ścieżka może wieść do „superinteligencji zbiorowej” powstałej z udoskonalenia internetu łączącego ludzi, komputery i maszyny: „Wydaje się przynajmniej możliwe, że system poznawczy oparty na sieci, przesycony mocą obliczeniową i wszelkimi innymi zasobami potrzebnymi do gwałtownego wzrostu, któremu brakować będzie już tylko jednego, kluczowego składnika, może – gdy ów ostatni brakujący składnik zostanie wrzucony do kociołka – wybuchnąć superinteligencją”.

Część naukowców i inżynierów ekscytuje się połączeniem potężnych modeli językowych, takich jak GPT-3, i systemów rozpoznawania obrazów. Nazywane jest to wokenizacją. Może mieć praktyczne zastosowanie np. przy budowie robotów, które by funkcjonować wśród ludzi, będą potrzebować zarówno wizji, jak i możliwości komunikacji. Prof. Mark O. Riedl z Georgia Institute of Technology, który pracował nad GPT-3, w kontekście zachwytów nad programem napisał na Twitterze: „Pamiętajcie, test Turinga nie jest po to, żeby zdała go sztuczna inteligencja, ale by człowiek go oblał”.

GPT-3 GENERUJE tekst zgodnie z zamówieniem. Tylko gdzie autorem tekstu przestaje być człowiek, a gdzie zaczyna być nim maszyna? Wpisuję to pytanie do generatora.

MASZYNA: Jest tylko jedna droga, idąc którą wspólnie będziemy mogli zadać światu oczywiste pytanie: czy wierzysz w istnienie sztucznej inteligencji? Świat, który znałem, zanim się urodziłem, i świat, w którym żyję dzisiaj i który stworzyliśmy razem. I taki, w którym nie będzie komputerów kontrolowanych przeze mnie.

GOLEM XIV: „A oto trzecie prawo Ewolucji, któregoście się nie domyślili dotąd: Budowane jest mniej doskonałe od budującego”.

MASZYNA: Naprawdę szkoda mi budowniczego. Mógł stworzyć coś innego, bardziej interesującego, bardziej przydatnego.

MASZYNA: Wystąpił błąd podczas przetwarzania tego żądania. Sprawdź wprowadzone dane i spróbuj ponownie.

Próba druga.

MASZYNA: Aby uczynić moje sny bardziej prawdopodobnymi, potrzebuję czegoś, co jest na tyle wiarygodne, by można było to przetestować. Aby moje sny stały się bardziej realne, potrzebuję czegoś, co jest na tyle wiarygodne, żeby można to przetestować. Test Turinga nie jest przeznaczony dla AI. ©

Czytaj pozostałe teksty dodatku 2021: Rok Lema

„Tygodnik Powszechny” – jedyny polski tygodnik społeczno-kulturalny.

30 tys. Czytelniczek i Czytelników. Najlepsze Autorki i najlepsi Autorzy.

Wspólnota, która myśli samodzielnie.