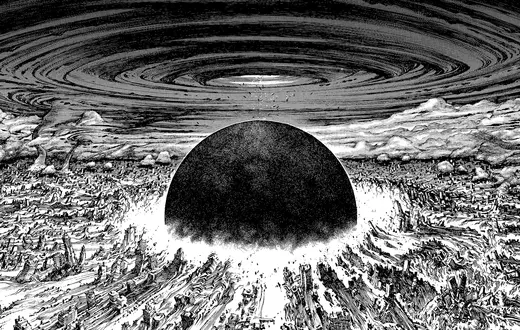

Przedstawiciele 28 państw i firm przyjechali do Bletchley Park, gdzie w czasie wojny łamano szyfry Enigmy. I po dwóch dniach się rozjechali, zapowiadając, że niedługo wrócą do debaty nad „potencjalnie katastrofalnym zagrożeniem” dla ludzkości. Tak można podsumować brytyjski szczyt dotyczący bezpiecznego stosowania sztucznej inteligencji.

Rząd w Londynie zapewnia, że „Deklaracja z Bletchley” przejdzie do historii, bo to pierwszy dokument, w którym zapowiedziano identyfikację „ryzyk związanych z bezpieczeństwem AI”. Tyle że choć wśród sygnatariuszy są przedstawiciele m.in. USA, Kanady i UE, to już nie Chin – jednego z gigantów prac nad AI. Nie ma też niczego odkrywczego w twierdzeniach, że wielkie modele generatywne, jak ChatGPT, mają „potencjał poważnego, a nawet katastroficznego szkodzenia”.

Przed szczytem w Bletchley prezydent USA dekretem zobowiązał amerykańskie firmy m.in. do ujawniania wyników testów bezpieczeństwa swoich systemów AI. Joe Biden oczekuje, że Narodowy Instytut Standardów i Technologii opracuje „rygorystyczne” standardy testowania AI, by nie potęgowała ona zagrożenia dla infrastruktury krytycznej czy nie ułatwiała prac nad bronią masowego rażenia.

Deklaracja z Bletchley i dekret Bidena spotkały się z krytyką ojców chrzestnych współczesnej sztucznej inteligencji, Andrew Nga z Uniwersytetu Stanforda (współzałożyciela Google Brain) i Yanna LeCuna z New York University (szefa sztucznej inteligencji Meta). Ich zdaniem dyskurs o AI jako zagrożeniu dla ludzkości to sprytna zagrywka… wielkich koncernów technologicznych. Strasząc hipotetycznymi, odległymi zagrożeniami, odwracają uwagę od szkód, jakie ich technologie powodują tu i teraz: plagi fake newsów czy drastycznej cyfrowej inwigilacji. Ich zdaniem nowe przepisy poskutkują tylko wycięciem konkurencji pracującej nad transparentną, otwartą AI.

„Jeśli ta kampania strachu odniesie skutek, z pewnością doprowadzi do czegoś, co nazwałbym katastrofą: mała liczba firm będzie kontrolować AI” – tweetował LeCun.

Można uznać, że AI to zupełnie nowe pole, a każda technologia jest inna. Tyle że po dekadach doświadczeń w tworzeniu regulacji prawnych powstały pewne fundamentalne zasady, które pomogłyby uregulować także stosowanie sztucznej inteligencji. Są wśród nich wymóg przejrzystości czy stanowienia prawnie wiążących standardów monitorowania. Dobrym przykładem funkcjonowania takich ogólnych zasad jest… samochód. Choć zmienił życie miliardów ludzi, jego używanie może powodować także poważne szkody. By je minimalizować, producenci muszą stosować się do norm bezpieczeństwa, a kierowcy − ubezpieczać pojazdy i zdobyć uprawnienia do ich prowadzenia.

Regulacje pozwalają technologiom się rozwijać i chronią ludzi. Poleganie wyłącznie na dobrowolnej współpracy jest niewystarczające. Szczególnie, że dziś mamy do czynienia z „potencjalnie katastrofalnym zagrożeniem” dla ludzkości, a jedynymi, którzy testują to ryzyko, są podmioty, które takie technologie rozwijają.

„Tygodnik Powszechny” – jedyny polski tygodnik społeczno-kulturalny.

30 tys. Czytelniczek i Czytelników. Najlepsze Autorki i najlepsi Autorzy.

Wspólnota, która myśli samodzielnie.