Na froncie debaty publicznej trwa wyścig zbrojeń. Wybory w Polsce, zarówno te, które mamy za sobą, jak i te czekające nas w 2024 roku, odbywają się już w świecie manipulacji i propagandy wspieranej przez potężne technologie. Czy jako państwo i obywatele jesteśmy gotowi stawić im czoło? Czy zdołamy ocalić reguły, od których zależy nasza wolność?

Oto szósty, finałowy odcinek uhonorowanego nagrodą Grand Press Digital and Technology 2023 cyklu WybierAI: algorytmy demokracji autorstwa Agaty Kaźmierskiej i Wojciecha Brzezińskiego – dziennikarzy „Tygodnika” nominowanych właśnie do przyznawanej przez Amnesty International Polska nagrody „Pióro Nadziei 2023”. W cyklu tym przyglądamy się nowym zagrożeniom dla wolnych wyborów w Polsce i demokratycznym świecie.

W poprzednim odcinku:

25 tys. mieszkańców stanu New Hampshire pod koniec stycznia odebrało telefon z Białego Domu. W przeddzień prawyborów prezydenckich, organizowanych w tym stanie przez Partię Demokratyczną, do zarejestrowanych wyborców tego ugrupowania dzwonił osobiście Joe Biden. Miał dość niezwykłą prośbę. „To wszystko klituś-bajduś – zaczął, posługując się swoim ulubionym słowem (malarkey), by dalej przekonywać: – Oddanie głosu w najbliższy wtorek pomoże Republikanom doprowadzić do ponownego wyboru Donalda Trumpa. Wasz głos liczy się w listopadzie, a nie teraz”.

W tym miejscu powinny wyświetlić się multimedia. Nie jest to jednak możliwe ze względu na Pani/Pana wybór preferencji plików cookies. W przypadku chęci wyświetlenia całości materiału wraz z multimediami niezbędna jest zmiana wybranych wcześniej preferencji.

Prezydent apelujący do swoich wyborców, by na niego nie oddawali głosów, choćby w prawyborach, które i tak miał w kieszeni? Dość nietypowa taktyka wyborcza.

Dzwoniącym nie był oczywiście Joe Biden. Jego głos został wygenerowany przez narzędzia sztucznej inteligencji stworzone przez firmę ElevenLabs (założoną przez dwóch polskich inżynierów, Piotra Dąbrowskiego i Mateusza Staniszewskiego). Ktoś wykorzystał powszechnie dostępną aplikację, by sklonować głos prezydenta i włożyć w jego usta przekaz zniechęcający Demokratów do głosowania.

W tym miejscu powinny wyświetlić się multimedia. Nie jest to jednak możliwe ze względu na Pani/Pana wybór preferencji plików cookies. W przypadku chęci wyświetlenia całości materiału wraz z multimediami niezbędna jest zmiana wybranych wcześniej preferencji.

Prokurator Generalny stanu New Hampshire John Formella szybko zidentyfikował autorów deepfake’a. Równie szybko zbanowało ich ElevenLabs, pisząc w oficjalnym oświadczeniu w tej sprawie, że „jest zdecydowana zapobiegać nieprawidłowemu wykorzystywaniu jej narzędzi”. Taki sam cel stawia sobie Federalna Komisja Komunikacji (FCC), która już zapowiedziała, że „wykorzysta wszystkie dostępne środki, by amerykańskie sieci komunikacyjne nie były używane do szkodliwego wykorzystania technologii sztucznej inteligencji”.

Fałszywy telefon od prezydenta Bidena to oczywiście nie jedyny taki przypadek. Ostatnio jedną z najgłośniejszych takich spraw było krążące na Twitterze nagranie, na którym widać Taylor Swift – piosenkarkę, która właśnie zdobyła najważniejsze nagrody na ceremonii rozdania Grammy – gdy na czerwonym dywanie pozuje z transparentem „Trump wygrał, Demokraci oszukali!”. Transparent był, rzecz jasna, fałszywy. Ale nagranie zobaczyło ponad 5 mln użytkowników.

AWWW... THANK YOU!!!😂😂😂 pic.twitter.com/hAGQG2BSBP

— il Donaldo Trumpo (@PapiTrumpo) February 5, 2024

W tym miejscu powinny wyświetlić się multimedia. Nie jest to jednak możliwe ze względu na Pani/Pana wybór preferencji plików cookies. W przypadku chęci wyświetlenia całości materiału wraz z multimediami niezbędna jest zmiana wybranych wcześniej preferencji.

Mleko już się rozlało i w sieci regularnie będziemy się natykali na podobne nagrania. Tego rodzaju brudne sztuczki staną się trwałym elementem politycznych kampanii. Nie tylko w USA.

Materialność demokracji: AI trzeba zaprząc do prac społecznie użytecznych

– O deepfake’ach mówi się dużo, ale ludzie produkują fałszywki od dawna przy pomocy Photoshopa i innych narzędzi – mówi „Tygodnikowi” prof. Aleksander Mądry, wykładowca Massachusetts Institute of Technology i kierownik Działu Gotowości OpenAI, dodając: – Na pewno coraz więcej będzie takich nagrań, ale nie sądzę, by kolejny obrazek pokazujący, jak polityk mówi coś, o czym wszyscy wiedzą, że tego nie powiedział, miał wiele zmienić.

Realne zagrożenie jest gdzie indziej. Zdaniem profesora ma ono wynikać ze zdolności narzędzi sztucznej inteligencji do generowania zindywidualizowanej perswazji na wielką skalę i symulowania powszechnego poparcia dla danej partii, kandydata czy inicjatywy.

– Potencjalnie takie programy można wykorzystać do symulowania 10 czy 100 tys. użytkowników mediów społecznościowych. Takie boty miałyby swoje osobowości, wchodziły w relacje z innymi ludźmi, przez co ich polityczne przekazy mogą być o wiele bardziej efektywne – wyjaśnia prof. Aleksander Mądry.

Jego zdaniem sztuczna inteligencja raczej nie będzie lepsza w perswazji niż ludzie, ale dzięki takim narzędziom jeden człowiek może nadzorować 100 czy tysiąc botów. – I ilość przejdzie w jakość – wyjaśnia badacz.

Wpływ sztucznej inteligencji na działanie demokracji może jednak sięgać znacznie dalej i zmieniać ją fundamentalnie. Także na lepsze.

„Wyspecjalizowana sztuczna inteligencja wpływa na coś, co filozofowie technologii nazwaliby materialnością demokracji” – pisze Mathias Risse, dyrektor Carr Center for Human Rights Policy Uniwersytetu Harvarda w artykule naukowym pt. „Artificial Intelligence and the Past, Present, and Future of Democracy”, wyjaśniając, że takie programy zmieniają zachowanie ludzi i sposób, w jaki podejmują oni decyzje. „Sztuczna inteligencja i demokracja nie są »naturalnymi sojusznikami«. By AI służyła demokracji, wymaga aktywnych decyzji już na etapie jej projektowania i dużej woli politycznej”.

Kilka państw podjęło już takie decyzje i z powodzeniem wykorzystuje systemy informatyczne do zmiany sposobu funkcjonowania ich systemu politycznego.

Potencjał publiczny: rewolucja AI w instytucjach

W 2015 r. tajwański rząd doszedł do ściany. Władze chciały zalegalizować sprzedaż alkoholu online, ale wiele miesięcy rozmów z handlowcami, platformami internetowymi i przedstawicielami społeczeństwa obywatelskiego nie doprowadziło do kompromisu. Prace nad regulacjami ugrzęzły w miejscu. Dyskusję celowo przeniesiono więc do nowo powstałej platformy vTaiwan – projektu, który miał umożliwić obywatelom rzeczowe dyskusje nad problemami społecznymi i ich możliwymi rozwiązaniami. W ciągu kilku tygodni debata, w której wzięli udział aktywiści, politycy i zwykli obywatele, pozwoliła wypracować rozwiązanie zadowalające niemal wszystkich. Sprzedaż alkoholu miała być dostępna jedynie w kilku platformach, wszystkie transakcje miały być dokonywane przy pomocy kart kredytowych, a zamówienia miały być odbierane osobiście w sklepach spożywczych, by była pewność, że alkohol nie trafi do nieletnich.

W kolejnych latach debaty na vTaiwan, przy łącznym udziale 200 tys. obywateli, doprowadziły do wypracowania 26 projektów aktów prawnych. Skończyło się jednak na wielkim rozczarowaniu, bo rządzący nie wzięli tego pod uwagę. „Skoro rząd nie był zobowiązany do przyjęcia rekomendacji, politycy nie potraktowali ich poważnie” – napisał Jason Hsu, współtwórca vTaiwan i były tajwański parlamentarzysta.

Prof. Beth Simone Noveck, badaczka z Northeastern University, której praca skupia się na pozytywnych interakcjach sztucznej inteligencji i demokracji uważa, że vTaiwan składała się z czterech równoległych systemów, których obsługa dla wielu użytkowników mogła być zbyt skomplikowana. Zasadniczy problem leżał jednak gdzie indziej: „Sukces projektu mógł zagrażać politycznemu status quo i stać się wyzwaniem dla tradycyjnych form podejmowania decyzji oraz wykorzystywania władzy politycznej” – napisała Noveck. Co ciekawe, podobnie było w Madrycie, gdzie platforma Decide Madrid miała pomagać mieszkańcom w angażowaniu się w podejmowanie decyzji o przyszłości miasta. Mimo że skorzystało z niej pół miliona mieszkańców, którzy przedstawili łącznie 28 tys. propozycji zmian przepisów, ostatecznie w życie weszła tylko jedna.

Mimo to, autorzy takich projektów pozostają optymistami. Colin Megill, założyciel Pol.is – platformy do prowadzenia internetowych sondaży, która była jednym z elementów vTaiwan – podkreśla, że to zaledwie pierwsze kroki. „Zastosowanie inteligencji maszynowej w demokracji deliberatywnej stwarza pokoleniową szansę na zmianę procesu kształtowania polityki na całym świecie” – stwierdza.

„Chociaż sztuczna inteligencja stwarza ryzyko – potencjalnie egzystencjalne – oferuje również możliwości odwrócenia dziesięcioleci niedoinwestowania potencjału publicznego, przy jednoczesnym ożywieniu procesu demokratycznego” – pisze analityk Chatham House Alex Krasodomski, podkreślając, że algorytmy mogą stać się „siłą napędową rewolucji w zakresie responsywnych, innowacyjnych instytucji publicznych” – od lokalnych bibliotek po organizacje międzynarodowe. „Aby jednak to osiągnąć, rola rządu musi wykraczać poza zwykłe regulacje i zmierzać w stronę wdrażania publicznych systemów sztucznej inteligencji”.

Wielka Demokratyczna Utopia AI

– Widzę dwa sposoby, na jakie sztuczna inteligencja może stanowić część rozwiązania problemów w sferze politycznej – mówi nam prof. Mądry. Jednym jest zmiana natury debaty społecznej i demokracji reprezentatywnej, bo daje nam możliwość prowadzenia obywatelskich dyskusji na każdym poziomie i z dużą dokładnością. Po drugie, niesamowite w tej technologii jest to, jak bardzo może poszerzyć nasze zrozumienie rzeczywistości. GPT i inne modele można poprosić o wytłumaczenie skomplikowanych zagadnień nawet na poziomie zrozumiałym dla dziesięciolatka. Z drugiej strony, musimy myśleć krytycznie i nie pozwolić, by ChatGPT dyktował nam, jak interpretować rzeczywistość. Tu wracamy do problemu edukacji politycznej i obywatelskiej oraz tego, by uczyć ludzi krytycznego korzystania z takich produktów.

Bruce Schneier, specjalista od cyberbezpieczeństwa z Uniwersytetu Harvarda, szansę dostrzega również w angażowaniu sztucznej inteligencji w procesy legislacyjne. System prawny jest w końcu rodzajem algorytmu regulującego społeczeństwo. Komputery są w stanie o wiele skuteczniej wyłapywać powiązania pomiędzy poszczególnymi aktami prawnymi i łączyć je w spójny system. Choć mogą robić też coś dokładnie odwrotnego.

– Sztuczna inteligencja będzie w stanie stworzyć luki w przepisach, potencjalnie zbyt skomplikowane, by ludzie mogli je łatwo zauważyć – mówi „Tygodnikowi” Schneier.

Dokąd miałby doprowadzić nas ten proces? Risse nazywa go Wielką Demokratyczną Utopią AI. „Sztuczna inteligencja zna preferencje i poglądy wszystkich osób oraz dostarcza ludziom odpowiednich informacji, dzięki czemu stają się kompetentnymi uczestnikami sprawowania rządów. Umożliwia dyskusję ludzi o odmiennych przekonaniach, ułatwiając wzajemne usłyszenie się. Sztuczna inteligencja gromadzi głosy, co eliminuje wyzwania związane z dotarciem do lokali wyborczych, zliczeniem głosów itp. Monitorując to wszystko, sztuczna inteligencja może też natychmiast zidentyfikować oszustwo lub korupcję oraz oznaczyć lub usunąć stronnicze raporty, lub wprowadzające w błąd argumenty. Może poprawić legitymację proceduralną poprzez zwiększone uczestnictwo w procesach demokratycznych, a jednocześnie wyborcy staną się lepiej poinformowani – będą nie tylko wybierać jednego kandydata z listy”.

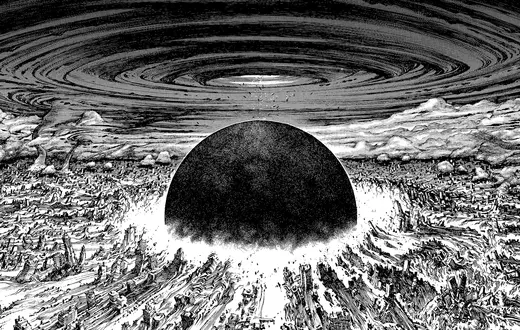

Brzmi idyllicznie. Risse przestrzega jednak, że taka utopia, jak to zwykle z utopiami bywa, ma też mroczną stronę. „Taka przyszłość zakłada, że dla całego szeregu kwestii istnieje najinteligentniejsze rozwiązanie, którego z różnych powodów nie udało nam się zastosować w praktyce. Zezwolenie algorytmom na dokonywanie takich ocen i decyzji niesie ze sobą niebezpieczeństwa. Może to oznaczać pranie mózgu ludzi i degradowanie inteligentnych istot do roli osób reagujących na bodźce (...) Nie powinniśmy zapominać, że u zarania ery cyfrowej znajdziemy także »Rok 1984« Orwella”.

To nie nowinka, to projekcja siły. Czas na zmianę sposobu myślenia o AI

Od coraz większego udziału nowych technologii w procesach demokratycznych nie uciekniemy. A to oznacza, że wielcy technologiczni gracze stają się w coraz większym stopniu graczami politycznymi. Działania Elona Muska, który w kluczowym momencie wyłączył Ukrainie dostarczony przez siebie system Starlink, by uniemożliwić atak na rosyjską flotę w Sewastopolu, może być tylko przedsmakiem ich przyszłych możliwości.

„Sztuczna inteligencja to nie tylko zwykłe oprogramowanie. To zupełnie nowy sposób projekcji siły. W niektórych przypadkach wywróci to do góry nogami istniejące władze, w innych je umocni. Co więcej, jej rozwój napędzany jest nieodpartymi bodźcami: każdy naród, korporacja i jednostka będzie chciała jakiejś jej wersji” – pisze w artykule w „Foreign Affairs” Mustafa Suleyman, współzałożyciel brytyjskiego laboratorium AI Deep Mind. „Jeśli globalne zarządzanie sztuczną inteligencją ma stać się możliwe, system międzynarodowy musi odejść od tradycyjnych koncepcji suwerenności i powitać przy stole firmy technologiczne. Podmioty te mogą nie czerpać legitymizacji z umowy społecznej, demokracji lub zapewniania dóbr publicznych, ale bez nich skuteczne zarządzanie sztuczną inteligencją nie będzie możliwe”.

Prof. Mądry widzi jednak tę kwestię zupełnie inaczej.

– Możemy przyjmować optymistyczny obraz świata i mówić, że korporacje zadbają o to, by było dobrze i nie ma czym się martwić – komentuje. – OpenAI rzeczywiście wiele uwagi poświęca konsekwencjom sztucznej inteligencji i planuje różne rozwiązania. Tyle że OpenAI ma bardzo wyjątkową strukturę, nie jest klasyczną korporacją dla zysków, lecz nadzorowane jest przez radę nadzorczą, która pilnuje, by jej działania były zgodne z misją. Tak jednak nie jest w przypadku Google’a, Microsoftu czy Amazona, bo są to typowe korporacje, których zadaniem jest zwiększanie wartości firmy. To powoduje, że nie powinniśmy przekazywać kontroli i odpowiedzialności za tak niesamowicie ważną technologię wyłącznie jej twórcom. Potrzebujemy odpowiedniej, politycznej interwencji – podkreśla badacz.

Jego zdaniem najważniejszą rzeczą, jaką politycy muszą zrobić i do czego muszą dojrzeć, jest zmiana sposobu myślenia o sztucznej inteligencji.

– To temat wciąż traktowany jako nowinka techniczna, która na razie jest czymś nieokreślonym – mówi. – Oni muszą przede wszystkim zrozumieć, i to naprawdę głęboko, że to nie jest przyszłość, że to dzieje się już tu i teraz oraz wpływa na tak wiele procesów, że zmieni wszystko. Nie możemy po prostu zapomnieć o sprawie i liczyć, że jakoś się ułoży. To, co stało się z mediami społecznościowymi, dokładnie pokazuje, do czego takie podejście prowadzi.

„Tygodnik Powszechny” – jedyny polski tygodnik społeczno-kulturalny.

30 tys. Czytelniczek i Czytelników. Najlepsze Autorki i najlepsi Autorzy.

Wspólnota, która myśli samodzielnie.