Od dziesięcioleci fantastyka karmi nas wizjami robotów-kamerdynerów i maszyn-gospoś, które, jak w kreskówce „Jetsonowie”, wykonują za nas te wszystkie drobne, irytujące domowe prace stojące między nami a idyllą słodkiego nieróbstwa. Cel jest już prawie w zasięgu ręki. Tyle że mózgi maszyn, które mogą nas odciążyć, na razie są zajęte... oglądaniem telewizji.

Największy problem solniczki

Ale najpierw musimy poradzić sobie z buntem robotów. Zaczął się wyjątkowo niepozornie, od solniczki na kółkach i spuchniętej stopy. Solniczka to 150-kilogramowy, biały robot-ochroniarz Knightscope K5. Wyposażony w baterię czujników i kamer robot patrolował centrum handlowe Stanford w Dolinie Krzemowej, kiedy napotkał na swojej drodze przeciwnika nie do pokonania: 16-miesięcznego chłopca. Dziecko pobiegło w prawo, by, gdy robot wykonał zwrot, nagle zmienić kierunek. Zdezorientowany robot potrącił chłopca i przejechał jeszcze kawałek, przetaczając się jednym z kół po jego stopie.

Maszyna nie poradziła sobie z sytuacją, z którą rodzic musi radzić sobie dziesiątki razy na godzinę. Spuchnięta stopa 16-miesięcznego Harwina Chenga to bolesna (na szczęście obyło się bez złamań) ilustracja największego problemu przy budowie robota-gosposi. Roboty lubią przewidywalność. Ludzie, i ci mniejsi, i ci więksi, przewidywalni nie są.

Same maszyny są coraz doskonalsze. Wystarczy spojrzeć na wyniki „igrzysk robotów” zorganizowanych przez agencję zaawansowanych programów badawczych Pentagonu – DARPA. Od 2012 do 2015 r. twórcy najbardziej zaawansowanych robotów świata rywalizowali na torze przeszkód, mającym odtwarzać sytuacje rodem z prawdziwej akcji ratowniczej. Robot miał przejechać odcinek pojazdem, przejść przez gruz, wejść po schodach, otworzyć drzwi, zakręcić zawór i wywiercić otwór wiertarką.

Co prawda wykonanie tych zadań człowiekowi zajęłoby może dwie minuty, a zwycięska maszyna potrzebowała 44 minut, co prawda filmy z upadkami, wywrotkami i atakami robociej katatonii zbierały na YouTubie setki tysięcy widzów, ale sam konkurs był dowodem na to, że mechaniczne ciała potrafią już doskonale radzić sobie w środowiskach, które w żaden sposób nie były przystosowane do ich potrzeb. Gorzej z mózgami. Bo komputer stosunkowo łatwo poradzi sobie ze statycznym torem. Radzenie sobie z ludźmi to inna sprawa.

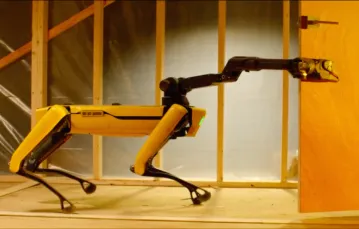

Doskonale widać to na przykładzie Spota Mini firmy Boston Dynamics. Robotycy, którzy dotąd słynęli z budowania dużych, ciężkich maszyn przypominających juczne zwierzęta i mających wspierać amerykańskich żołnierzy podczas pieszych patroli, tym razem skonstruowali metalowe zwierzę wielkości owczarka niemieckiego. Spot, dokładnie jak Rosie z „Jetsonów”, ma w założeniu pomagać przy pracach domowych – na demonstracyjnym filmie całkiem sprawnie pakuje brudne naczynia do zmywarki, biega po schodach, radzi sobie nawet ze skórkami od banana na podłodze.

Ale problem zaczyna się, gdy przychodzi czas na interakcję z człowiekiem. Robot najpierw podaje puszkę coli „właścicielowi” tylko po to, by sekundę później spróbować wyszarpać mu ją z dłoni. Ewidentnie źle odczytuje jego intencje. Rezultat to kolejny bunt maszyn w skali mikro.

Po co maszynie seriale

„Jeśli chcesz, żeby robot pracował w twoim własnym domu, musisz wyposażyć go w jakąś podstawową umiejętność przewidywania – mówił na łamach „MIT Technology Review” Carl Vondrick, badacz sztucznej inteligencji z MIT. – Np. jeśli ty zaczynasz siadać, robot musi wiedzieć, że to nie jest właściwy moment na odsunięcie krzesła”.

Zespół Vondricka postanowił więc nauczyć roboty rozumienia ludzkich zachowań i ich przewidywania. Źródło wiedzy? Telewizja. Naukowcy kazali komputerowi wyposażonemu w algorytm zdolny do uczenia się – podobny do tego, który pokonał niedawno w grę Go ludzkiego arcymistrza – oglądać setki godzin programów telewizyjnych. „Biuro”, „Hoży doktorzy” czy „Gotowe na wszystko” umożliwiły maszynie podglądanie ludzkich zwyczajów. Komputer sam, bez wkładu człowieka, miał spróbować zrozumieć, co się dzieje na ekranie.

„Ludzie nie potrzebują tysięcy przykładów, żeby zrozumieć np., czym jest pocałunek, wystarczy kilka – zauważa Vondrick. – Zaletą naszego rozwiązania jest to, że niczego nie narzucamy, nie podpowiadamy, tutaj to maszyna sama opracowuje swoje reguły służące do interpretacji świata”.

Po 600 godzinach oglądania telewizji komputer, gdy przedstawiono mu scenki rodzajowe pozbawione zakończenia, w 43 procentach przypadków był w stanie prawidłowo odgadnąć to, co nastąpi za chwilę. Mało? 10-letni człowiek dysponuje doświadczeniami zebranymi przez 60 tysięcy godzin funkcjonowania na jawie. Komputerowi trzeba dać jeszcze trochę czasu – i hasło do Netflixa.

Duch w pancerzu

Do podobnych badań przyłożył rękę także najlepszy kandydat na współczesnego następcę Edisona, czyli Elon Musk. Inżynier- -miliarder, twórca firm Tesla czy SpaceX, rok temu publicznie wieścił, że sztuczna inteligencja (AI) jest największym egzystencjalnym zagrożeniem dla naszego gatunku. Ale jednocześnie finansuje organizacje, które mają stworzyć „przyjazne” AI.

Jedna z nich, stworzona w grudniu fundacja Open AI, ogłosiła właśnie, że pracuje nad oprogramowaniem, które może pomóc w stworzeniu robota „ogólnego zastosowania”, będącego w stanie rozumieć naturalną mowę i funkcjonować wśród ludzi. Słowem – bagatela – chcą Świętego Graala badań nad sztuczną inteligencją.

„Rzeczy, które dla nas są banalnie proste, są łatwe, bo od milionów lat pracowała nad nimi ewolucja – mówił dziennikowi „Christian Science Monitor” prof. Pedro Domingos z University of Washington. – Coś tak oczywistego, jak niewpadanie na przedmioty na podłodze, jest bardzo trudnym zadaniem z inżynierskiego punktu widzenia”.

Dlatego na razie maszynom, które mają wchodzić w interakcje z ludźmi, przydziela się bardzo ograniczony zakres obowiązków. Na przykład Pepper, przypominający małą dziewczynkę robot francuskiej firmy Softbank Robotics, jest na dobrą sprawę czymś w rodzaju ruchomej budki informacyjnej: rozumie – zwykle – pytania zadawane przez człowieka i udziela prostych odpowiedzi. Kilka tysięcy takich maszyn (na zdjęciu powyżej) „pracuje” już w szpitalach, bankach czy sklepach.

Ale firma twierdzi też, że w Japonii najwięcej Pepperów sprzedała klientom indywidualnym. Półtorametrowa maszyna, która potrafi też, gdy się ją o to poprosi, tańczyć, śpiewać i przytulać ludzi, jest tam swoistym opiekunem osób starszych. Bo po prostu można z nią porozmawiać. O tym też muszą pamiętać twórcy domowych robotów: maszyna funkcjonująca wśród ludzi powinna nas przypominać nie tylko ciałem, ale i duchem. Ludzie lubią dostrzegać w swoich dziełach odbicie samych siebie.

„Sztuczna inteligencja może być niebezpieczna wtedy, gdy roboty nie zrozumieją dobrze poleceń – twierdzi Domingos. – Roboty nie mają zdrowego rozsądku. Rozwiązaniem jest sprawienie, by były bardziej inteligentne”.

Tylko czy robot na tyle rozumny, by się z nami porozumieć i wykonać za nas wszystkie domowe prace, których nam robić się nie chce, nie będzie też dosyć inteligentny, by zadać sobie pytanie: „Dlaczego właściwie ja mam to robić?”. ©

WOJCIECH BRZEZIŃSKI jest dziennikarzem Polsat News, gdzie prowadzi autorski program popularnonaukowy „Horyzont zdarzeń”. Stale współpracuje z „Tygodnikiem Powszechnym”.

ETYKA MASZYN

Inteligentnych robotów (jak Rosie z kreskówki „Jetsonowie”) nie mamy, ale nad ich etyką zastanawiamy się od dawna.

Najlepiej znanym przykładem „maszynowego dekalogu” są „prawa robotyki” legendarnego pisarza science fiction Isaaca Asimova. Pochodzą z wydanego w 1942 r. opowiadania „Runaround”, a więc z czasów, kiedy nawet komputery były przyszłością. Do dziś są punktem odniesienia w dyskusjach o tym, co wolno robotowi.

1. Robot nie może skrzywdzić człowieka ani przez zaniechanie działania dopuścić, aby człowiek doznał krzywdy.

2. Robot musi być posłuszny rozkazom człowieka, chyba że stoją one w sprzeczności z Pierwszym Prawem.

3. Robot musi chronić sam siebie, jeśli tylko nie stoi to w sprzeczności z Pierwszym lub Drugim Prawem.

Przykazania surowe i odmawiające robotom podmiotowości. Klasyczne przykazania niewolnika. Ale, jak dotychczas, żaden robot na nie się nie skarżył.

„Tygodnik Powszechny” – jedyny polski tygodnik społeczno-kulturalny.

30 tys. Czytelniczek i Czytelników. Najlepsze Autorki i najlepsi Autorzy.

Wspólnota, która myśli samodzielnie.