Wykupienie dostępu pozwoli Ci czytać artykuły wysokiej jakości i wspierać niezależne dziennikarstwo w wymagających dla wydawców czasach. Rośnij z nami! Pełna oferta →

Dla native speakera – drobnostka. Oblała jednak część ustną. Egzaminator uznał, że Kennedy nie potrafi sprawnie rozmawiać we własnym języku. Egzaminatorem – dodajmy – był komputer. Najprawdopodobniej maszyna nie potrafiła zrozumieć irlandzkiego akcentu.

Podobne sytuacje mogą czekać każdego z nas. Coraz częściej rozmawiając on-line z przedstawicielem jakiejś instytucji (nie tylko banku), mówimy do udającej człowieka maszyny, dalekiej od zrozumienia tego, co mamy na myśli. I nie chodzi tylko o akcenty.

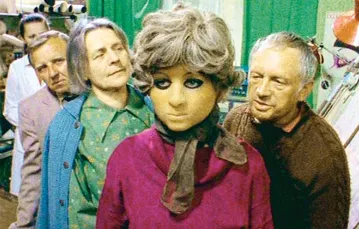

Pierwsze „rozmawiające” systemy pojawiły się w Stanach Zjednoczonych już pół wieku temu. Program ELIZA, stworzony przez Josepha Weizenbauma w Massachusetts Institute of Technology w 1968 r., potrafił udawać psychoterapeutę. Reagował na słowa klucze i udzielał odpowiedzi „z puszki”: np. kiedy w pytaniu pojawiło się słowo „podobny”, komputer pytał: „w jaki sposób?”.

Dzisiejsze odpowiedniki tamtych systemów, tzw. chatboty – mnożące się wraz z popularnością komunikatorów, napędzane mechanizmami uczenia maszynowego – mają rozwijać się i rozmawiać o wiele bardziej naturalnie. Są tanią, skuteczną formą kontaktu z klientem, niewymagającą tworzenia call centers i zatrudniania ludzi, pozwalającą jednak utrzymać iluzję, że z klientem rozmawia ktoś – a nie coś.

Wystarczy jednak, żeby sytuacja odbiegła od standardu, a iluzja pryska. Zza okienka czatu wygląda krzemowa twarz komputera, który nie rozumie kontekstu – a przede wszystkim: nie rozumie ludzi. Zwykle to irytujące, ale w Wielkiej Brytanii i Stanach Zjednoczonych pojawiają się już chatboty dla pogotowia czy policji. Tu brak zrozumienia kontekstu, niuansów mowy czy emocji dzwoniącego może być groźny. Bo jeśli świat opanują chatboty, to albo maszyny nauczą się rozumieć nas, albo my zaczniemy porozumiewać się jak maszyny. Na razie bliżej jest do tego drugiego. ©